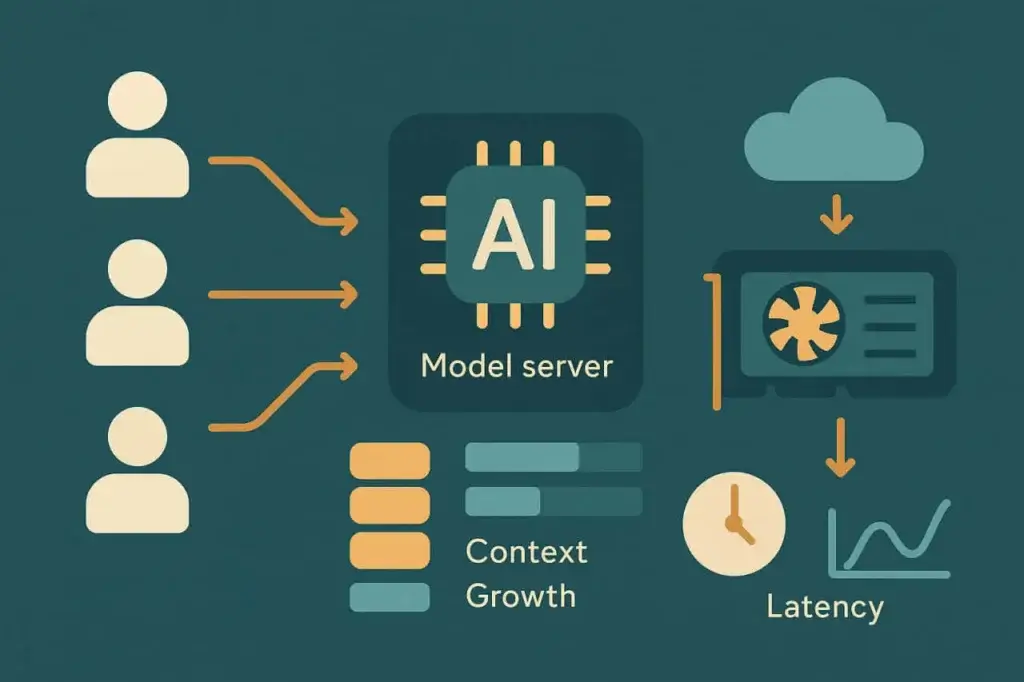

AI 代理正在改变“负载”的定义。传统的负载测试是为网页、API 和事务构建的——这些系统在压力下表现可预测。AI 驱动的工作负载则不同。它们的输入在长度、复杂性和上下文上各异。它们的处理是概率性的,而非确定性的。它们的性能不仅取决于网络延迟或后端吞吐量,还依赖于 GPU 调度和令牌生成。

这种转变打破了大多数负载测试所基于的假设。你不能像对待另一个 API 端点那样对待 AI 代理。每个请求是一段对话,而不是一次点击。每个响应依赖于上一个响应。每个会话随着上下文积累而变得越来越重。

为了保持这些系统的可靠性,性能工程师需要一套新的操作手册——理解如何模拟并发推理,而不仅仅是并发流量。本文概述了现代、AI 驱动的策略,用于规模化测试代理并在复杂度提升时保持其性能。

AI 代理负载测试中的性能挑战

AI 工作负载的行为不同于网页或移动端流量。AI 驱动系统中的每个“用户”可能代表一系列链式操作:提示扩展、相关上下文检索、模型推理,以及后处理或工具执行。负载不是固定的——它随着交互的每个回合而演变。

随着这些层叠增加,性能退化呈非线性。并发用户数增加两倍不一定意味着延迟增加两倍——可能是五倍,具体取决于模型负载、内存和 GPU 分配。传统负载测试指标如每秒请求数或平均响应时间无法反映底层动态。这里关键的是延迟弹性——即性能随会话数增加而变化的程度。

AI 代理系统中存在几个周期性压力因素:

上下文累积

每个用户查询都携带历史上下文——有时达到数千个先前对话或文档的令牌。随着上下文长度增长,提示大小膨胀,模型推理时间增加。在大规模下,这会引发不可预测的延迟峰值和 GPU 排队压力。

计算瓶颈扩展

与网络服务器不同,大型模型推理不总是可以横向扩展。模型权重和上下文窗口占用固定的 GPU 内存,超过容量意味着排队请求或回退到较小模型。这使得并发限制比基于 CPU 的系统更为严格。

检索延迟

许多代理在生成响应前会通过向量数据库、API 或文档存储拉取外部数据。这些依赖增加了 I/O 延迟,并在突发流量下成为首个瓶颈。

会话持久性

传统负载测试回放无状态请求。AI 会话是有状态的。每个会话携带内存、嵌入和缓存上下文。谈话越长,会话占用越重。

这些因素结合形成了一种新的压力特征。系统可能在 100 个并发用户时表现正常,但在 120 个时崩溃,不是因带宽耗尽,而是因 GPU 队列饱和或上下文缓存溢出。对 AI 系统进行负载测试意味着揭示这些非线性拐点开始的位置。

理解 AI 代理工作负载行为

设计测试前,理解 AI 代理底层行为有助于建模。大多数生产代理遵循类似的流程:

- 输入接收。 用户发送查询或消息。

- 上下文组装。 代理从先前回合或外部存储收集相关数据。

- 模型推理。 组装好的提示被发送到本地或远程模型端点。

- 后处理。 输出可能会被解析、验证或增强后返回。

- 响应交付。 代理更新 UI 状态或发送 API 响应。

每个阶段增加变异性。推理时间大致与输入和输出令牌数量成正比。检索延迟依赖数据库距离和缓存命中率。上下文组装成本随着谈话回合增加而升高。

要理解性能行为,需观察这些维度如何相互作用。例如,提示长度翻倍可能使平均推理延迟增加 60%,但并发度超出某门槛后,延迟可能增加 300%。这些曲线比单一指标更重要。

对 AI 系统的负载测试部分是统计性的。你不仅是在测量吞吐量——而是在建立响应分布。这些分布的尾部——95 和 99 百分位延迟——告诉你模型或基础设施开始饱和的时刻。这也是大多数用户感知变慢的根源。

实际操作中,映射工作负载行为需要进行渐进式递增测试。从少量并发会话开始,捕获基线延迟,然后逐步放大。观察令牌吞吐量、排队时间和 GPU 利用率的变化。每个代理都有其独特的扩展特征,找到它是实现可靠操作的第一步。

AI 代理负载测试中的核心指标

传统指标——RPS、TTFB、错误率——仍适用,但不能完全反映全貌。AI 代理负载测试引入了反映智能而非仅仅基础设施扩展的新指标。

推理延迟衡量从提交提示到模型响应完成的总时间。这是最直接的性能信号,但必须与输入大小和模型类型一同跟踪。未经上下文大小归一化的原始平均值比较可能误导。

上下文扩展量化延迟随着提示窗口扩展的增长。工程师可绘制响应时间与令牌数的关系图以查看成本曲线。优化良好的系统呈线性或次线性扩展,优化差的系统则在某些上下文阈值后呈指数级峰值。

令牌吞吐量——在并发会话中每秒处理的令牌数——反映性能和成本效率。大多数 API 按令牌计费,吞吐率下降直接导致成本效率降低。

依赖延迟捕捉来自支持系统的延时,如向量搜索索引、知识库或插件 API。即使推理很快,这些也可能主导总响应时间。

并发稳定性衡量系统在同时负载下的表现。延迟是否按预期增长?错误率是否保持在合理范围?还是响应时间随着队列增长而剧烈波动?

通过结合这些指标,团队可以构建整体的性能图景。目标不仅是测量速度,而是理解性能退化的起因和位置。

为 AI 系统设计有效的负载测试

有了这些指标,测试策略就聚焦于模拟的逼真度。AI 代理不会提供完全相同的请求,录制单笔交易并在负载下回放毫无意义。每个合成用户必须展现多样性——不同的提示、长度和行为。目标不是一致性,而是真实性。

1. 建模完整推理流程,而不仅是端点

真实用户不会孤立地请求 /generate。它们先认证、提交上下文、调用检索,再生成输出。可信的负载测试应模拟这一序列。跳过任何环节,数据就变得无意义。

2. 参数化提示以反映真实多样性

随着输入长度或语义复杂度增加,AI 系统会变慢。使用可变提示模板调整令牌数、句子结构或嵌入上下文深度。这样可以揭示扩展如何影响响应时间分布。

3. 逐步递增并发度

AI 后端通常在推理层排队请求。与其瞬间激增到 1000 用户,不如按定义阶段逐步递增——例如 10 → 50 → 100 → 200,并在每个阶段保持几分钟。所得曲线显示 GPU 或线程饱和点。

4. 同时跟踪成本与性能

与网络服务器不同,推理 API 按令牌计费。在负载测试期间,计算各并发级别的每请求成本。性能调优应包含经济效率——快速但昂贵的模型在规模化时可能财务失败,即使技术上通过。

5. 包括重试与超时行为

AI 端点通常会限流或在重负载下性能下降。模拟客户端重试逻辑以观察负载叠加效应。简单的指数退避在失败高峰时可能使实际流量翻倍。

这些策略取代了旧有的“录制和回放”模型,采用行为模拟思维。你不是测试交易,而是在测试认知——系统如何同时思考和扩展。

AI 驱动的负载测试:让模型帮忙

具有讽刺意味的是,AI 可以帮助解决它自身制造的问题。现代测试平台开始将机器学习模型直接嵌入分析闭环,产生所谓的AI 驱动负载测试。

AI 在这里扮演三种角色:

提示生成

不用手工制作数百条测试输入,生成模型可以产出模拟真实用户多样性的提示变体。它能自动调整语气、结构和上下文,暴露更广泛的压力模式。

异常检测

AI 模型能比静态阈值更快发现性能数据的统计漂移。不在于延迟超限报警,而是基于学习的正常变异,浮现出真实退化的异常点。

预测饱和分析

通过分析历史负载数据,AI 可预测系统何时将触及下一性能陡壁。回归模型或时间序列预测工具在生产中断前识别非线性扩展模式。

优点不是神奇自动化,而是加速。工程师花更少时间于重复维护,更多时间于解读性能变化原因。AI 驱动负载测试将手动脚本转为自适应实验。

在 LoadView 中实现 AI 代理测试

AI 代理虽是前沿,但仍通过熟悉协议沟通——HTTP、WebSocket 或 REST API。这意味着你可以使用 LoadView 已有的基础设施来测试它们。

基于 API 的测试是基础。每个代理请求,无论多复杂,最终都解析为一个 API 调用——通常是通过 HTTPS 的 JSON。LoadView 的 API 测试允许团队模拟数千并发推理请求,每个请求使用动态载荷参数化。你可以变更提示大小、注入上下文,测量端到端延迟。

UserView 脚本扩展了界面层的模拟。许多 AI 代理运行于仪表盘、聊天门户或 SaaS 集成中。借助 LoadView,你可以录制完整工作流——登录、输入提示、响应呈现——并从分布式云位置回放。此方法验证后端和前端在真实浏览器条件下的行为。

可扩展的编排将一切串联。LoadView 的云网络跨地理区域分发测试,使团队能够看到全球流量对依赖集中 GPU 集群的 AI 端点的影响。通过关联响应时间与地理距离,你可以区分网络延迟与模型延迟。

分析与报告完成反馈回路。LoadView 跟踪所有标准性能指标,也可定制捕获特定类型的数据。如此一来,合成测试变成 AI 性能的可观测层。

换句话说,你不需要为 AI 系统准备全新测试平台——只需在现有平台中设计更智能的测试。LoadView 已具备基本要素,这类新型工作负载只是需要不同的测试理念。

AI 负载测试的未来

AI 系统不是静态服务——它们是自适应的、随机性的,并不断重新训练。这意味着即使基础设施保持不变,性能特性也在变化。某次模型更新提升准确度可能使推理时间翻倍。某次提示变更提升连贯性可能使上下文大小激增。负载测试必须发展以适应这些动态目标。

未来的性能测试将融合模拟、分析和自学习反馈回路。测试实时调整,基于观察到的模型稳定性扩展或缩减负载。工程师不再只是“运行测试,阅读报告”,而是维护连续的性能基线,随着模型漂移不断更新。

关注点将超越吞吐量。关键问题不再是“能否处理 1000 个用户?”,而是“能否在压力下保持一致思考?”衡量认知稳定性——即需求激增时推理质量的退化程度——将成为标准指标。

对于部署 AI 助理、聊天助手和自动决策代理的组织来说,这种演变已经开始。系统虽新,原则却是永恒的:你无法改进不被测量的东西。负载测试一直是揭露隐形极限的学科。AI 只是增加了一种新的极限——性能与智能的边界。

AI 代理负载测试——总结

AI 代理为性能测试引入了新维度。它们结合了高强度计算、动态上下文和不可预测的扩展。传统负载测试脚本已无法跟上步伐,但 AI 驱动的方法可以。通过关注推理延迟、上下文扩展和并发稳定性,利用 LoadView 等工具模拟完整推理工作流,团队即便在智能成为系统核心时也能保持可靠性。

下一个负载测试时代,不仅衡量系统响应多快,更衡量系统在所有人同时提问时思考得多好。