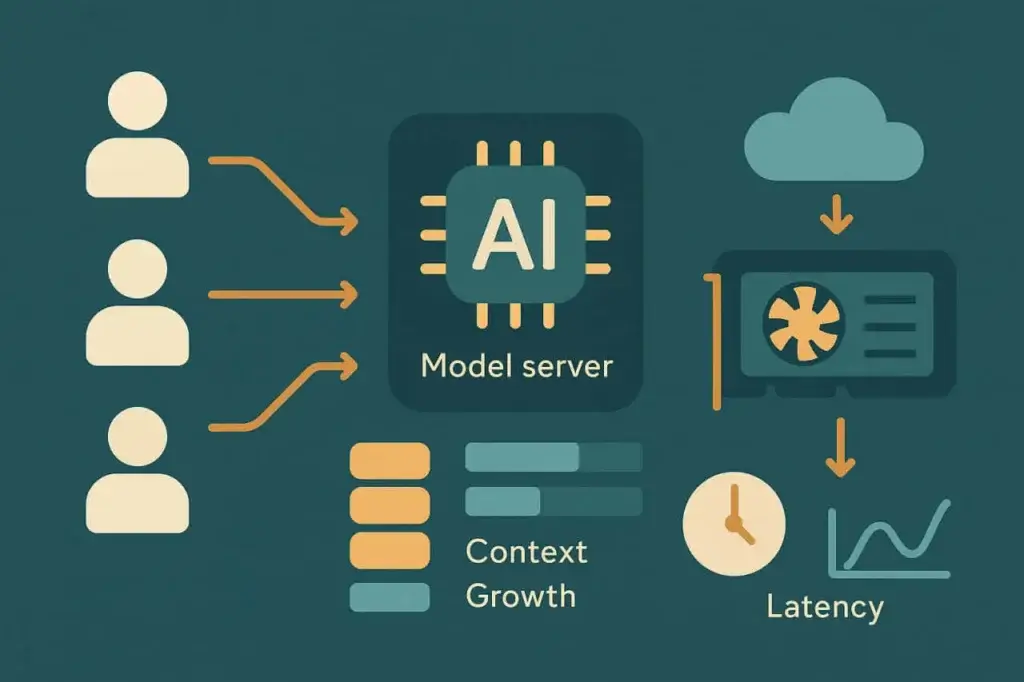

Los agentes de IA están cambiando lo que significa “carga”. Las pruebas de carga tradicionales estaban diseñadas para páginas web, API y transacciones—sistemas que se comportan de forma predecible bajo estrés. Las cargas de trabajo impulsadas por IA no. Sus entradas varían en longitud, complejidad y contexto. Su procesamiento es probabilístico, no determinista. Su desempeño depende tanto de la programación de la GPU y la generación de tokens como de la latencia de la red o el rendimiento del backend.

Este cambio rompe las suposiciones sobre las cuales se construyeron la mayoría de las pruebas de carga. No se puede tratar a un agente de IA como otro punto final de API. Cada solicitud es una conversación, no un clic. Cada respuesta depende de la anterior. Y cada sesión se vuelve más pesada a medida que el contexto se acumula.

Para mantener estos sistemas fiables, los ingenieros de rendimiento necesitan un nuevo manual—uno que entienda cómo simular razonamiento concurrente, no solo tráfico concurrente. Este artículo describe estrategias modernas impulsadas por IA para probar agentes a gran escala y mantenerlos con buen rendimiento a medida que la complejidad crece.

Desafíos de Rendimiento en las Pruebas de Carga para Agentes de IA

Las cargas de trabajo de IA no se comportan como el tráfico web o móvil. Cada “usuario” en un sistema impulsado por IA puede representar una serie de operaciones encadenadas: una expansión de prompt, recuperación de contexto relevante, inferencia del modelo y postprocesamiento o ejecución de herramientas. La carga no es fija—evoluciona con cada turno en la interacción.

A medida que estas capas se apilan, la degradación del rendimiento se vuelve no lineal. Un aumento de 2x en usuarios concurrentes no significa 2x la latencia—podría significar 5x, dependiendo de la carga del modelo, la memoria y la asignación de GPU. Métricas tradicionales de pruebas de carga como solicitudes por segundo o tiempo medio de respuesta no capturan la dinámica subyacente. Lo que importa aquí es la elasticidad de la latencia: cómo se comporta el rendimiento a medida que las sesiones se multiplican.

Hay varios factores de estrés recurrentes en los sistemas de agentes IA:

Acumulación de Contexto

Cada consulta de usuario lleva contexto histórico—a veces miles de tokens de conversación previa o datos de documentos. A medida que la longitud del contexto crece, el tamaño del prompt se infla y el tiempo de inferencia del modelo aumenta. A gran escala, esto crea picos impredecibles de latencia y presión en la cola de las GPUs.

Escalabilidad Limitada por Cómputo

A diferencia de los servidores web, la inferencia de modelos grandes no siempre puede escalar horizontalmente. Los pesos del modelo y las ventanas de contexto consumen memoria fija de GPU; exceder la capacidad significa encolar solicitudes o recurrir a modelos más pequeños. Esto hace que los límites de concurrencia sean mucho más estrictos que en sistemas basados en CPU.

Latencia de Recuperación

Muchos agentes obtienen datos externos—mediante bases de datos vectoriales, APIs o almacenes de documentos—antes de generar una respuesta. Estas dependencias añaden latencia de I/O y se convierten en el primer cuello de botella durante picos de tráfico.

Persistencia de Sesión

Las pruebas de carga tradicionales reproducen solicitudes sin estado. Las sesiones de IA son con estado. Cada una porta memoria, representaciones embebidas y contexto almacenado en caché. Cuanto más larga la conversación, mayor la huella de la sesión.

Estos factores se combinan en un nuevo perfil de estrés. El sistema puede parecer saludable con 100 usuarios concurrentes pero fallar a 120, no por agotamiento de ancho de banda sino por saturación de cola en la GPU o desbordamiento de caché de contexto. Probar la carga de sistemas IA implica descubrir dónde comienzan esos puntos de inflexión no lineales.

Comprendiendo el Comportamiento de la Carga de Agentes de IA

Antes de diseñar pruebas, es útil modelar cómo un agente de IA realmente se comporta internamente. La mayoría de los agentes en producción siguen una canalización similar:

- Ingesta de entrada. El usuario envía una consulta o mensaje.

- Ensamblaje de contexto. El agente recopila datos relevantes de turnos anteriores o una fuente externa.

- Inferencia del modelo. El prompt ensamblado se envía a un endpoint de modelo local o remoto.

- Postprocesamiento. La salida puede ser analizada, validada o enriquecida antes de devolverla.

- Entrega de la respuesta. El agente actualiza el estado de la interfaz o envía una respuesta de API.

Cada etapa añade variabilidad. El tiempo de inferencia escala aproximadamente con el número de tokens de entrada y salida. La latencia de recuperación depende de la proximidad a la base de datos y las tasas de aciertos en caché. El costo de ensamblaje de contexto crece con cada turno en la conversación.

Para entender el comportamiento del rendimiento, debes observar cómo interaccionan estas dimensiones. Por ejemplo, duplicar la longitud del prompt puede aumentar la latencia media de inferencia un 60%, pero la concurrencia más allá de cierto umbral puede aumentarla un 300%. Esas curvas son más importantes que cualquier métrica única.

Las pruebas de carga en sistemas IA son en parte estadísticas. No solo estás midiendo el rendimiento—estás construyendo distribuciones de respuestas. Las colas de esas distribuciones—las latencias en percentiles 95 y 99—indican cuándo el modelo o la infraestructura comienzan a saturarse. Ahí se originan la mayoría de los ralentizamientos visibles para el usuario.

En la práctica, mapear el comportamiento de la carga significa realizar pruebas progresivas de rampa. Comienza con unas pocas sesiones concurrentes, captura la latencia base y luego incrementa gradualmente. Observa cómo responden el rendimiento de tokens, los tiempos de cola y la utilización de GPU. Cada agente tiene su propia firma de escalado, y encontrarla es el primer paso para operaciones confiables.

Métricas Clave para Medir en Pruebas de Carga de Agentes de IA

Las métricas tradicionales—RPS, TTFB, tasa de errores—aún aplican, pero no cuentan toda la historia. Las pruebas de carga para agentes de IA introducen nuevas métricas que reflejan cómo escala la inteligencia, no solo la infraestructura.

Latencia de inferencia mide el tiempo total desde la presentación del prompt hasta la respuesta del modelo completada. Es la señal de rendimiento más directa, pero debe ser monitoreada junto con el tamaño de entrada y el tipo de modelo. Comparar promedios sin normalizar por tamaño de contexto puede ser engañoso.

Escalado del contexto cuantifica cómo crece la latencia a medida que se expande la ventana de prompt. Los ingenieros pueden graficar el tiempo de respuesta contra el conteo de tokens para visualizar la curva de costo. Un sistema bien optimizado muestra un escalado lineal o sublineal, mientras que sistemas mal optimizados exhiben picos exponenciales más allá de ciertos umbrales de contexto.

Rendimiento de tokens—tokens procesados por segundo en sesiones concurrentes—refleja tanto el rendimiento como la eficiencia de costos. Puesto que la mayoría de las APIs facturan por token, una disminución en el rendimiento se traduce directamente en ineficiencia de costos.

Latencia de dependencia captura los retrasos de sistemas de soporte: índices de búsqueda vectorial, bases de conocimiento o APIs complementarias. Estos pueden dominar el tiempo total de respuesta aun cuando la inferencia sea rápida.

Estabilidad en la concurrencia mide cómo se comporta el sistema bajo carga simultánea. ¿La latencia crece de forma predecible? ¿Se mantienen acotadas las tasas de error? ¿O los tiempos de respuesta oscilan descontroladamente a medida que se forman colas?

Al combinar estas métricas, los equipos pueden construir una imagen holística del rendimiento. El objetivo no es solo medir velocidad—es entender dónde y por qué comienza la degradación.

Diseñando Pruebas de Carga Efectivas para Sistemas de IA

Con las métricas definidas, la estrategia de prueba se vuelve sobre la fidelidad de la simulación. Los agentes de IA no sirven solicitudes idénticas, por lo que grabar una sola transacción y reproducirla bajo carga es inútil. Cada usuario sintético debe representar variación—diferentes prompts, longitudes y comportamientos. La meta no es uniformidad sino realismo.

1. Modelar la canalización completa de razonamiento, no solo el endpoint

Los usuarios reales no acceden a /generate aisladamente. Se autentican, envían contexto, invocan recuperación y luego generan salida. Una prueba de carga creíble imita esa secuencia. Saltarse una capa vuelve tus datos insignificantes.

2. Parametrizar los prompts para reflejar diversidad real

Los sistemas de IA desaceleran a medida que aumenta la longitud de entrada o la complejidad semántica. Usa plantillas de prompts variables que ajusten el conteo de tokens, estructuras de oraciones o profundidad de contexto embebido. Esto revela cómo el escalado afecta la distribución de tiempos de respuesta.

3. Incrementar la concurrencia gradualmente

Los backends de IA suelen encolar solicitudes en la capa de inferencia. En vez de saltar instantáneamente a 1000 usuarios, sube la carga gradualmente en etapas definidas—por ejemplo, 10 → 50 → 100 → 200—manteniendo cada nivel por varios minutos. La curva resultante revela dónde comienzan la saturación de GPU o hilos.

4. Monitorear costos junto con rendimiento

A diferencia de servidores web, las APIs de inferencia tienen costo por token. Durante las pruebas de carga, calcula el costo por solicitud en cada nivel de concurrencia. La optimización del rendimiento debe incluir eficiencia económica—modelos rápidos pero caros pueden fallar a escala financieramente aun si técnicamente funcionan.

5. Incluir comportamiento de reintentos y timeouts

Los endpoints de IA frecuentemente limitan la tasa o degradan bajo uso intensivo. Simula la lógica de reintentos del cliente para observar efectos compuestos en la carga. Un backoff exponencial ingenuo puede duplicar el tráfico efectivo cuando hay picos de fallos.

Estas estrategias reemplazan el antiguo modelo de “grabar y reproducir” por una mentalidad de simulación conductual. En vez de probar transacciones, estás probando la cognición—cómo el sistema piensa y escala simultáneamente.

Pruebas de Carga Impulsadas por IA: Deja que los Modelos Ayuden

Irónicamente, la IA puede ayudar a resolver el mismo problema que crea. Las plataformas modernas de prueba están comenzando a integrar modelos de aprendizaje automático directamente en sus ciclos de análisis, produciendo lo que comúnmente se llama pruebas de carga impulsadas por IA.

Aquí, la IA juega tres roles:

Generación de prompts

En lugar de crear manualmente cientos de entradas de prueba, un modelo generativo puede producir variaciones de prompts que simulen la diversidad real de usuarios. Puede ajustar automáticamente tono, estructura y contexto, exponiendo el sistema a un rango más amplio de patrones de estrés.

Detección de anomalías

Los modelos de IA pueden detectar desviaciones estadísticas en los datos de rendimiento más rápido que umbrales estáticos. En vez de alertar cuando la latencia supera un límite fijo, los modelos de anomalías aprenden la varianza normal y detectan valores atípicos que señalan degradación genuina.

Análisis predictivo de saturación

Al analizar datos históricos de carga, la IA puede predecir cuándo un sistema alcanzará su próximo límite de rendimiento. Modelos de regresión o predictores de series temporales identifican patrones de escalado no lineal antes de que afecten la producción.

El beneficio no es una automatización mágica, es aceleración. Los ingenieros pasan menos tiempo en mantenimiento repetitivo y más en interpretar por qué cambia el rendimiento. Las pruebas de carga impulsadas por IA convierten la escritura manual de scripts en experimentación adaptativa.

Implementando Pruebas para Agentes de IA en LoadView

Los agentes de IA pueden ser de vanguardia, pero aún se comunican mediante protocolos familiares—HTTP, WebSocket o APIs REST. Eso significa que puedes probarlos con la misma infraestructura que LoadView ya provee.

Las pruebas basadas en API son la base. Cada solicitud de agente, sin importar su complejidad, se resuelve finalmente en una llamada API—a menudo JSON sobre HTTPS. Las pruebas API de LoadView permiten simular miles de solicitudes de inferencia concurrentes, cada una parametrizada con cargas dinámicas. Puedes variar tamaño de prompt, inyectar contexto y medir latencia de extremo a extremo.

El scripting UserView extiende esa simulación a través de la interfaz de usuario. Muchos agentes de IA operan dentro de paneles, portales de chat o integraciones SaaS. Con LoadView, puedes grabar flujos completos—inicio de sesión, entrada de prompt, renderizado de respuesta—y reproducirlos desde ubicaciones distribuidas en la nube. Este enfoque valida el comportamiento tanto de backend como frontend bajo condiciones reales de navegador.

Orquestación escalable conecta todo. La red en la nube de LoadView distribuye pruebas geográficamente, permitiendo a los equipos ver cómo tráfico global afecta puntos finales de IA que dependen de clusters centralizados de GPU. Al correlacionar tiempos de respuesta con distancia geográfica, puedes separar latencia de red de latencia del modelo.

Analíticas e informes completan el ciclo de retroalimentación. LoadView rastrea todas las métricas estándar de rendimiento pero también puede personalizarse para capturar ciertos tipos de datos. Esa combinación convierte las pruebas sintéticas en una capa de observabilidad para el rendimiento de IA.

En otras palabras, no necesitas una nueva plataforma de pruebas para sistemas IA—necesitas un diseño de prueba más inteligente dentro de una existente. LoadView ya tiene los elementos primitivos, y esta nueva clase de cargas simplemente demanda una filosofía de prueba diferente.

El Futuro de las Pruebas de Carga para IA

Los sistemas IA no son servicios estáticos—they son adaptativos, estocásticos y continuamente reentrenados. Eso significa que sus características de rendimiento cambian incluso cuando la infraestructura permanece igual. Una actualización del modelo que mejora la precisión puede duplicar el tiempo de inferencia. Un cambio en el prompt que mejora la coherencia puede explotar el tamaño del contexto. Las pruebas de carga deben evolucionar para tener en cuenta esos objetivos móviles.

Las pruebas de rendimiento futuras combinarán simulación, análisis y ciclos de retroalimentación autoaprendibles. Las pruebas se ajustarán en tiempo real, aumentando o disminuyendo la carga según la estabilidad observada del modelo. En lugar de “ejecutar prueba, leer informe”, los ingenieros mantendrán bases de referencia de rendimiento continuas que se actualizan conforme los modelos cambian.

El enfoque se moverá más allá del rendimiento bruto. La pregunta clave no será “¿Puede manejar 1000 usuarios?” sino “¿Puede pensar consistentemente bajo presión?” Medir la estabilidad cognitiva—cómo la calidad del razonamiento se degrada cuando la demanda se dispara—será una métrica estándar.

Para organizaciones que despliegan copilotos IA, asistentes de chat y agentes de decisión automatizados, esta evolución ya está en marcha. Los sistemas son nuevos, pero el principio sigue siendo atemporal: no puedes mejorar lo que no mides. Las pruebas de carga siempre han sido la disciplina de exponer límites ocultos. La IA solo añade un nuevo tipo de límite—la frontera entre rendimiento e inteligencia.

Pruebas de Carga para Agentes de IA – Conclusión

Los agentes de IA introducen una nueva dimensión en las pruebas de rendimiento. Combinan un cómputo pesado, contexto dinámico y escalabilidad impredecible. Los scripts tradicionales de pruebas de carga no pueden seguir el ritmo, pero los enfoques impulsados por IA sí pueden. Al enfocarse en latencia de inferencia, escalado de contexto y estabilidad en la concurrencia—y utilizando herramientas como LoadView para simular flujos completos de razonamiento—los equipos pueden preservar la fiabilidad incluso cuando la inteligencia se convierte en el núcleo de sus sistemas.

La próxima era de pruebas de carga no solo medirá qué tan rápido responden los sistemas. Medirá qué tan bien piensan cuando todos preguntan al mismo tiempo.