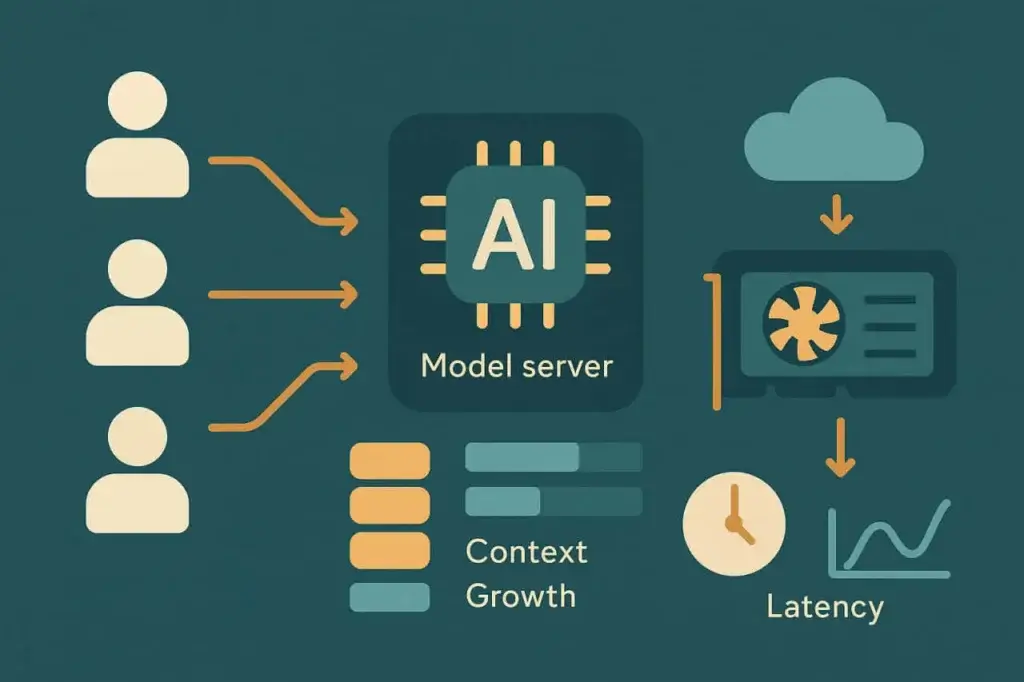

AIエージェントは「負荷」の意味を変えています。従来のロードテストはウェブページ、API、およびトランザクション向けに構築されており、これらのシステムは負荷下で予測可能に動作します。しかし、AI駆動のワークロードはそうではありません。入力は長さ、複雑さ、コンテキストが変化し、その処理は決定論的ではなく確率的です。パフォーマンスはネットワーク遅延やバックエンドのスループットだけでなく、GPUのスケジューリングやトークン生成にも依存します。

この変化は、ほとんどのロードテストが前提としていた仮定を崩します。AIエージェントを他のAPIエンドポイントと同じように扱うことはできません。各リクエストはクリックではなく会話であり、各レスポンスは前回の応答に依存します。そして、各セッションはコンテキストが蓄積するにつれて重くなっていきます。

これらのシステムを信頼性の高いものに保つため、パフォーマンスエンジニアは新しいプレイブックを必要としています。単に同時トラフィックをシミュレートするだけでなく、同時推論を理解するものです。この記事では、大規模なAIエージェントのテストと、複雑さが増すにつれてパフォーマンスを維持するための最新のAI駆動戦略を概説します。

AIエージェントロードテストにおけるパフォーマンスの課題

AIワークロードはウェブやモバイルトラフィックとは異なります。AI駆動システムの「ユーザー」それぞれは、プロンプトの展開、関連コンテキストの取得、モデル推論、後処理やツール実行といった一連の連鎖した操作を表します。負荷は固定されておらず、各インタラクションのターンごとに変化します。

これらの層が積み重なると、パフォーマンス低下は非線形になります。同時ユーザー数が2倍になっても、遅延が2倍になるわけではなく、モデル負荷やメモリ、GPU割り当てによっては5倍になることもあります。従来のTPS(1秒あたりのリクエスト数)や平均応答時間といったロードテストの指標は、根本的な動態を捉えきれません。ここで重要なのは遅延の弾力性――セッションが増えるにつれてパフォーマンスがどのように変化するかです。

AIエージェントシステムにはいくつかの繰り返し現れる負荷要因があります:

コンテキストの蓄積

各ユーザークエリは過去の会話や文書データの数千トークンに及ぶ履歴コンテキストを含みます。コンテキストの長さが増すと、プロンプトサイズが膨らみ、モデル推論時間も増加します。大規模になるとこれにより予測不可能な遅延スパイクやGPUのキューイング圧力が発生します。

計算リソースに制約されたスケーリング

ウェブサーバーとは異なり、大規模モデルの推論は水平スケールできないことがあります。モデルの重みとコンテキストウィンドウは固定GPUメモリを消費し、容量を超えるとリクエストがキューイングされるか、より小さいモデルにフォールバックします。これによりCPUベースのシステムよりも同時実行の制限がはるかに厳しくなります。

取得遅延

多くのエージェントはレスポンス生成前にベクターデータベース、API、または文書ストアから外部データを取得します。これらの依存関係はI/O遅延を追加し、バーストトラフィック時に最初のボトルネックになります。

セッションの持続性

従来のロードテストはステートレスリクエストを再生しますが、AIセッションはステートフルです。各セッションはメモリ、埋め込み、キャッシュされたコンテキストを保持し、会話が長くなるほどセッションのフットプリントが重くなります。

これらの要因が組み合わさり、新しい種類のストレスプロファイルを生み出します。システムは100同時ユーザーでは正常に見えても、120ユーザーで崩れることがあり、それは帯域幅の不足ではなくGPUキューの飽和やコンテキストキャッシュのオーバーフローによるものです。AIシステムのロードテストは、これらの非線形の転換点を明らかにすることを意味します。

AIエージェントのワークロード挙動の理解

テスト設計の前に、AIエージェントが実際にどのように動作しているかをモデル化すると役立ちます。多くのプロダクションエージェントは類似したパイプラインに従います:

- 入力の受け取り。 ユーザーがクエリまたはメッセージを送信します。

- コンテキストの組み立て。 エージェントは過去のターンや外部ストアから関連データを収集します。

- モデル推論。 組み立てられたプロンプトがローカルまたはリモートのモデルエンドポイントに送られます。

- 後処理。 出力は解析、検証、または強化されてから返されます。

- レスポンスの配信。 エージェントはUI状態を更新するかAPIレスポンスを送信します。

各段階にばらつきがあります。推論時間は入力および出力トークン数にほぼ比例してスケールします。取得遅延はデータベースの近接度やキャッシュヒット率に依存します。コンテキスト組み立てのコストは会話のターン数とともに増加します。

パフォーマンスの挙動を理解するには、これらの次元がどのように相互作用しているか観察する必要があります。例えばプロンプト長を倍にすると平均推論遅延が60%増えるかもしれませんが、ある閾値を超えた同時実行は300%増加させることもあります。これらの曲線は単一の指標より重要です。

AIシステムのロードテストは統計的な要素も含みます。単にスループットを計測するのではなく、レスポンス分布を構築するのです。その分布の末尾、すなわち95パーセンタイルおよび99パーセンタイルの遅延値は、モデルやインフラが飽和し始めた時点を示します。多くのユーザーが体感する遅延はそこから発生します。

実務では、負荷を段階的に増やすランプテストを実施してワークロード動作をマッピングします。少数の同時セッションから始め、基準遅延を取得し、徐々にスケールアップします。トークンスループット、キュー時間、GPU利用率の反応を観察します。各エージェントは独自のスケーリングシグネチャを持っており、それを見つけることが信頼性のある運用への第一歩です。

AIエージェントロードテストで測定すべきコア指標

従来の指標――RPS、TTFB、エラー率――は依然として有効ですが、全体像を語るには不十分です。AIエージェントロードテストでは、インフラだけでなくインテリジェンスのスケールを反映する新たな指標が導入されます。

推論遅延は、プロンプト送信からモデルレスポンス完了までの総時間を測定します。最も直接的なパフォーマンス指標ですが、入力サイズやモデルタイプとともに追跡しなければなりません。コンテキストサイズの正規化なしで単純平均を比較すると誤解を招きます。

コンテキストスケーリングは、プロンプトウィンドウが拡大するにつれて遅延がどのように増加するかを定量化します。エンジニアはトークン数に対する応答時間をプロットしてコスト曲線を可視化できます。適切に最適化されたシステムは線形または亜線形のスケーリングを示し、最適化不足のシステムはある閾値を超えて指数関数的スパイクを示します。

トークンスループットは、同時セッション全体で処理されるトークン数を秒あたりで示し、パフォーマンスとコスト効率の両方を反映します。多くのAPIがトークン単位で課金するため、スループットの低下は直接的なコスト非効率につながります。

依存遅延は、ベクター検索インデックス、ナレッジベース、プラグインAPIなどの補助システムによる遅延を捉えます。推論が高速でも、これらの遅延が総応答時間の支配的要因になることがあります。

同時実行の安定性は、同時負荷下でシステムがどのように振る舞うかを測定します。遅延は予測可能に増加するか?エラー率は抑制されているか?それともキュー形成によって応答時間が激しく変動するか?

これらの指標を組み合わせることで、パフォーマンスの全体像を構築できます。目的は速度を計測することだけでなく、どこでなぜ劣化が始まるのかを理解することです。

AIシステムの効果的なロードテスト設計

指標が定義されたら、テスト戦略はシミュレーションの忠実度に関わります。AIエージェントは同一のリクエストを提供しないため、トランザクションを記録して負荷下で再生する方式は無意味です。各合成ユーザーが変動を表現し、異なるプロンプト、長さ、振る舞いを持つ必要があります。目標は均一性でなくリアリズムです。

1. エンドポイントだけでなく推論パイプライン全体をモデル化する

実際のユーザーは /generate だけを独立して呼び出しません。認証、コンテキスト送信、取得呼び出し、そして出力生成を順に行います。信頼できるロードテストはこのシーケンスを模倣します。一部の層を省略するとデータは無意味になります。

2. 実際の多様性を反映するプロンプトパラメータ化

AIシステムは入力の長さや意味的複雑さが増すと遅くなります。トークン数、文構造、埋め込みコンテキストの深さを調整できる可変プロンプトテンプレートを使用します。これによりスケールが応答時間分布に及ぼす影響を明らかにします。

3. 同時実行を段階的にランプアップする

AIバックエンドは推論層でリクエストをキューイングすることが多いです。瞬時に1000ユーザーにスパイクさせる代わりに、10 → 50 → 100 → 200のような段階的増加を数分間保持しながら進めます。こうした曲線はGPUやスレッドの飽和開始点を明らかにします。

4. パフォーマンスとともにコストも追跡する

ウェブサーバーとは異なり、推論APIはトークン単位で課金されます。各同時実行レベルでリクエストあたりコストを計算します。パフォーマンスチューニングは経済効率も考慮に入れるべきです。速くても高額なモデルは技術的に合格しても財務的にはスケールできないかもしれません。

5. リトライとタイムアウト挙動を含める

AIエンドポイントは多用時にレート制限や品質低下を起こします。クライアントのリトライロジックをシミュレートし、負荷の連鎖的増加を観察します。単純な指数バックオフは障害増加時に実効トラフィックを倍増させる可能性があります。

これらの戦略は旧来の「記録と再生」モデルを置き換え、行動シミュレーションの考え方に変えます。トランザクションをテストするのではなく、認知過程—システムがどのように考え、同時にスケールするか—をテストしているのです。

AI駆動のロードテスト:モデルを活用する

皮肉なことに、AIが生み出す問題をAI自身が解決する手助けができます。最新のテストプラットフォームは機械学習モデルを分析ループに直接組み込み、いわゆるAI駆動ロードテストを実現し始めています。

ここでAIは三つの役割を果たします:

プロンプト生成

手作業で数百のテスト入力を作成する代わりに、生成モデルがリアルなユーザ多様性を模したプロンプトバリエーションを生成します。自動でトーン、構造、コンテキストを調整し、より広範囲のストレスパターンを露出させます。

異常検知

AIモデルは静的閾値より速くパフォーマンスデータの統計的ドリフトを検出します。遅延が固定の限度を超えたときにだけアラートする代わりに、異常検知モデルが正常な変動範囲を学習し、本物の劣化を示す外れ値を浮き彫りにします。

予測的飽和分析

過去の負荷データを分析し、AIはシステムが次に性能の崖に達するタイミングを予測します。回帰モデルや時系列予測子が非線形のスケールパターンを生産環境が破綻する前に特定します。

利点は魔法の自動化ではなく加速です。エンジニアは繰り返しのメンテナンスに費やす時間が減り、パフォーマンス変動の「なぜ」に解釈を集中できます。AI駆動ロードテストは手動スクリプトを適応的実験に変えます。

LoadViewでのAIエージェントテスト実装

AIエージェントは最先端ですが、依然としてHTTP、WebSocket、REST APIといった馴染みのあるプロトコルを介して通信します。つまり、LoadViewの既存インフラでテスト可能です。

APIベースのテストが基盤です。各エージェントリクエストは複雑さにかかわらず最終的にAPIコール(多くはJSON over HTTPS)に解決されます。LoadViewのAPIテストにより、数千の同時推論リクエストを動的ペイロードでパラメータ化してシミュレート可能です。プロンプトサイズを変え、コンテキストを注入し、レイテンシを端から端まで計測できます。

UserViewスクリプティングはユーザーインターフェースを通じたシミュレーションを拡張します。多くのAIエージェントはダッシュボード、チャットポータル、SaaS連携内に存在します。LoadViewならログイン、プロンプト入力、レスポンス表示といった完全なワークフローを記録し、分散クラウドロケーションから再生可能です。この方法はバックエンドとフロントエンドの両方の動作を実ブラウザ条件下で検証します。

スケーラブルなオーケストレーションがすべてを統括します。LoadViewのクラウドネットワークは地理的にテストを分散させ、集中化されたGPUクラスターに依存するAIエンドポイントへのグローバルトラフィックの影響を可視化します。レスポンス時間を地理的距離と相関させて、ネットワーク遅延とモデル遅延を切り分けることが可能です。

分析とレポーティングはフィードバックループを完成させます。LoadViewはすべての標準的なパフォーマンス指標を追跡しつつ、特定タイプのデータをカスタマイズしてキャプチャも可能です。この組み合わせにより合成テストをAIパフォーマンスの可観測性レイヤーに変えます。

言い換えれば、AIシステム専用の新しいテストプラットフォームは必要なく、既存のプラットフォーム内でより賢明なテスト設計が求められているのです。LoadViewはすでに基本機能を備えており、この新しいワークロードクラスは単に異なるテスト哲学を必要としています。

AIロードテストの未来

AIシステムは静的なサービスではなく、適応的で確率的、継続的に再学習されます。つまりインフラが変わらなくてもパフォーマンス特性は変化します。精度を向上するモデル更新が推論時間を倍増させることがあります。整合性を高めるプロンプト変更でコンテキストサイズが爆発的に増加することもあります。ロードテストはこれらの変動する対象を考慮する必要があります。

将来のパフォーマンステストはシミュレーション、分析、自己学習のフィードバックループを融合させます。モデルの安定性に応じてリアルタイムで負荷を拡大・縮小しながら適応します。「テスト実行、レポート閲覧」ではなく、モデルのドリフトに応じて継続的なパフォーマンスベースラインを維持します。

焦点はスループットを超えます。重要な問いは「1000ユーザーをさばけるか?」ではなく「圧力下で一貫して思考できるか?」になります。認知の安定性、すなわち需要急増時に推論品質がどのように劣化するかを測ることが標準的指標となるでしょう。

AIコパイロット、チャットアシスタント、自動意思決定エージェントを展開する組織にとって、この進化はすでに始まっています。システムは新しいものですが原理は普遍的です:測れないものは改善できません。ロードテストは常に隠れた限界を露わにする規律でした。AIは性能と知性の境界という新たな限界を加えただけです。

AIエージェント向けロードテストのまとめ

AIエージェントはパフォーマンステストに新たな次元をもたらします。重い計算、動的コンテキスト、予測不可能なスケールを組み合わせます。従来のロードテストスクリプトでは追いつけませんが、AI駆動のアプローチなら可能です。推論遅延、コンテキストスケーリング、同時実行の安定性に注力し、LoadViewのようなツールを使って完全な推論ワークフローをシミュレートすることで、知性がシステムのコアとなる中でも信頼性を維持できます。

次のロードテストの時代は単にシステムの応答速度を測るだけではありません。すべてのユーザーが同時に尋ねたときに、システムがどれだけうまく「考えられる」かを測るのです。