En nuestro artículo anterior, Prueba de Carga Web: JMeter vs. LoadView – Escenario del Mundo Real, demostramos cómo simular un recorrido típico de usuario en PhoneNumberMonitoring.com — iniciando el sitio, iniciando sesión, navegando por pestañas y cerrando sesión — utilizando tanto Apache JMeter como LoadView. Resaltamos las diferencias fundamentales en el esfuerzo de scripting, la complejidad de configuración y la facilidad de uso general entre estas dos herramientas.

Basándonos en ese ejercicio, este artículo presenta una comparación detallada de los informes de rendimiento generados por LoadView y JMeter después de ejecutar una prueba de carga con 10 usuarios. Nos enfocamos en aspectos críticos como la precisión de la ejecución, las capacidades de reporte en tiempo real, el manejo de AJAX y contenido dinámico, la visibilidad de sesiones y la escalabilidad empresarial.

Dado que las aplicaciones modernas dependen cada vez más de la ejecución dinámica de JavaScript, evaluar la experiencia del usuario a través de pruebas en navegadores reales se vuelve esencial. Esta comparación tiene como objetivo mostrar cómo cada herramienta refleja estos desafíos del mundo real y cuál proporciona conocimientos más profundos y accionables sobre el rendimiento front-end.

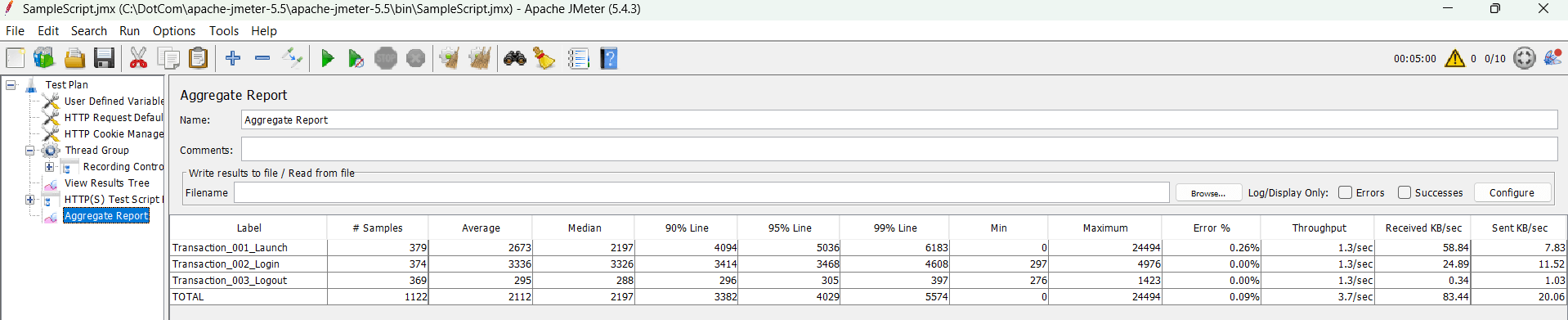

- Capacidades de Reporte: Perspectivas Estáticas vs Dinámicas JMeter:

Ofrece estadísticas básicas de rendimiento a través de listeners como Aggregate Report y Summary Report: Los listeners integrados de JMeter proporcionan métricas de alto nivel como tiempo promedio de respuesta, rendimiento y porcentajes de error. Sin embargo, estas salidas son limitadas en granularidad y carecen de visualización para recorridos de usuario complejos.

Requiere scripting por parte del usuario o plugins para comparaciones históricas: Para analizar tendencias a lo largo del tiempo, los evaluadores deben configurar manualmente integraciones con bases de datos como InfluxDB y herramientas de visualización como Grafana, lo que agrega complejidad.

Genera archivos HTML o CSV locales que no se comparten en la nube: Los informes se almacenan localmente, lo que requiere compartir y coordinar manualmente, creando a menudo desafíos de versiones y accesibilidad.

No tiene desglose incorporado a sesiones individuales de usuario: Los evaluadores no pueden rastrear problemas a nivel de sesión; deben cotejar manualmente las marcas de tiempo en los registros.

Modo GUI:

Modo No GUI:

LoadView:

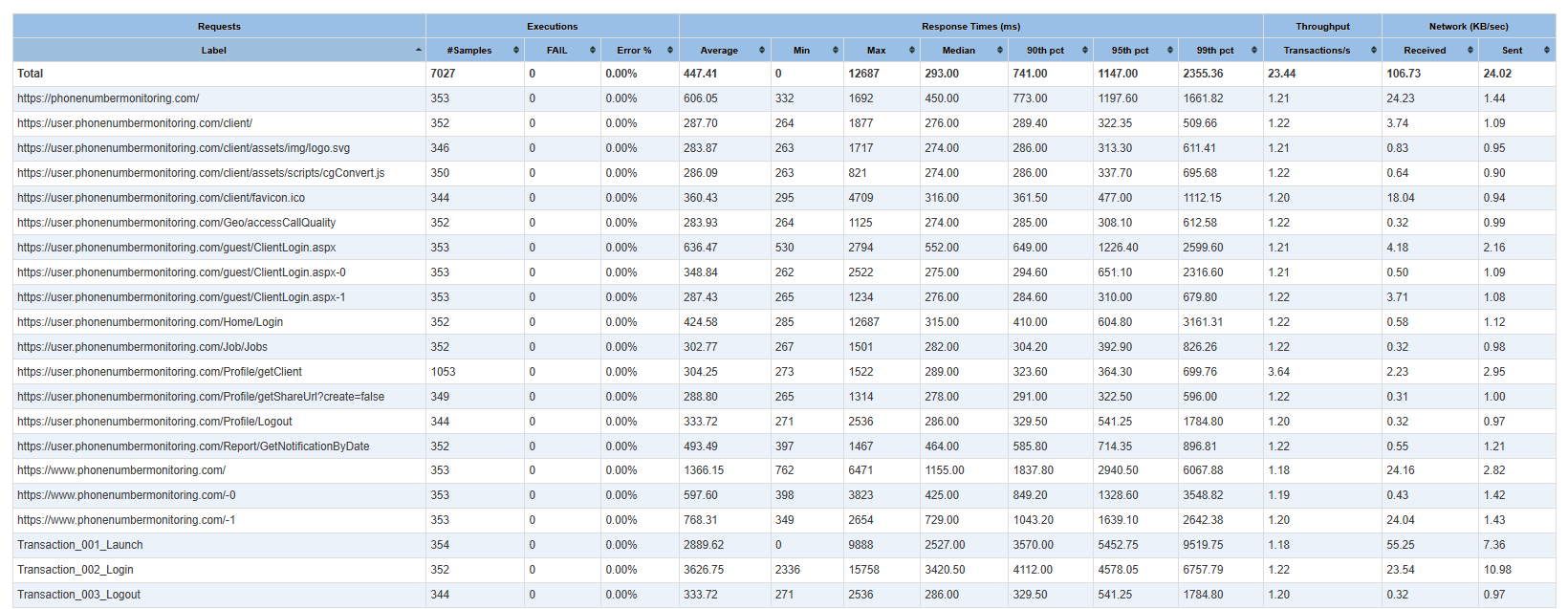

Informes ricos, alojados en la nube y accesibles en tiempo real: Las métricas de rendimiento en vivo se muestran continuamente mientras se ejecuta la prueba.

Actualización continua en tiempo real de KPIs de rendimiento: Métricas tales como promedio reEl tiempo de respuesta, el percentil 90, el mínimo, el máximo y la tasa de fallos se actualizan en tiempo real.

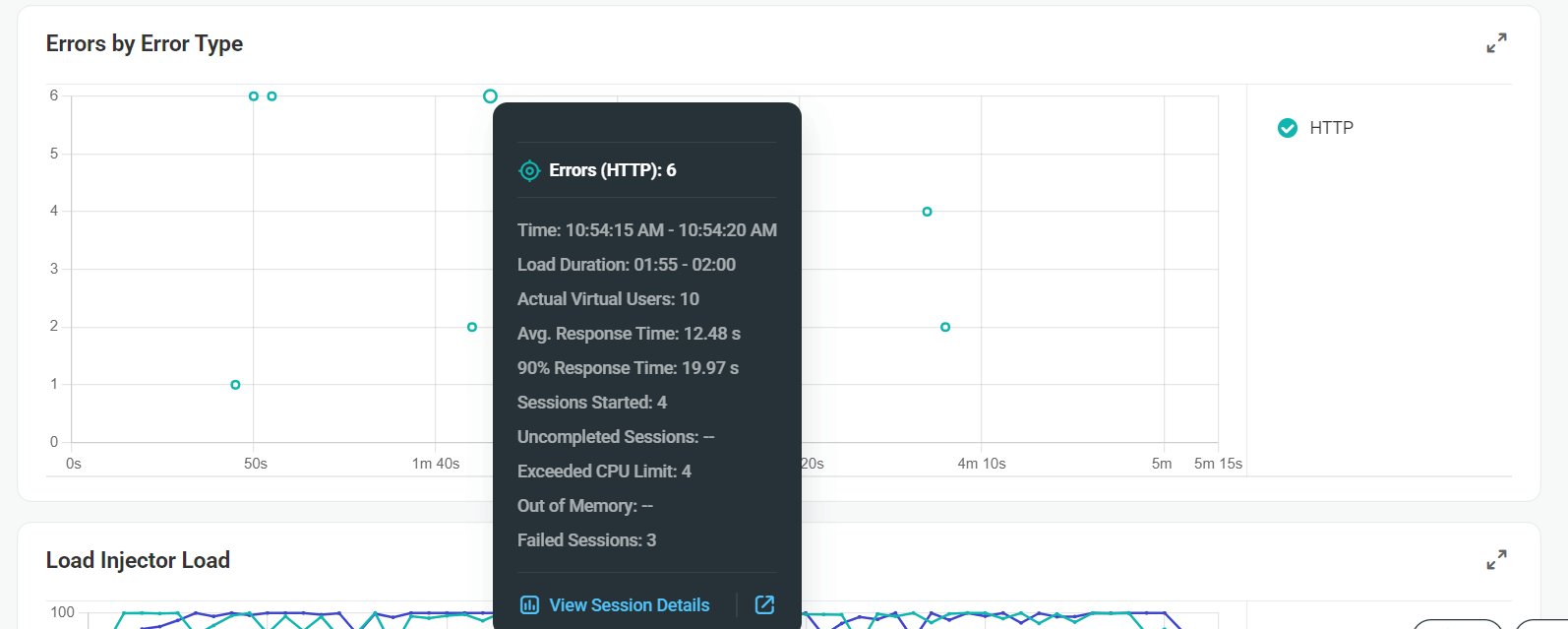

Clasificación de errores para un análisis rápido de la causa raíz: Los errores se agrupan en categorías de validación, cliente, servidor y terceros.

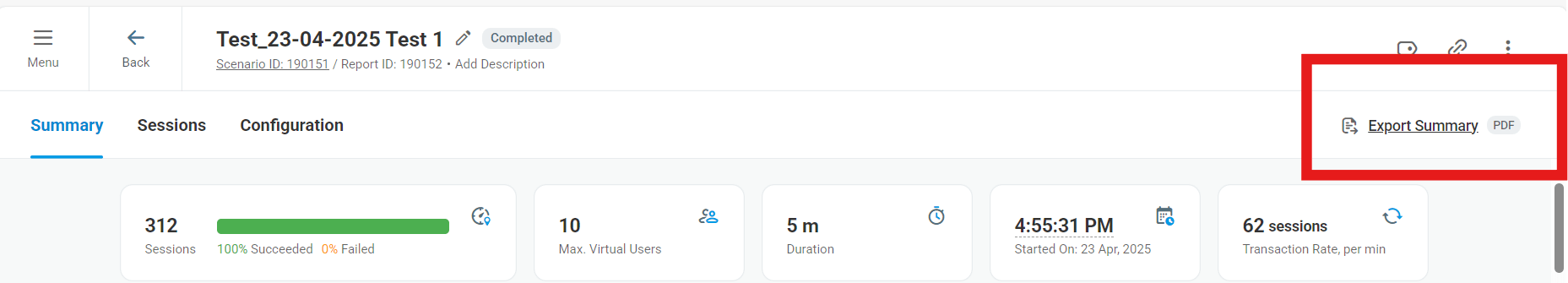

PDF basado en la nube y enlaces compartibles del panel: Distribuya fácilmente paneles en vivo o exporte resúmenes para compartir con los equipos.

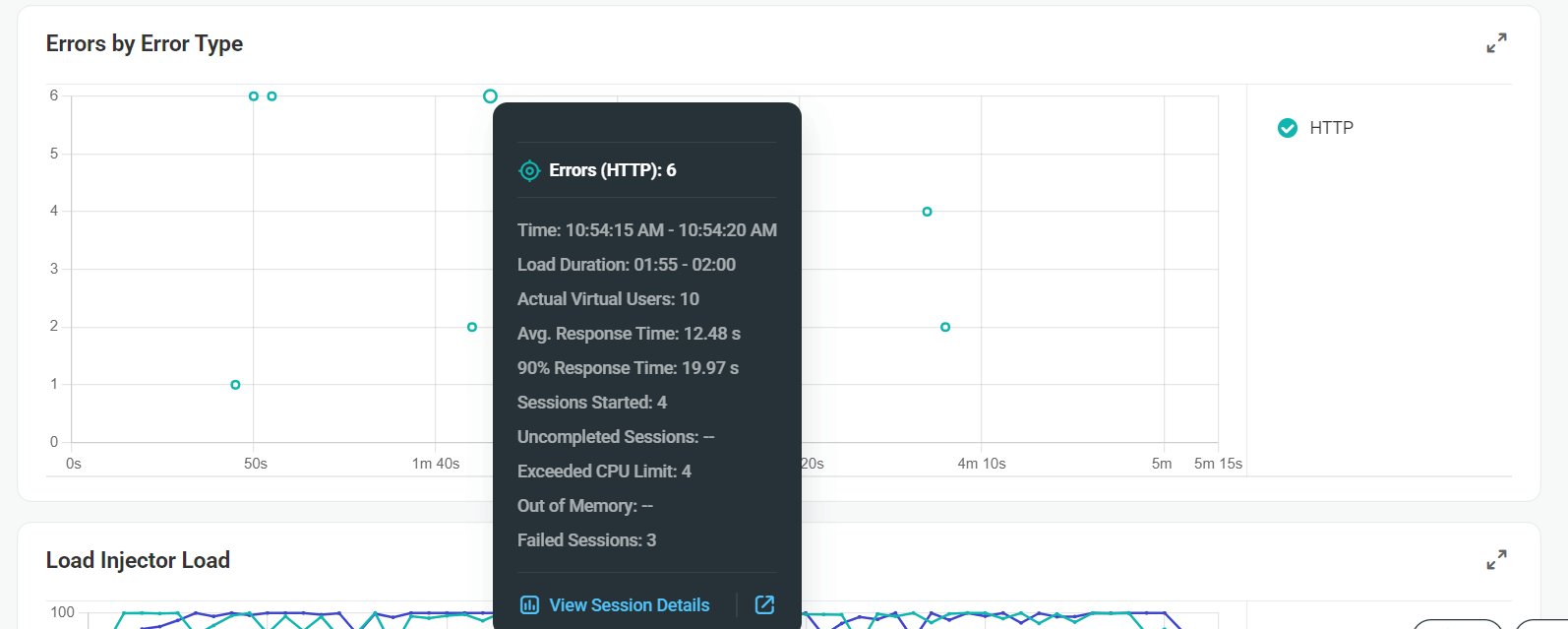

Gráficos interactivos para tiempos de respuesta, distribución de errores y actividad de usuarios virtuales: Permite la identificación rápida de picos, tendencias o fallos. Una vista resumen integral para monitorear el progreso de la prueba en tiempo real.

La mitad superior muestra un pico súbito en el tiempo promedio de respuesta, que se correlaciona (ver flechas rojas) con una caída en las sesiones exitosas y un aumento en las sesiones fallidas (gráfico inferior). Este es un ejemplo ideal de la capacidad de LoadView para correlacionar visualmente degradaciones de rendimiento con el comportamiento de las sesiones de usuario.

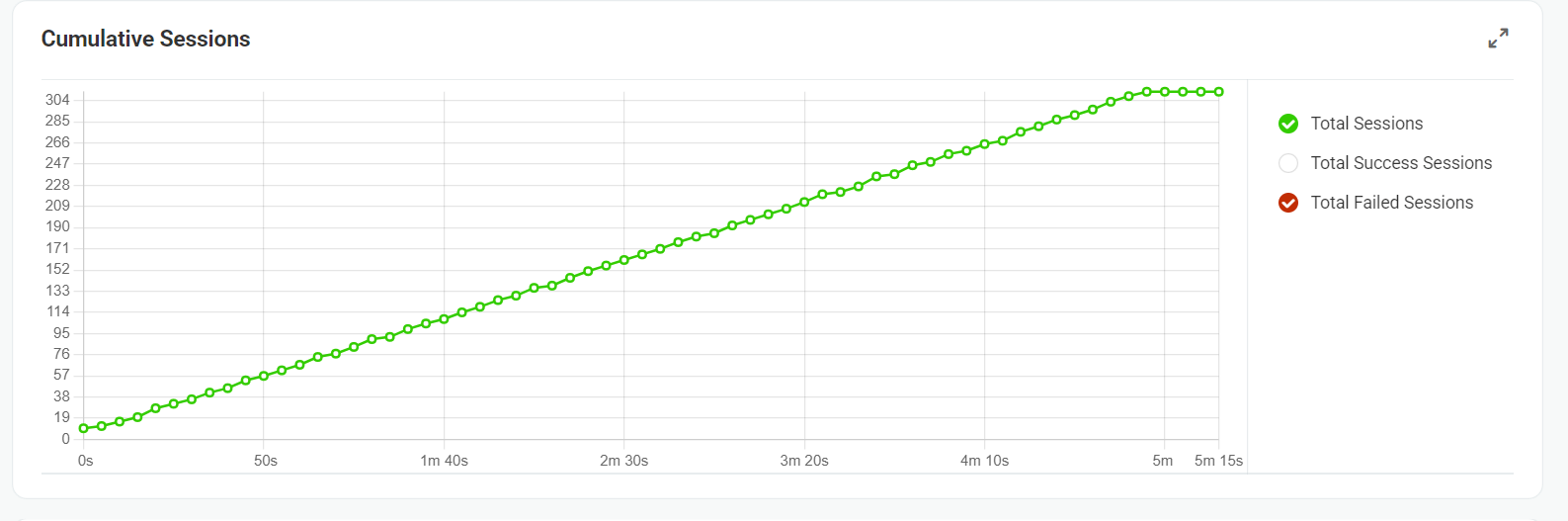

Seguimiento acumulado de sesiones a través de ventanas de tiempo: Ayuda a evaluar la consistencia y estabilidad de la prueba durante todo el período de ejecución.

Curvas de aumento de usuarios virtuales: Representación visual de incrementos de carga alineados con el rendimiento de las sesiones.

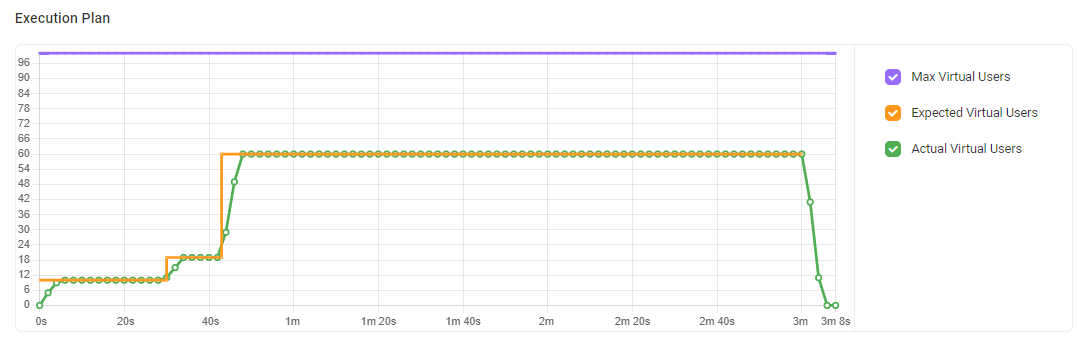

Este gráfico muestra cómo se escalaron los usuarios virtuales a lo largo del tiempo. La línea verde muestra el número real de usuarios ejecutados, coincidiendo estrechamente con la línea naranja (usuarios esperados), demostrando un comportamiento estable de aumento y disminución. La línea púrpura marca el límite máximo configurado para usuarios virtuales.

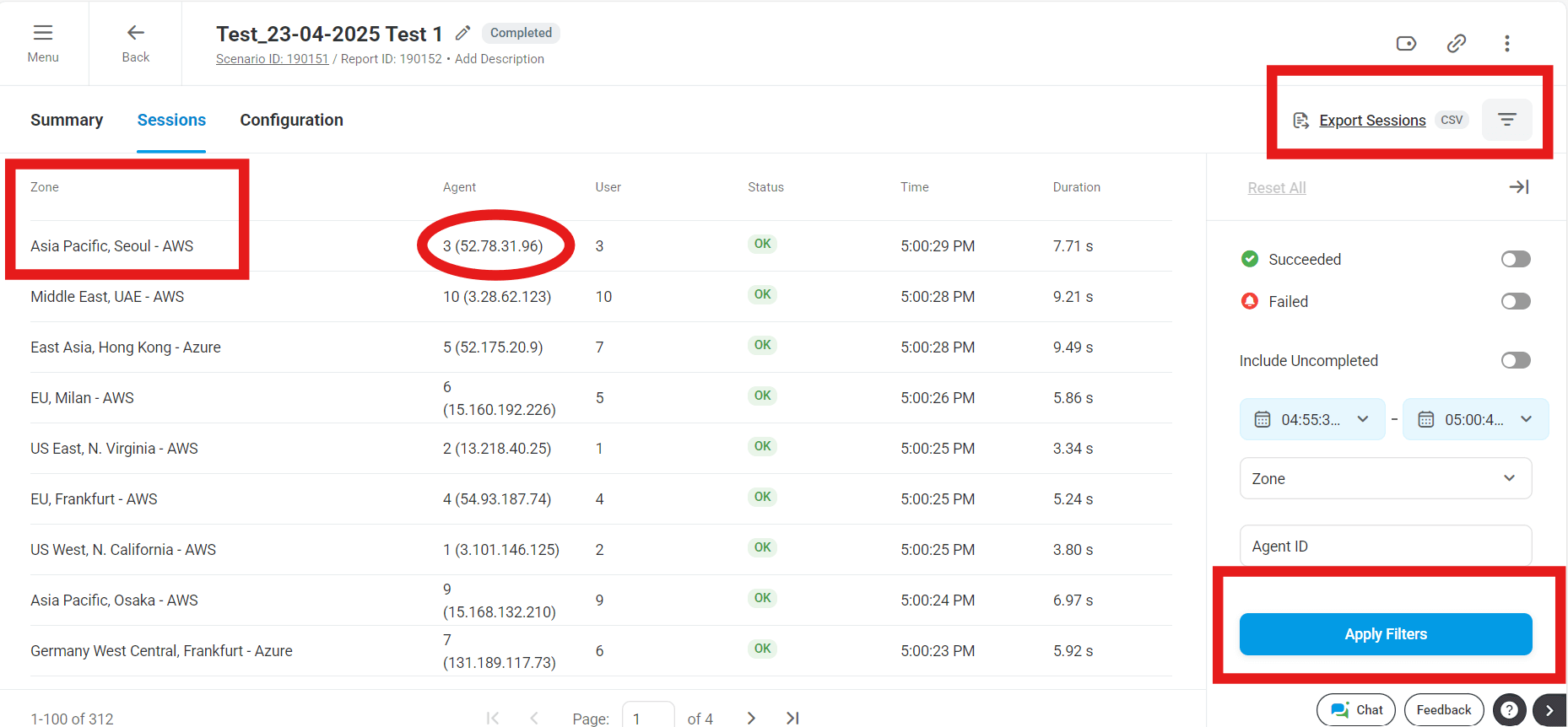

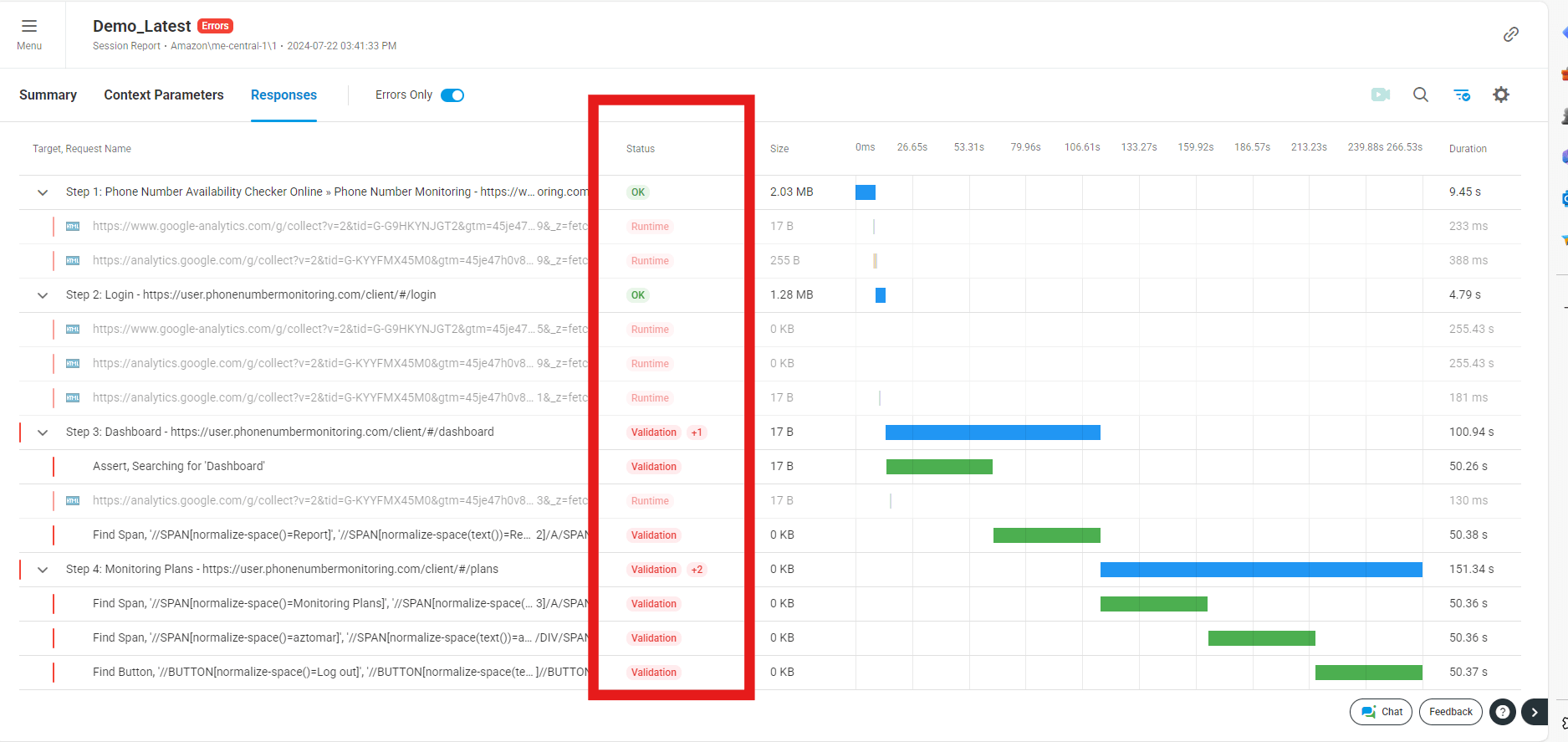

Estadísticas del servidor de cada geo-zona: Diagnostica problemas específicos de la región o latencia. Navegación por sesión mostrando trayectorias individuales de usuarios: Profundiza en el recorrido de cualquier usuario virtual y los datos de respuesta asociados.

Profundiza en ID de sesiones específicas: Inspecciona recorridos individuales de prueba y puede ver conocimientos detallados a nivel de red por usuario y aislar rápidamente la fuente de errores para una resolución más rápida.

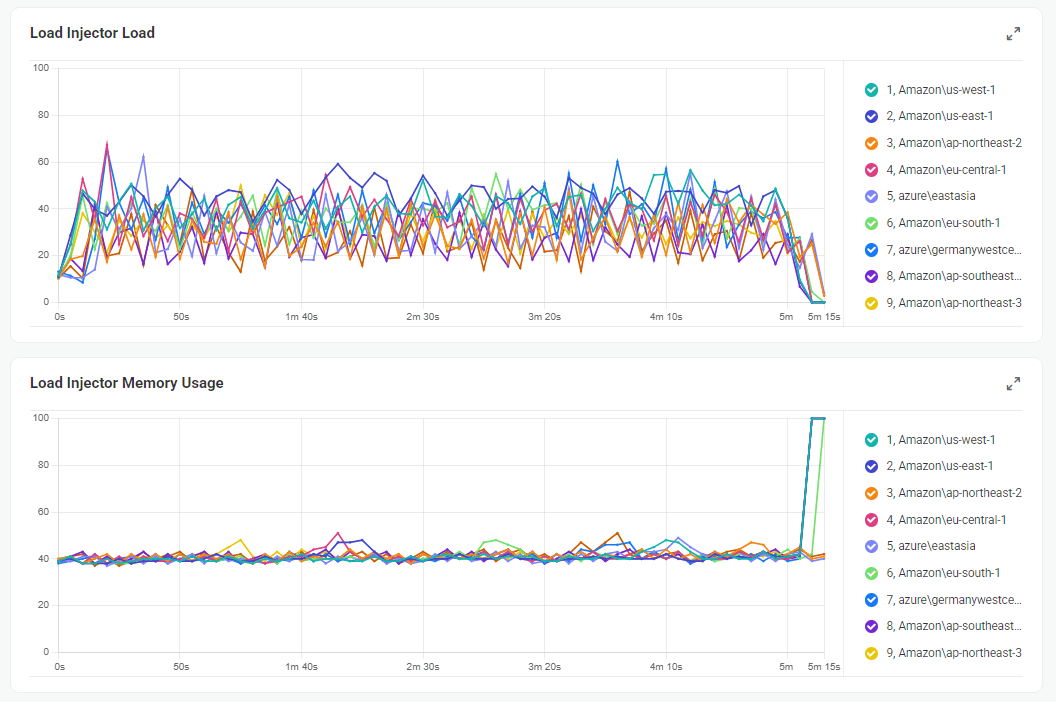

Esto muestra cómo múltiples agentes en la nube (de regiones AWS, Azure) compartieron la carga de la prueba. La CPU y la memoria permanecieron mayormente equilibradas durante todo el tiempo, verificando la arquitectura elástica de distribución de pruebas de LoadView.

- Manejo de llamadas AJAX y asíncronas Limitaciones de JMeter:

Operación solo a nivel de protocolo:

JMeter simula solicitudes en el protocolo HTTPnivel, lo que significa que no puede ejecutar ni interpretar JavaScript del lado del cliente que a menudo activa llamadas AJAX. Esto resulta en una captura parcial de solicitudes, especialmente para aplicaciones web modernas.

Omite la actividad posterior a la carga:

Las operaciones asíncronas desencadenadas por interacciones del usuario—como clics en botones, menús desplegables o actualizaciones dinámicas de la página—no se detectan a menos que la secuencia exacta de solicitudes se escriba manualmente, lo cual es complejo e poco confiable.

Soporte deficiente para SPA (React, Angular, Vue):

En aplicaciones de página única (SPA), el contenido se carga dinámicamente sin recargas completas de la página. Dado que JMeter no simula el comportamiento a nivel de navegador, no puede interactuar ni rastrear los cambios del DOM después de la carga inicial. Probar estos flujos con precisión requiere soluciones frágiles.

Esfuerzo manual para la simulación de AJAX:

Los ingenieros deben inspeccionar manualmente las herramientas de desarrollo del navegador para identificar los puntos finales asíncronos y luego replicar el comportamiento usando temporizadores, tiempos de espera o lógica personalizada en JMeter. Esto aumenta el mantenimiento de las pruebas y genera riesgos de omitir rutas críticas de usuario.

Ventajas de LoadView:

La ejecución en navegadores reales captura AJAX a la perfección:

LoadView utiliza navegadores reales (como Chrome o Edge), que soportan y ejecutan inherentemente todo el JavaScript y las llamadas AJAX. Esto significa que cada disparador del lado del cliente, sin importar cuán dinámico o retardado sea, se captura con precisión durante la ejecución de la prueba.

Simulación verdadera de renderizado de extremo a extremo:

Como LoadView ve la página tal como lo haría un usuario real, eventos como contenido cargado perezosamente, desplazamiento infinito y widgets de autoactualización se prueban completamente—sin necesidad de código personalizado ni temporizadores de retraso.

Cero scripting para lógica asíncrona:

Los evaluadores pueden grabar scripts simplemente interactuando con la aplicación (clics, desplazamientos, movimientos del mouse), y LoadView mapea automáticamente toda la actividad de red desencadenada—incluidas solicitudes AJAX encadenadas. Esto elimina las conjeturas y reduce el tiempo de creación de scripts.

Compatibilidad con SPA desde el primer momento:

LoadView puede probar aplicaciones construidas con marcos modernos de front-end como Angular, React y Vue sin configuración adicional. A medida que suceden las actualizaciones de navegación y datos dentro de la vista del navegador, LoadView captura todo, como una experiencia real de usuario.

Tiempos de respuesta precisos incluyendo retrasos asíncronos:

Dado que las aplicaciones con AJAX intensivo a menudo retrasan mostrar contenido clave hasta cargar datos asíncronos, las métricas de LoadView reflejan estos retrasos con precisión—asegurando que los SLA de desempeño se basen en tiempos de carga percibidos por usuarios reales, no solo en la respuesta bruta del servidor.

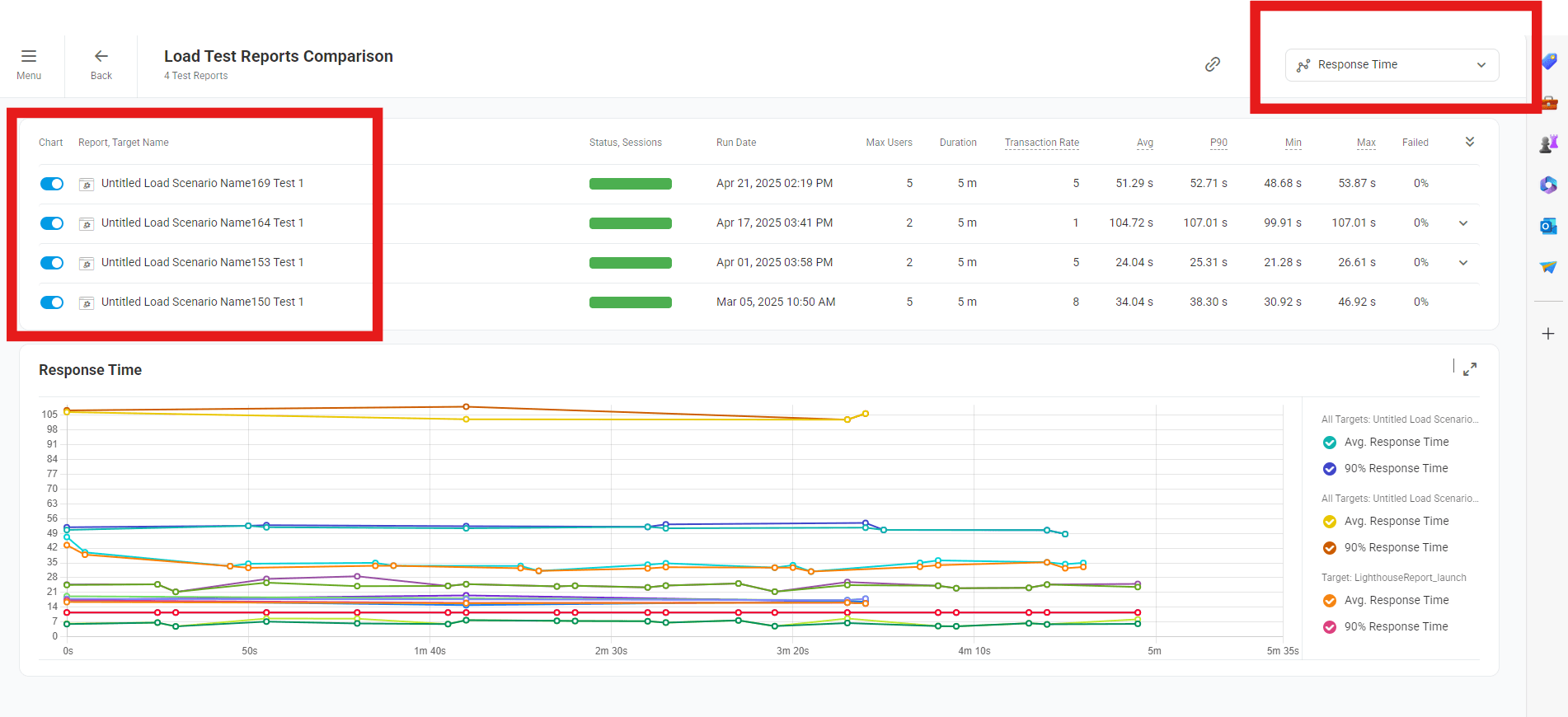

- Comparación histórica de ejecuciones de prueba en LoadView: comparar resultados a través de múltiples ejecuciones de prueba

Mientras los reportes en tiempo real y estáticos son valiosos, LoadView también ofrece seguimiento de tendencias históricas desde el primer momento. Cada ejecución de pruebase archiva automáticamente y puede compararse con ejecuciones anteriores.

Vista de rendimiento Antes/Después

Esto permite a los equipos evaluar los cambios realizados en el código de la aplicación, la infraestructura o servicios de terceros comparando directamente las líneas base de rendimiento anteriores con los resultados más recientes—sin integración o configuración compleja.

No se requiere configuración

A diferencia de JMeter, que requiere integración con InfluxDB y Grafana para visualización histórica, LoadView facilita la comparación de tendencias con una interfaz web simple. No se requiere ninguna herramienta externa.

Ejemplo: Un equipo de desarrollo puede comparar una prueba de hace dos semanas (antes de una optimización de base de datos) con la ejecución más reciente y ver inmediatamente mejoras en el tiempo de respuesta y las tasas de error.

Limitaciones de JMeter:

Sin panel en vivo incorporado: JMeter no ofrece visibilidad en tiempo real durante la ejecución de la prueba. Debe esperar a que la prueba termine para ver los resultados.

Solo análisis posterior a la ejecución: Cualquier fallo o problema se identifica después de que la prueba termina, retrasando la investigación de la causa raíz y limitando la optimización durante la prueba.

Herramientas externas necesarias para vista en vivo: Las métricas en tiempo real requieren configurar bases de datos externas (por ejemplo, InfluxDB) y plataformas de visualización (por ejemplo, Grafana), agregando complejidad y sobrecarga operativa.

Correlación manual de registros: Analizar errores requiere parsear manualmente archivos .jtl, mapeándolos con logs o herramientas de monitoreo de aplicaciones — un proceso tedioso y que consume mucho tiempo, especialmente para flujos de múltiples pasos.

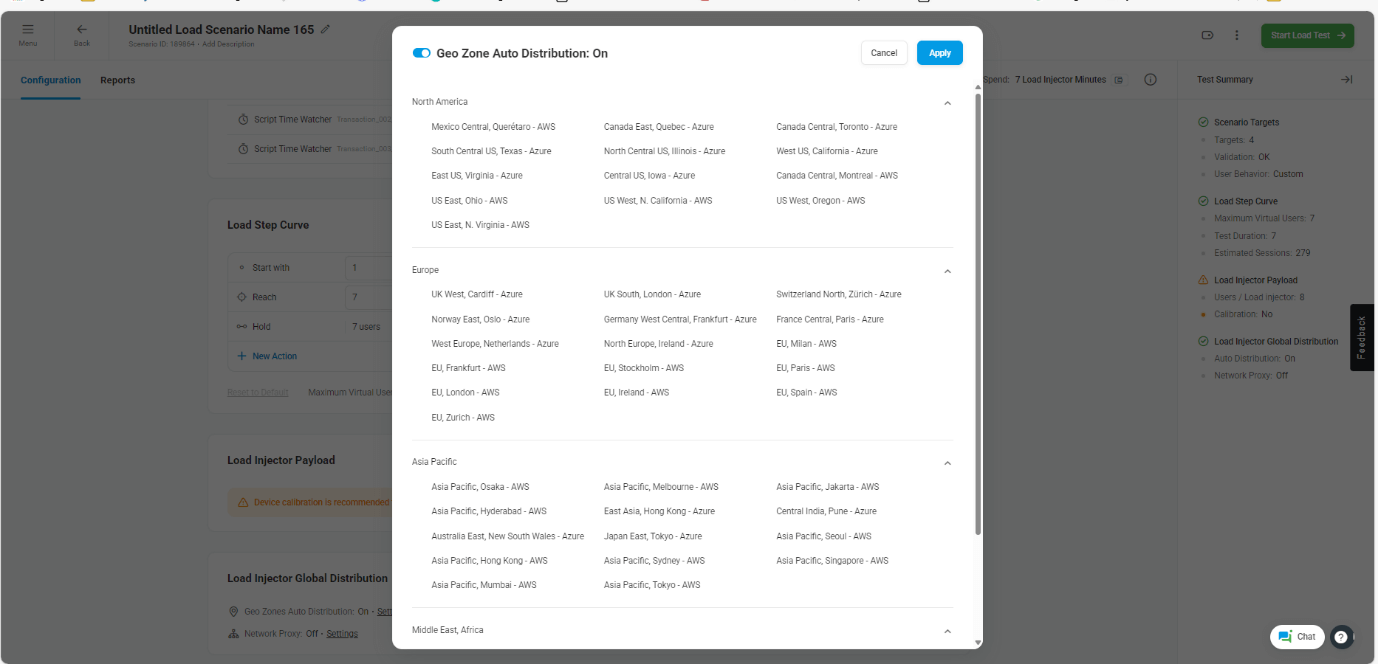

- Simulación de carga a nivel IP y basada en geo: Fortalezas de LoadView:

Distribución global verdadera: LoadView permite simular tráfico desde más de 40 ubicaciones geográficamente diversas basadas en la nube a nivel mundial. Esto ayuda a asegurar que las aplicaciones ofrezcan un rendimiento consistente en distintas regiones. Por ejemplo, si necesitas saber cómo funciona tu aplicación desde Singapur, Londres y Sao Paulo, LoadView lo puede hacer con un clic.

Perspectivas mapeadas por geolocalización IP: Cada sesión de usuario virtual está asociada con una dirección IP y ubicación geográfica. LoadView desglosa métricas de rendimiento como tiempo de respuesta y tasa de errores por ubicación para ayudar a identificar demoras o caídas regionales.

Diagnósticos de servidor específicos por zona: LoadView rastrea tendencias de rendimiento para zonas geográficas individuales, facilitando aislar problemas de infraestructura como sobrecargas regionales de servidores o fallas en el edge de CDN.

No se necesita configuración remota de servidores: A diferencia de los enfoques tradicionales de pruebas distribuidas, LoadView no requiere configuración ni mantenimiento de agentes remotos de JMeter o servidores en la nube. Toda la geo-distribuciónse maneja sin problemas a través de la infraestructura en la nube de LoadView.

Limitaciones de JMeter:

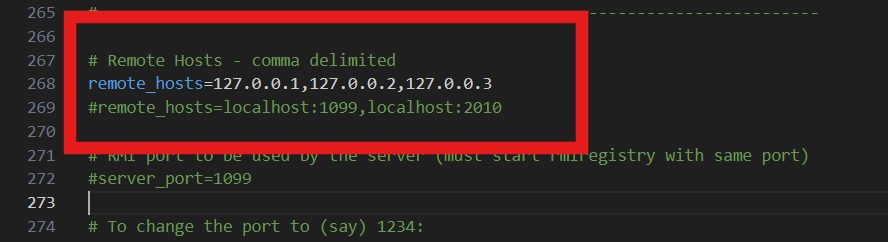

Configuración manual de pruebas distribuidas: Para simular usuarios desde diferentes ubicaciones, los testers deben configurar manualmente agentes remotos de JMeter y establecer comunicación maestro-esclavo, lo cual puede ser frágil y complejo.

Problemas de red/firewall: La ejecución distribuida en JMeter a menudo enfrenta problemas con firewalls corporativos, configuraciones NAT y requisitos de puertos abiertos que ralentizan la configuración y la fiabilidad de las pruebas.

No hay visibilidad regional de errores: JMeter no proporciona de forma nativa datos de rendimiento segmentados por región. Los testers deben implementar de forma personalizada el etiquetado de IP o postprocesar los resultados para descubrir patrones geográficos.

- Testing con Navegadores Reales vs Simulación de Protocolo – Fortalezas de LoadView:

Prueba el comportamiento real del navegador: LoadView usa navegadores reales como Chrome y Edge para replicar la experiencia real del usuario final. Esto incluye la ejecución de JavaScript, renderizado CSS, popups, redireccionamientos y todos los comportamientos dinámicos del frontend.

Captura métricas reales del frontend: Métricas clave de rendimiento como Tiempo hasta el Primer Byte (TTFB), Primer Pintado de Contenido (FCP), Mayor Pintado de Contenido (LCP), Cambio Acumulativo de Diseño (CLS) y Tiempo hasta Interactividad (TTI) se miden directamente desde el contexto del navegador. Estas son cruciales para entender el rendimiento percibido real por el usuario.

Diagnostica cuellos de botella en el frontend: LoadView captura capturas de pantalla, genera gráficos y muestra líneas de tiempo del navegador para que puedas ver con precisión qué elementos visuales o dinámicos son lentos en cargar, permitiendo que los equipos de frontend optimicen el diseño y la interactividad.

Limitaciones de JMeter:

Simulación solo a nivel de protocolo: JMeter solo opera a nivel del protocolo de red (HTTP/S), por lo que no renderiza la página ni ejecuta código del lado del cliente.

No captura errores de renderizado del lado del cliente: No se registran problemas que ocurran después de la carga inicial de la página, como errores en tiempo de ejecución de JavaScript o componentes UI lentos.

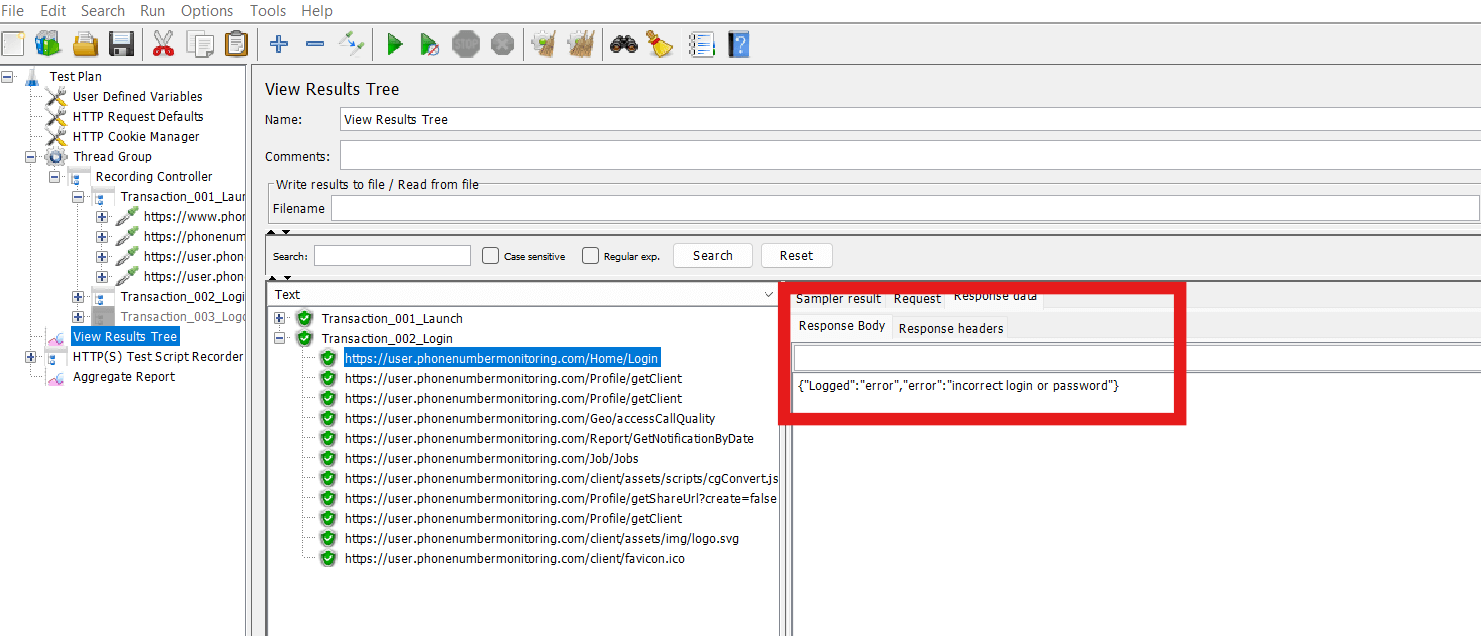

Solo captura mensajes de error si aparecen en la respuesta, pero sigue recibiendo 200 como código de respuesta, por lo que esto resulta engañoso.

No puede medir el rendimiento real de UX: Sin un motor de renderizado de navegador, JMeter no puede evaluar métricas centradas en el usuario como tiempos de pintado o cambios de diseño, limitando su uso para la validación del rendimiento frontend.

- Categorización y Depuración de Errores – Fortalezas de LoadView:

Clasificación automática de errores: LoadView intelligently agrupa los errores en categorías predefinidas — como Errores de Validación (por ejemplo, texto ausente, elemento no encontrado), Errores del Lado del Cliente (tiempos de espera, fallos de script), Errores del Servidor (HTTP 500, 503) y Fallos de Terceros (servicio externo o indisponibilidad de API). Esto ayuda a los equipos a entender inmediatamente la naturaleza y el origen del fallo.

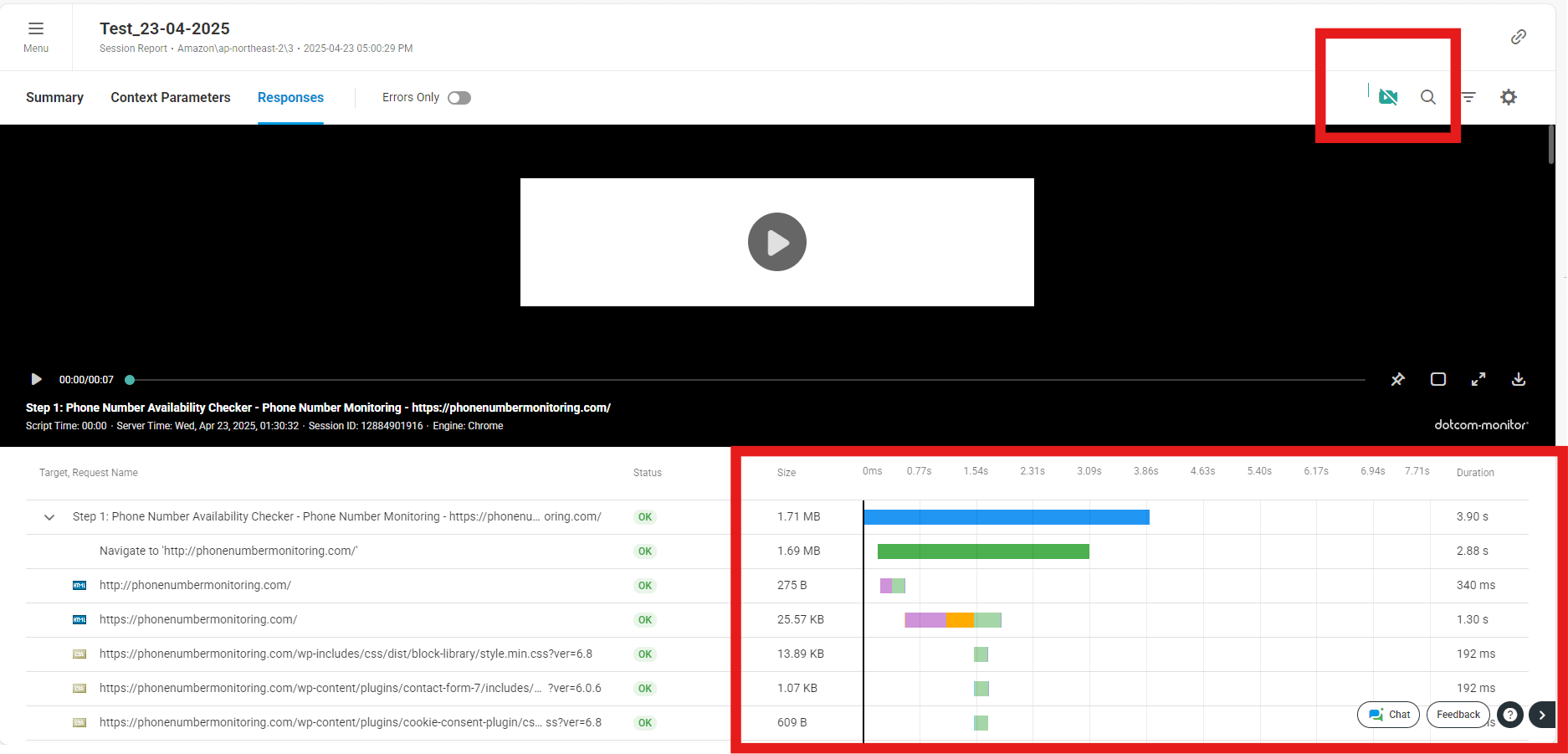

Capturas de pantalla y videos de sesión: Para cada fallo significativo, LoadView captura una captura de pantalla o una grabación en video del navegador de la experiencia del usuario virtual en el punto del error. Esto facilita inspeccionar visualmente qué salió mal sin necesidad de reproducir el problema manualmente.

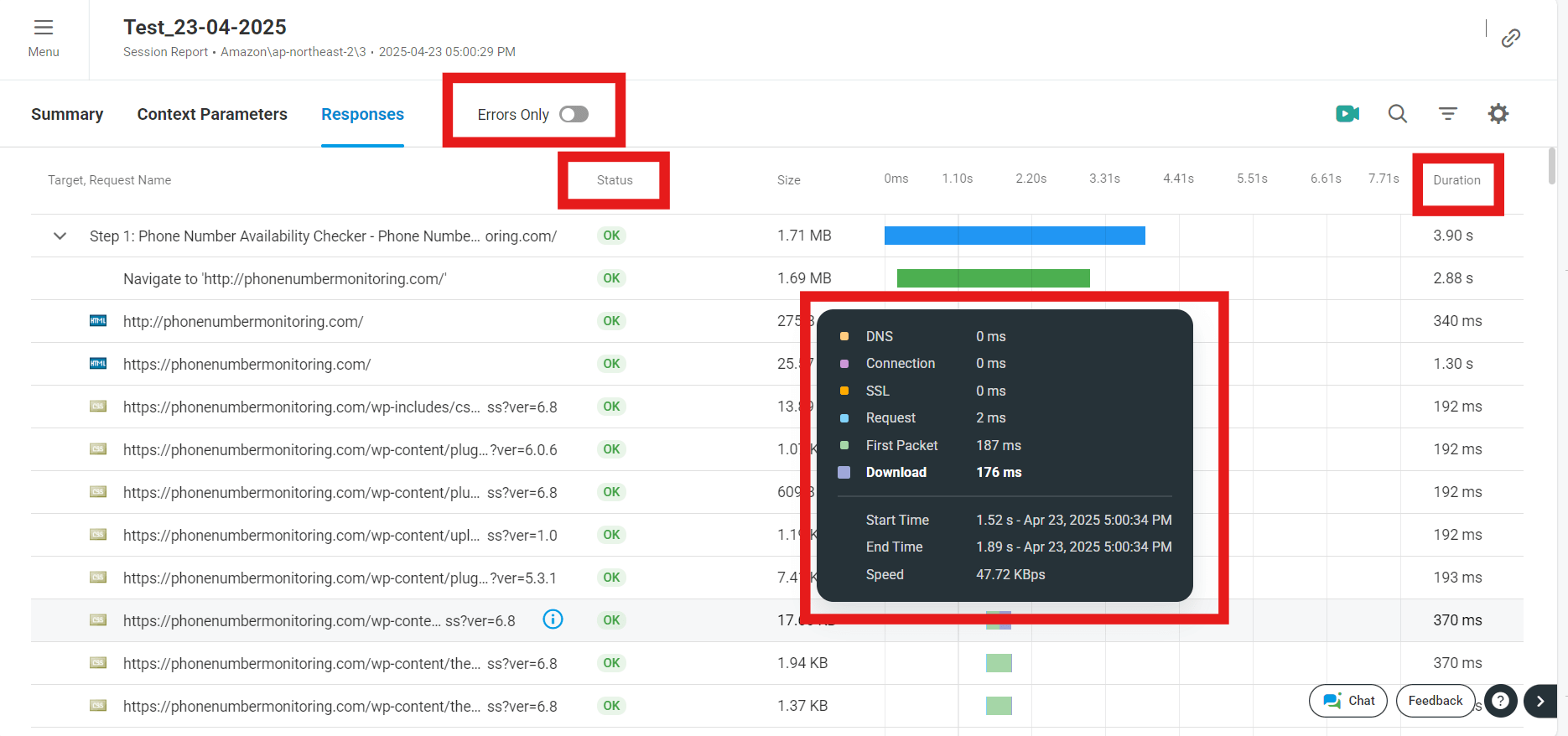

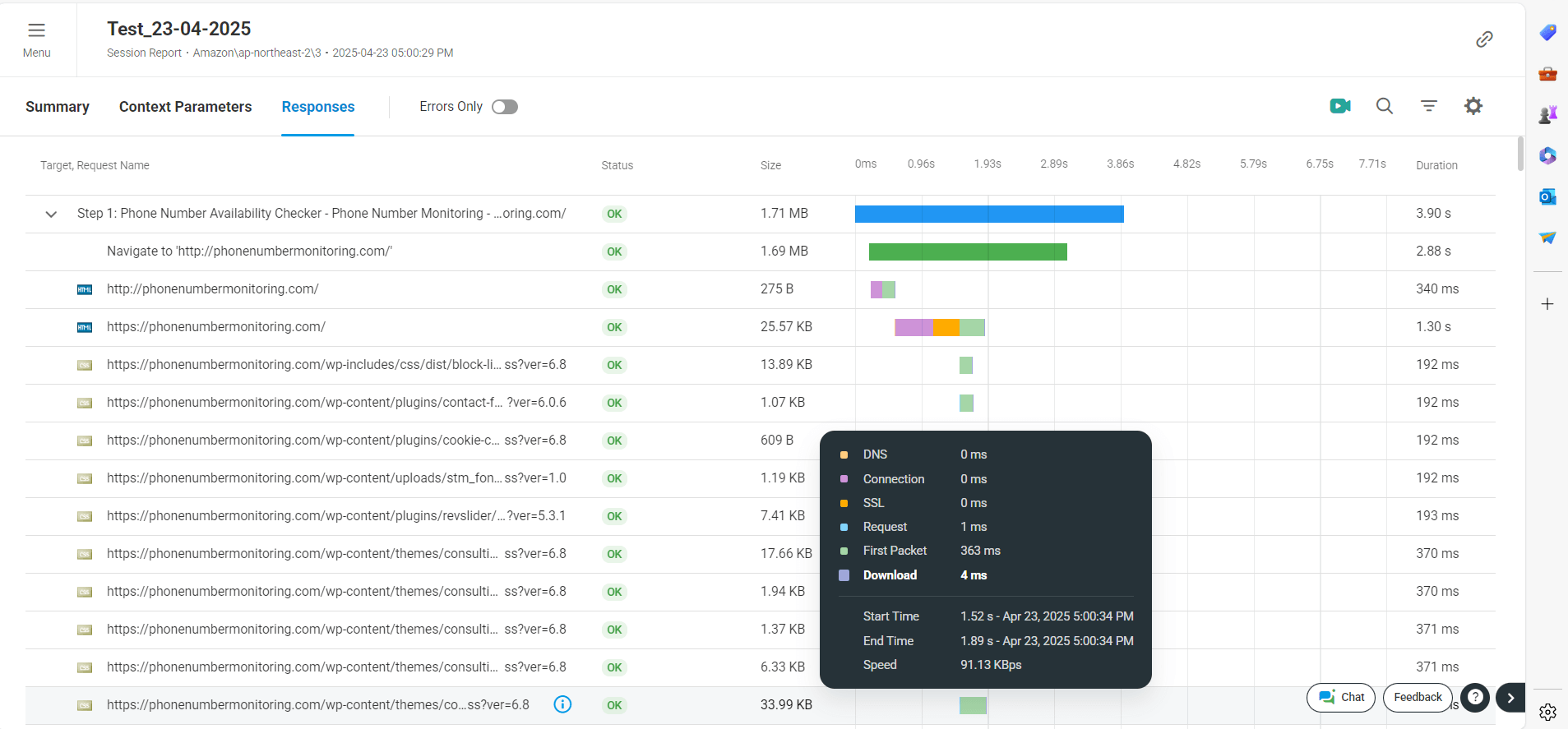

LoadView incluye una función integrada de reproducción de sesión donde puedes ver cómo se ejecutó la prueba realmente en el navegador. Como se muestra en la captura de pantalla, presenta una representación en tiempo real de la aplicación bajo prueba, incluyendo la interacción del usuario con elementos como botones, menús o solicitudes de inicio de sesión. Esto ayuda a los equipos a confirmar visualmente si una página se cargó correctamente, qué elementos se retrasaron y qué vio el usuario cuando ocurrió un error.

Temporización en cascada + Alineación de cuadros de video

Debajo del cuadro de reproducción, LoadView presenta un gráfico en cascada que muestra la secuencia y duración de las llamadas de red realizadas por el navegador. Cada recurso (HTML, JS, CSS, imágenes, APIs) es rastreado con tiempos de inicio y fin. Esta combinación de salida visual y métricas de backend convierte a LoadView en una herramienta completa para el análisis del rendimiento frontend.

Ejemplo de caso de uso: Puedes identificar si un retraso se debió a una hoja de estilos que carga lentamente o a una respuesta API ausente mientras observas visualmente la espera del navegador — algo que las herramientas tradicionales como JMeter no pueden ofrecer

Vinculación de ID de sesión para una reproducción fácil: Cada error está vinculado a un ID de sesión único y un paso de prueba, lo que permite a los evaluadores reproducir rápidamente la sesión o rastrear la secuencia de eventos que llevó al fallo, mejorando drásticamente el tiempo de resolución de errores.

Limitaciones de JMeter:

Registros de error sin contexto visual: JMeter proporciona información de error en forma de códigos de estado HTTP en bruto o trazas de excepciones dentro de archivos .jtl, que no indican qué sucedía en la interfaz de usuario en el momento del error.

Requiere referencias cruzadas manuales: Depurar un error de JMeter implica normalmente correlacionar marcas de tiempo e ID de solicitudes a través de múltiples archivos de registro, registros de aplicaciones y sesiones de navegador — un proceso que consume tiempo y es propenso a errores.

Sin reproducción de sesión ni retroalimentación visual: JMeter opera a nivel de protocolo y no incluye capacidades de reproducción en navegador ni captura de video. Los evaluadores no pueden confirmar visualmente qué se renderizó o qué vio el usuario final durante una prueba.No hay gráfico de cascada ni cronometraje de recursos renderizados por el navegador: JMeter carece de visualizaciones de cascada integradas que muestren los tiempos de carga de recursos frontend. Esto hace que identificar tiempos lentos de carga de CSS, JavaScript o imágenes sea más complejo y manual.

No hay contexto de navegador para depuración: Sin ejecución en navegador, no hay inspección del DOM ni visibilidad de cambios de diseño, errores de renderizado o fallos visuales, lo que limita la utilidad de la herramienta para pruebas de rendimiento frontend y experiencia de usuario.

Mejores casos de uso para JMeter (Pruebas a nivel de protocolo)

JMeter es una herramienta de código abierto que simula carga a nivel HTTP (sin renderizar un navegador), lo que la convierte en una opción potente para pruebas backend y de bajo costo a gran escala. Ideal cuando la interacción con el navegador no es necesaria.

| Caso de uso

1. Pruebas de carga de API |

Por qué JMeter funciona bien | Ejemplo |

| Soporta APIs REST, SOAP y GraphQL de forma nativa. Fácil agregar cabeceras, parámetros y validar JSON/XML. | Pruebas de carga para una API de pasarela de pago o microservicios internos | |

| 2. Pruebas de carga de base de datos | El muestreador JDBC soporta interacción directa con bases de datos; útil para pruebas de estrés de consultas. | Prueba de carga en un motor de informes que consulta MySQL o PostgreSQL |

| 3. Integración CI/CD | Fácilmente integrado con Jenkins, GitHub Actions, GitLab, etc., mediante línea de comandos o plugins. | Ejecutar pruebas JMeter automáticamente tras cada despliegue |

| 4. Pruebas de sistemas de mensajería | Soporta JMS, MQTT y plugins personalizados para Kafka y RabbitMQ. | Pruebas de carga de un sistema basado en eventos usando mensajes JMS |

| 5. Pruebas de carga/subida de archivos | Prueba servicios basados en archivos sobre HTTP/SFTP/FTP. | Simular múltiples usuarios subiendo documentos |

| 6. Pruebas de carga de alto volumen y bajo costo | Ejecución ligera; capaz de simular más de 10,000 usuarios virtuales desde una sola máquina (si no se requiere renderizado). | Pruebas de rendimiento de un CMS interno |

| 7. Lógica personalizada con Groovy/JS/Beanshell | Fácil scripting de flujos personalizados, datos dinámicos o comportamiento de sesión. | Simulación de lógica de aprobación de préstamos con múltiples ramas |

¿Quién debería usar JMeter?

Ingenieros DevOps, desarrolladores backend y testers que se centran en APIs, rendimiento de bases de datos o escenarios de integración sin la necesidad de renderizado en navegador.

Mejores casos de uso para LoadView (Pruebas reales basadas en navegador)

LoadView utiliza navegadores reales (Chrome, Edge) para simular el comportamiento real del usuario,lo que lo hace ideal para aplicaciones web modernas y equipos que priorizan la experiencia del usuario y la validación visual.

| Caso de uso | Por qué LoadView es la mejor opción | Ejemplo |

| 1. Pruebas de carga basadas en navegador | Ejecuta trayectorias de usuario reales con JavaScript, cookies, actualizaciones DOM y renderizado de página. | Prueba de carga de un portal de reserva de viajes |

| 2. Pruebas SPA (React, Angular, Vue) | Gestiona automáticamente el comportamiento asincrónico (AJAX, fetch, websockets) de frameworks JS. | Prueba de un panel de cliente en Angular |

| 3. Validación UX para comercio electrónico | Mide tiempo de carga, FCP, LCP, TTI — métricas reales que impactan la tasa de conversión. | Prueba de carga de un flujo de carrito a pago antes del Black Friday |

| 4. Pruebas geo-distribuidas | Soporta pruebas desde más de 40 ubicaciones para simular el acceso de usuarios desde diferentes regiones. | Prueba de velocidad del sitio desde EE.UU., Europa e India |

| 5. Pruebas de carga sin scripting | Graba flujos como un usuario (clics, desplazamientos, filtros, navegación). No se necesita scripting técnico. | Gerentes de producto o equipos de QA prueban flujos de usuario sin intervención de desarrollo |

| 6. Informes listos para stakeholders | Los informes incluyen reproducciones de sesión, gráficos visuales, exportaciones a PDF — adecuados para usuarios no técnicos o empresariales. | Compartir resultados con vicepresidentes, propietarios de producto o clientes |

| 7. Validación de contenido dinámico | Captura cada cambio de UI, renderizado retardado, ventanas modales o filtros basados en AJAX. | Prueba de un sitio de listados de hoteles con filtros y carga diferida |

¿Quién debería usar LoadView?

Equipos de QA, gerentes de producto, desarrolladores frontend, diseñadores UX y analistas de negocio que validan el rendimiento web moderno, especialmente en SPAs o la validación de flujos de usuario reales.

- LoadView vs JMeter: comparación de funciones de informes

| Acceso y momento del informe de funciones | 🔵 LoadView | 🟠 JMeter |

| Informes en tiempo real, alojados en la nube, accesibles incluso durante la ejecución de la prueba. | Solo post-prueba; sin visibilidad integrada en tiempo real. | |

| Granularidad de datos | Alto detalle con desglose a sesiones individuales y solicitudes de red. | Métricas generales (respuesta media, rendimiento); detalle limitado de sesiones. |

| Visualización | Gráficos interactivos y completos (tiempos de respuesta, tipos de error, actividad del usuario). | Gráficos básicos a través de Listeners (por ejemplo, Informe Resumen); visualización nativa limitada. |

| Panel de Control en Vivo | Panel incorporado con actualizaciones en vivo continuas durante las pruebas. | No incluido; requiere integración externa (por ejemplo, Grafana). |

| Comparación Histórica | Seguimiento automático de tendencias y comparación visual entre múltiples pruebas. | Requiere configuración manual usando herramientas externas como InfluxDB + Grafana. |

| Compartir Informes | Compartición fácil mediante PDFs alojados en la nube y enlaces públicos/privados del panel. | Genera archivos locales HTML/CSV; la compartición debe hacerse manualmente. |

| Análisis de Errores | Clasificación automática de errores: cliente, servidor, validación, terceros, etc. | Registros de errores en bruto (códigos HTTP); se requiere clasificación y análisis manual. |

| Contexto de Depuración | Capturas de pantalla, videos de sesión, repeticiones de sesión y gráficos waterfall. | Sin soporte visual; depende de correlación de registros e investigación manual. |

| Seguimiento de Sesiones | Desglose completo por sesión con navegación paso a paso. | Sin seguimiento nativo de sesiones; requiere analizar registros en bruto. |

| Información Geográfica | Desglose del rendimiento por región; útil para pruebas de carga globales. | Sin soporte incorporado; debe implementarse con scripts o herramientas personalizadas. |

| Métricas Frontend (UX) | Captura métricas del navegador real: FCP, LCP, TTI y Time to Interactive. | No puede capturar métricas UX/navegador debido a operación a nivel de protocolo. |

| Formatos de Informe | PDF, Excel y enlaces interactivos en la nube | HTML y CSV; personalización limitada. |

| Complejidad de Configuración | Configuración mínima; todas las funciones de reporte disponibles desde el inicio en la nube. | Requiere configurar listeners y herramientas externas para reportes avanzados. |

Resumen del Artículo

LoadView ofrece una experiencia avanzada de reportes adaptada para aplicaciones web modernas y dinámicas. Permite:

Acceso en tiempo real a datos en vivo ygráficos durante la ejecución de la prueba.

Profundas perspectivas en los viajes individuales de los usuarios con evidencia visual como reproducciones de sesiones. Compartición y colaboración de informes sin esfuerzo.

Depuración fácil con métricas integradas del navegador, datos geográficos y clasificación detallada de errores.

JMeter, aunque potente para pruebas de rendimiento de API a nivel de protocolo y backend, ofrece:

Informes básicos post-ejecución con visualización limitada.

Sin soporte nativo para métricas basadas en navegador o paneles en tiempo real.

Funciones avanzadas de informes solo alcanzables mediante configuraciones complejas que involucran InfluxDB, Grafana o scripts personalizados.