Dans notre article précédent, Test de Charge Web : JMeter vs. LoadView – Scénario du Monde Réel, nous avons démontré comment simuler un parcours utilisateur typique sur PhoneNumberMonitoring.com — lancement du site, connexion, navigation entre les onglets et déconnexion — en utilisant à la fois Apache JMeter et LoadView. Nous avons mis en lumière les différences fondamentales en termes d’effort de scripting, de complexité de configuration et de facilité d’utilisation globale entre ces deux outils.

S’appuyant sur cet exercice, cet article présente une comparaison détaillée des rapports de performance générés par LoadView et JMeter après l’exécution d’un test de charge avec 10 utilisateurs. Nous nous concentrons sur des aspects critiques comme la précision de l’exécution, les capacités de reporting en temps réel, la gestion du contenu AJAX et dynamique, la visibilité des sessions et l’évolutivité en entreprise.

À mesure que les applications modernes reposent de plus en plus sur l’exécution dynamique de JavaScript, l’évaluation de l’expérience utilisateur via des tests basés sur de vrais navigateurs devient essentielle. Cette comparaison vise à montrer comment chaque outil reflète ces défis du monde réel et lequel fournit des insights plus profonds et exploitables sur la performance du front-end.

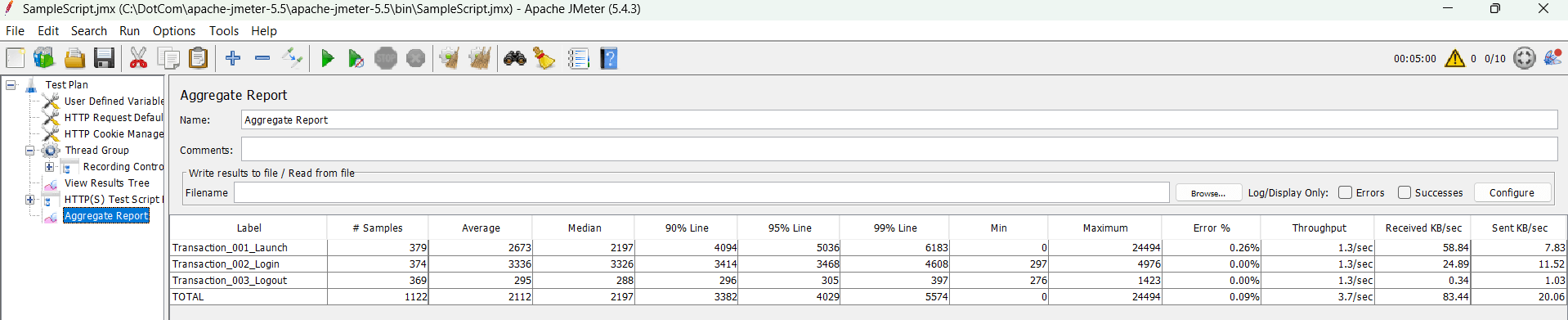

- Capacités de Reporting : Insights Statiques vs Dynamiques JMeter :

Offre des statistiques de performance de base via des écouteurs tels que Aggregate Report et Summary Report : les écouteurs intégrés de JMeter fournissent des métriques de haut niveau comme le temps de réponse moyen, le débit et les pourcentages d’erreur. Cependant, ces sorties sont limitées en granularité et manquent de visualisation pour des parcours utilisateurs complexes.

Nécessite du scripting utilisateur ou des plugins pour les comparaisons historiques : pour analyser les tendances dans le temps, les testeurs doivent configurer manuellement des intégrations avec des bases de données comme InfluxDB et des outils de visualisation comme Grafana, ce qui ajoute de la complexité.

Génère des fichiers HTML ou CSV locaux qui ne sont pas partagés dans le cloud : les rapports sont stockés localement, nécessitant un partage et une coordination manuels, ce qui crée souvent des problèmes de versionnage et d’accessibilité.

Pas de possibilité intégrée d’exploration des sessions utilisateur individuelles : les testeurs ne peuvent pas tracer les problèmes au niveau de la session ; ils doivent recouper manuellement les horodatages dans les logs.

Mode GUI :

Mode Non GUI :

LoadView :

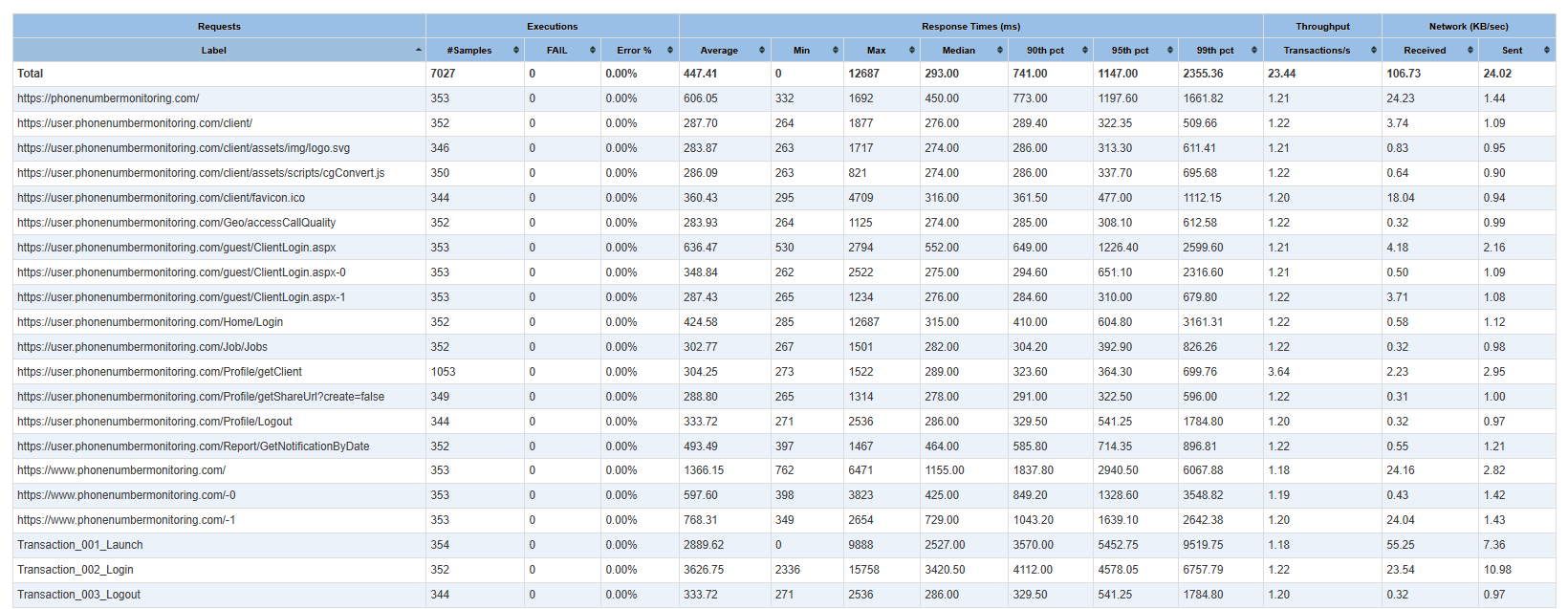

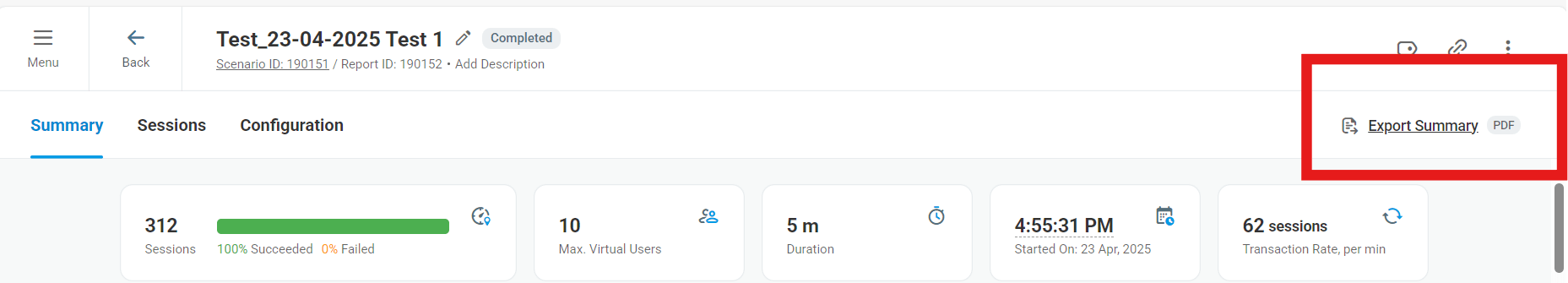

Rapports riches, hébergés dans le cloud, accessibles en temps réel : les métriques de performance en direct sont affichées en continu pendant l’exécution du test.

Mise à jour continue et en temps réel des KPI de performance : les métriques telles que la moyenne rele temps de réponse, le 90e centile, le minimum, le maximum et le taux d’échec se mettent à jour en temps réel.

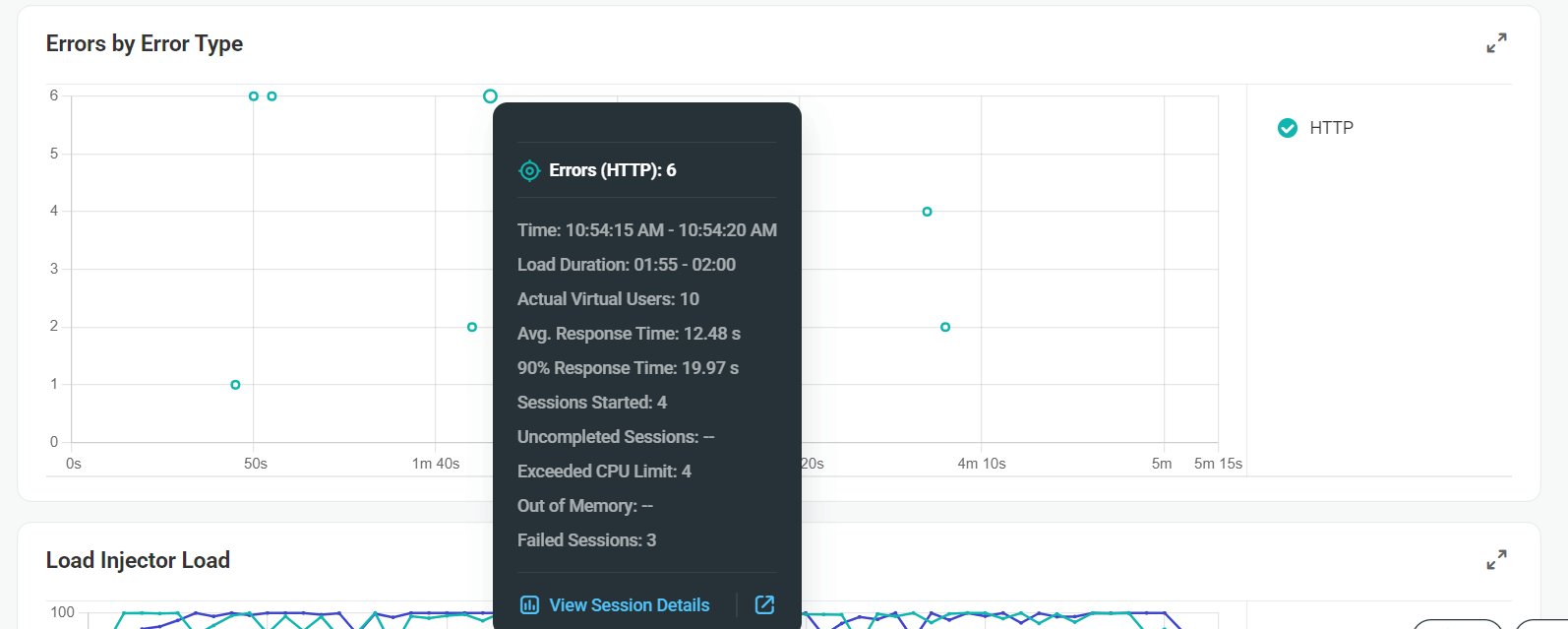

Classification des erreurs pour une analyse plus rapide de la cause première : Les erreurs sont regroupées en catégories validation, client, serveur et tiers.

PDF basé sur le cloud et liens de tableau de bord partageables : Distribuez facilement des tableaux de bord en direct ou exportez des résumés à partager avec les équipes.

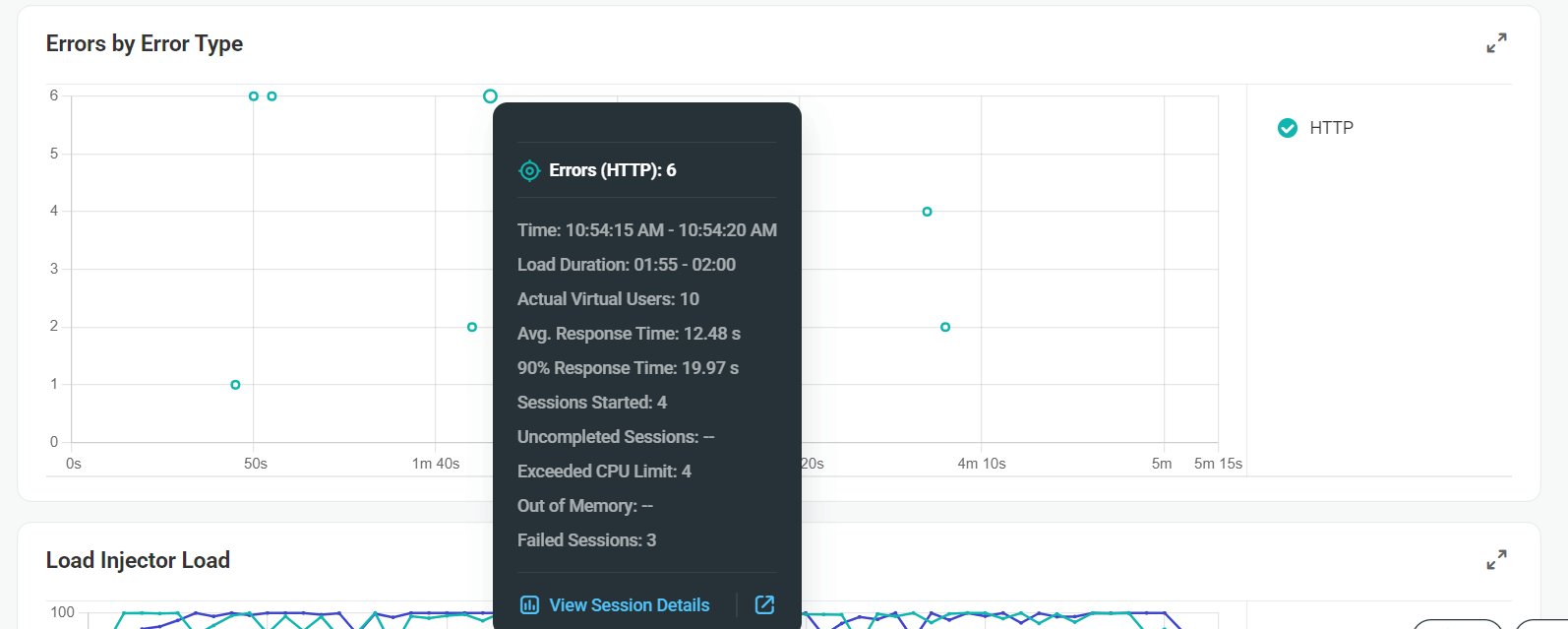

Graphiques interactifs pour les temps de réponse, la répartition des erreurs et l’activité des utilisateurs virtuels : Permet une identification rapide des pics, tendances ou échecs. Une vue récapitulative complète pour surveiller la progression du test en temps réel.

La moitié supérieure montre un pic soudain du temps moyen de réponse, qui corrèle (voir les flèches rouges) avec une baisse des sessions réussies et une hausse des sessions échouées (graphique inférieur). C’est un exemple idéal de la capacité de LoadView à corréler visuellement les dégradations de performance avec le comportement des sessions utilisateurs.

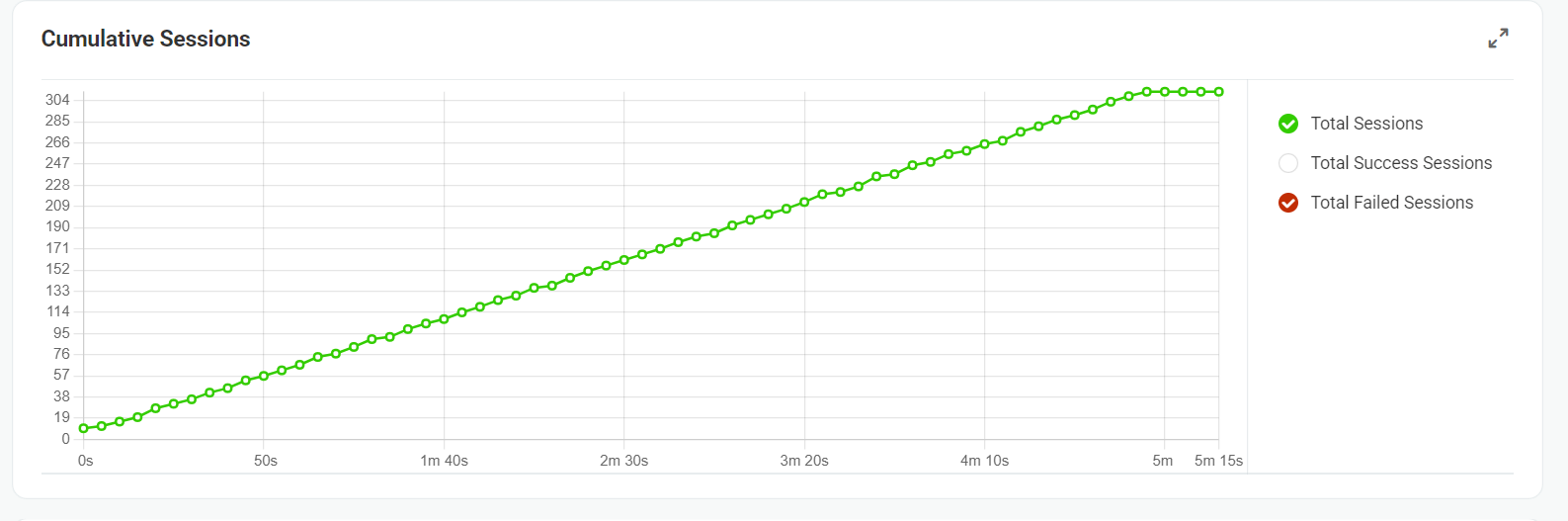

Suivi cumulatif des sessions sur des fenêtres temporelles : Aide à évaluer la cohérence et la stabilité du test tout au long de la période d’exécution.

Courbes de montée en charge des utilisateurs virtuels : Représentation visuelle des augmentations de charge alignées avec la performance des sessions.

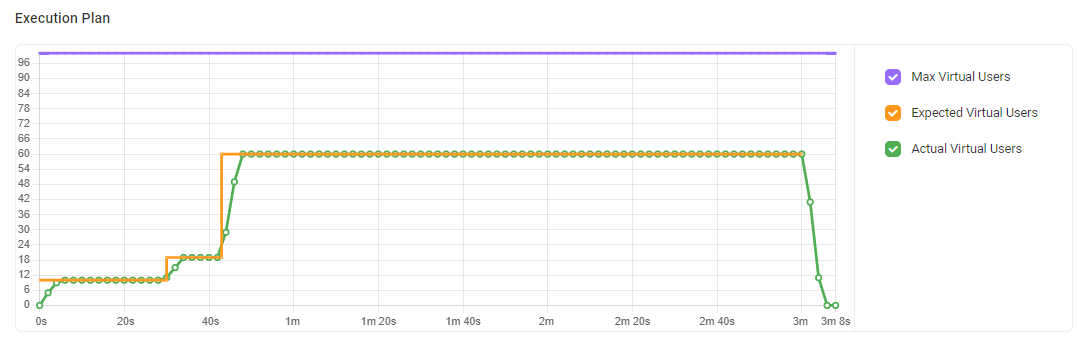

Ce graphique affiche comment les utilisateurs virtuels ont été augmentés dans le temps. La ligne verte montre le nombre réel d’utilisateurs exécutés, correspondant étroitement à la ligne orange (utilisateurs attendus), prouvant un comportement stable de montée et descente en charge. La ligne violette marque la limite maximum configurée pour les utilisateurs virtuels.

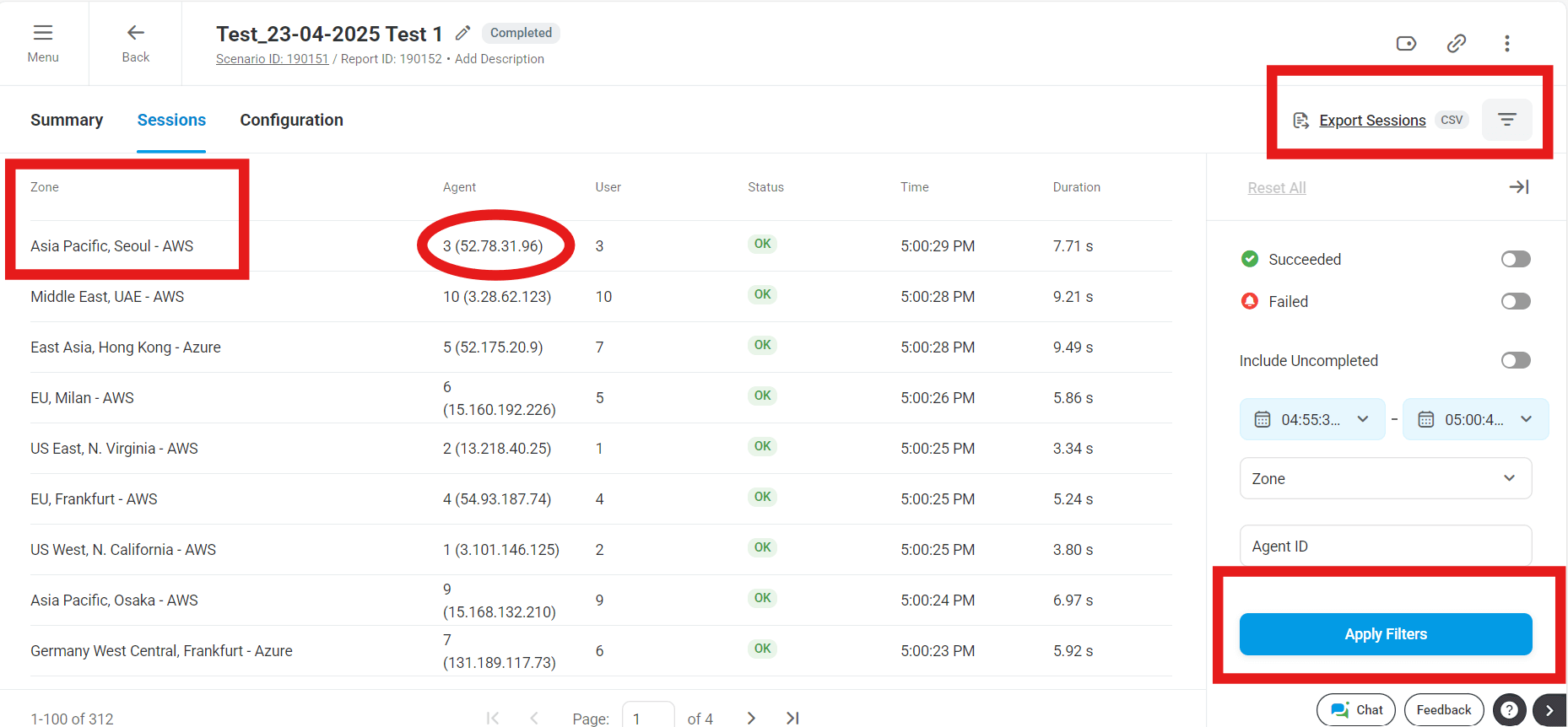

Statistiques serveur de chaque géo-zone : Diagnostique les problèmes spécifiques à une région ou la latence. Navigation par session montrant les parcours individuels des utilisateurs : Explorez le chemin de n’importe quel utilisateur virtuel et les données de réponse associées.

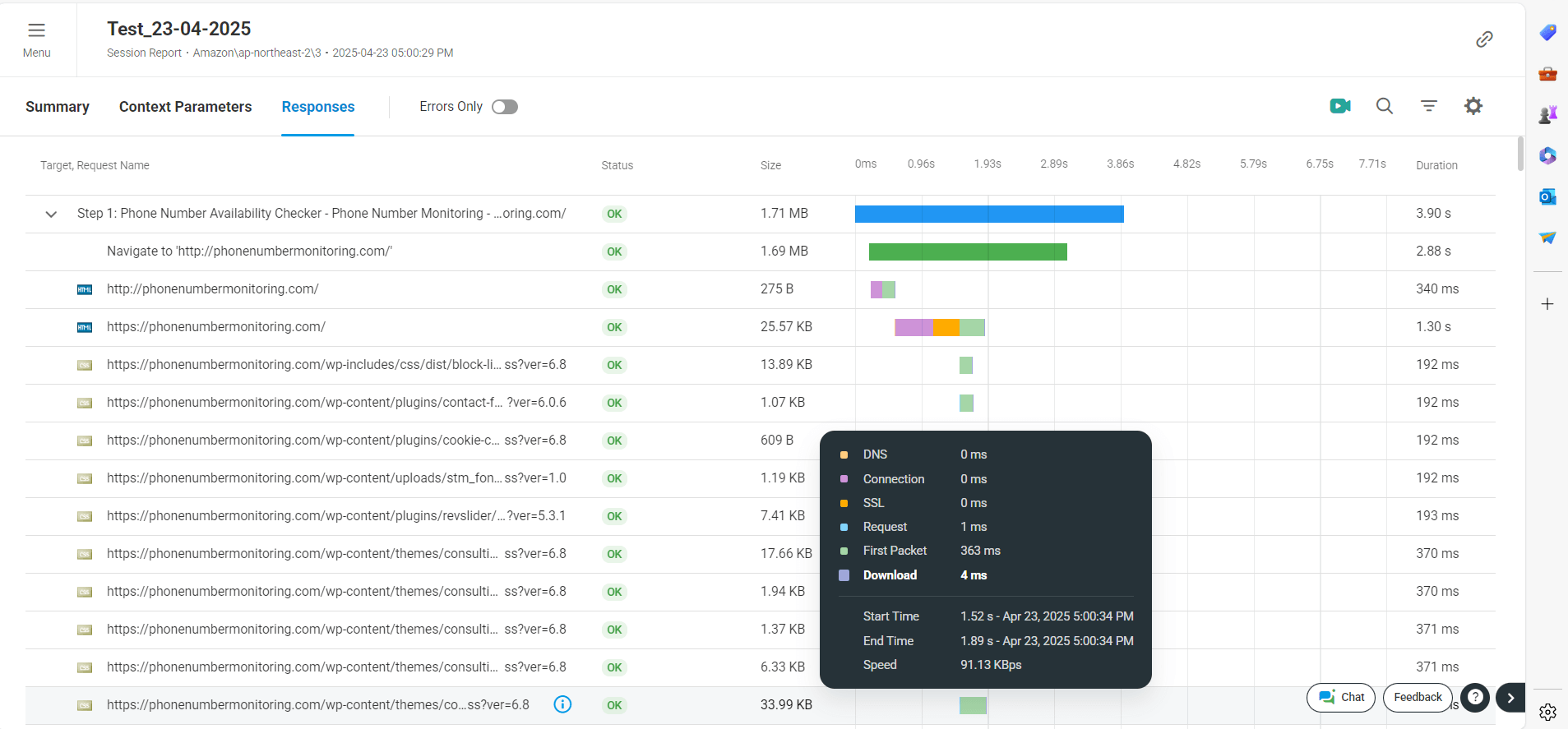

Approfondir des IDs de session spécifiques : Inspectez les parcours de tests individuels et visualisez des informations détaillées de couche réseau par utilisateur, et isolez rapidement la source des erreurs pour une résolution plus rapide.

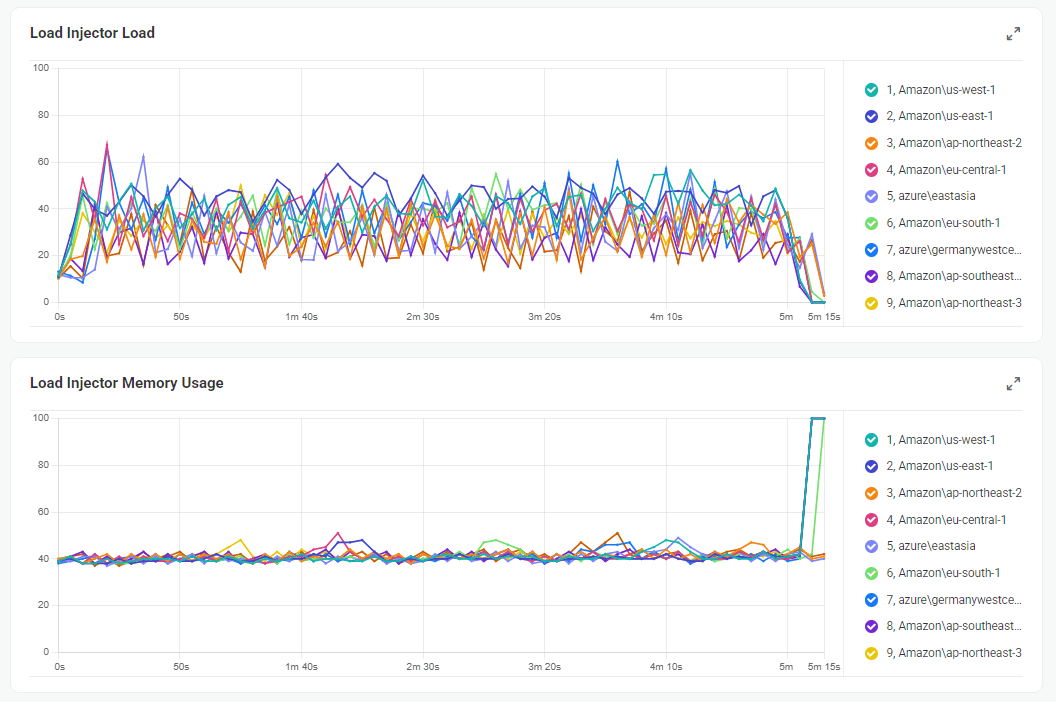

Cela montre comment plusieurs agents cloud (des régions AWS, Azure) ont partagé la charge du test. Le CPU et la mémoire sont restés majoritairement équilibrés tout au long, vérifiant l’architecture de distribution de test élastique de LoadView.

- Limitations de JMeter sur la gestion des appels AJAX et asynchrones :

Opération au niveau protocolaire seulement :

JMeter simule les requêtes au niveau du protocole HTTP niveau, ce qui signifie qu’il ne peut pas exécuter ou interpréter le JavaScript côté client qui déclenche souvent des appels AJAX. Cela entraîne une capture partielle des requêtes, en particulier pour les applications web modernes.

Ne détecte pas l’activité post-chargement :

Les opérations asynchrones déclenchées par les interactions utilisateur — comme les clics sur les boutons, les menus déroulants ou les mises à jour dynamiques de la page — ne sont pas détectées à moins que la séquence exacte des requêtes ne soit scriptée manuellement, ce qui est complexe et peu fiable.

Mauvais support des SPA (React, Angular, Vue) :

Dans les applications mono-page (SPA), le contenu est chargé dynamiquement sans rechargement complet de la page. Comme JMeter ne simule pas le comportement au niveau du navigateur, il ne peut pas interagir avec ou suivre les modifications du DOM après le chargement initial. Tester ces flux avec précision nécessite des contournements fragiles.

Effort manuel pour la simulation AJAX :

Les ingénieurs doivent inspecter manuellement les outils de développement du navigateur pour identifier les points de terminaison asynchrones, puis reproduire le comportement en utilisant des temporisateurs, des temps de réflexion ou une logique personnalisée dans JMeter. Cela augmente la maintenance des tests et introduit des risques de manquer des chemins utilisateur critiques.

Avantages de LoadView :

L’exécution dans un véritable navigateur capture AJAX sans faille :

LoadView utilise de vrais navigateurs (comme Chrome ou Edge), qui supportent et exécutent naturellement tout le JavaScript et les appels AJAX. Cela signifie que chaque déclencheur côté client, aussi dynamique ou retardé soit-il, est capturé avec précision lors de l’exécution du test.

Vraie simulation de rendu de bout en bout :

Parce que LoadView voit la page comme un utilisateur réel, des événements tels que le contenu chargé à la demande, le défilement infini et les widgets de rafraîchissement automatique sont complètement testés — sans nécessiter de code personnalisé ni de temporisateurs de délai.

Zéro script pour la logique asynchrone :

Les testeurs peuvent enregistrer des scripts simplement en interagissant avec l’application (clics, survols, défilements), et LoadView cartographie automatiquement toute l’activité réseau déclenchée — y compris les requêtes AJAX en chaîne. Cela élimine les conjectures et réduit le temps de création des scripts.

Compatibilité SPA prête à l’emploi :

LoadView peut tester les applications construites avec des frameworks front-end modernes comme Angular, React et Vue sans configuration supplémentaire. Comme la navigation et les mises à jour de données se produisent dans la vue du navigateur, LoadView capture tout, comme une vraie expérience utilisateur.

Chronométrages des réponses précis y compris les délais asynchrones :

Comme les applications riches en AJAX retardent souvent l’affichage des contenus clés jusqu’à ce que les données asynchrones soient chargées, les métriques de LoadView reflètent ces délais avec précision — garantissant que les SLA de performance sont basés sur les temps de chargement perçus par l’utilisateur, et non sur la simple réponse serveur.

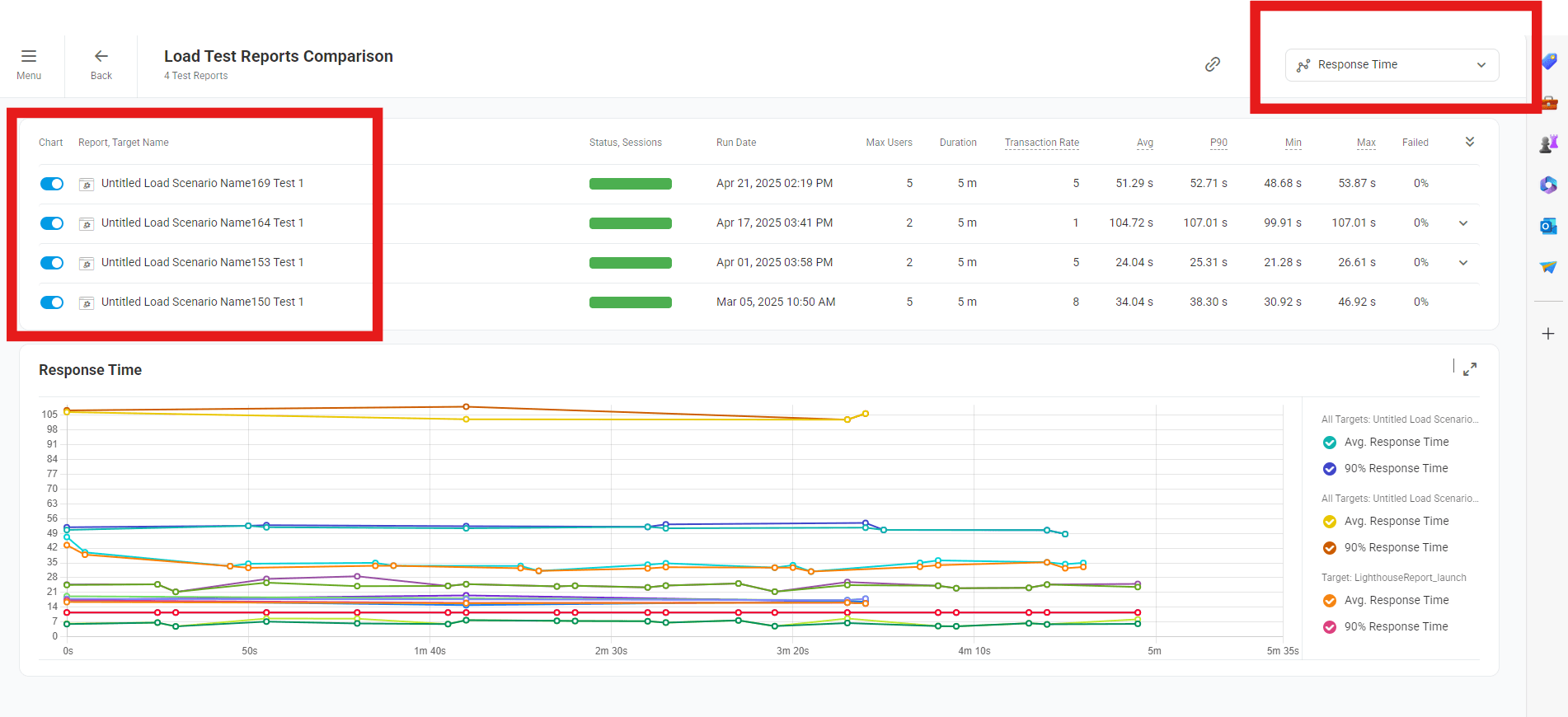

- Comparaison historique des exécutions de test dans LoadView : comparer les résultats de plusieurs exécutions de test

Bien que les rapports en temps réel et statiques soient précieux, LoadView offre également un suivi des tendances historiques prêt à l’emploi. Chaque exécution de testest archivée automatiquement et peut être comparée aux exécutions précédentes.

Vue des performances Avant/Après

Cela permet aux équipes d’évaluer les changements apportés au code de l’application, à l’infrastructure ou aux services tiers en comparant directement les bases de référence de performance précédentes avec les résultats les plus récents—sans intégration ou configuration complexes.

Aucun réglage requis

Contrairement à JMeter, qui nécessite une intégration avec InfluxDB et Grafana pour la visualisation historique, LoadView facilite la comparaison des tendances grâce à une simple interface web. Aucun outil externe n’est nécessaire.

Exemple : Une équipe de développement peut comparer un test effectué il y a deux semaines (avant une optimisation de base de données) avec la dernière exécution et voir immédiatement les améliorations du temps de réponse et des taux d’erreur.

Limitations de JMeter :

Pas de tableau de bord en direct intégré : JMeter ne fournit pas de visibilité en temps réel sur l’exécution des tests en cours. Vous devez attendre la fin du test pour voir les résultats.

Analyse post-exécution seulement : Toute défaillance ou problème est identifié après la fin du test, retardant l’investigation de la cause première et limitant l’optimisation pendant le test.

Outils externes nécessaires pour la vue en direct : Les métriques en temps réel nécessitent la configuration de bases de données externes (par ex., InfluxDB) et de plateformes de visualisation (par ex., Grafana), ajoutant complexité et surcharge opérationnelle.

Corrélation manuelle des logs : Analyser les erreurs nécessite de parser manuellement les fichiers .jtl, de les mapper aux logs ou outils de surveillance applicative — un processus fastidieux et chronophage surtout pour les processus multi-étapes.

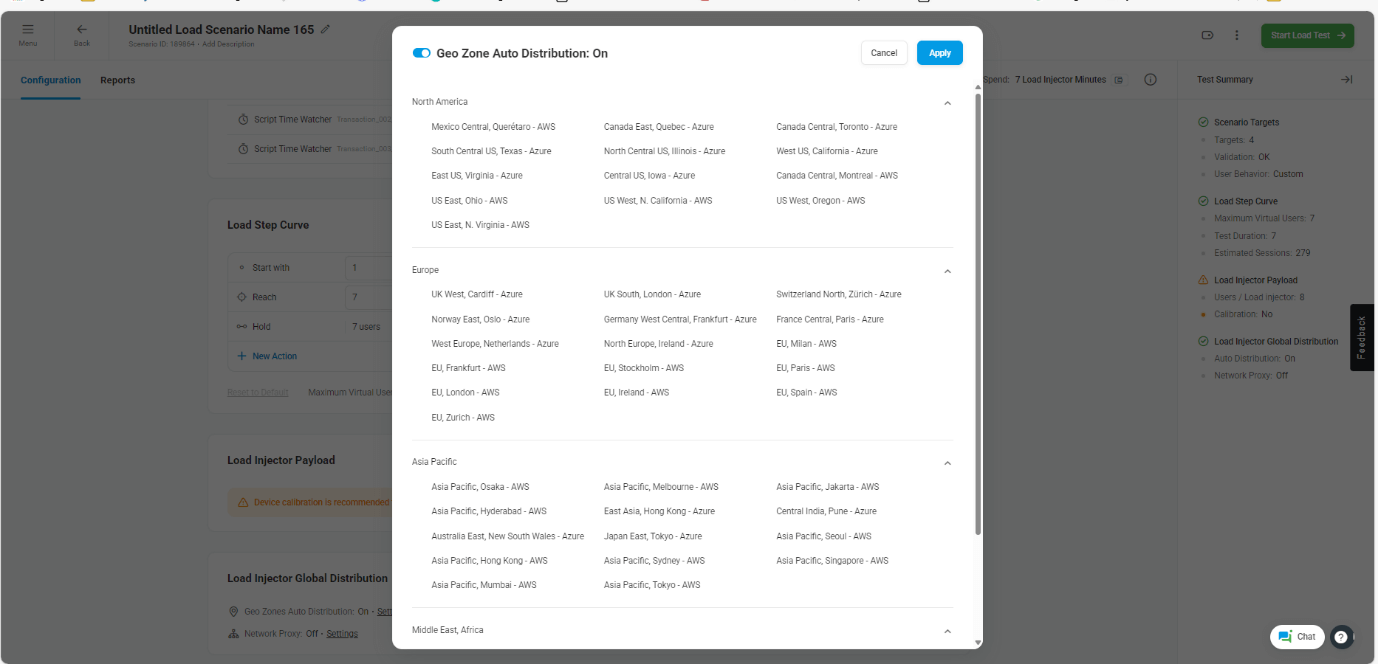

- Simulation de charge au niveau IP et géo-localisée – Forces de LoadView :

Vraie distribution globale : LoadView vous permet de simuler le trafic depuis plus de 40 emplacements cloud géographiquement diversifiés à travers le monde. Cela aide à garantir que les applications offrent des performances cohérentes à travers différentes régions. Par exemple si vous devez savoir comment votre application fonctionne depuis Singapour, Londres et Sao Paulo, LoadView peut le faire en un clic.

Informations cartographiées par géolocalisation IP : Chaque session utilisateur virtuelle est associée à une adresse IP et une localisation géographique. LoadView décompose les métriques de performance comme le temps de réponse et le taux d’erreur par emplacement pour aider à identifier les ralentissements régionaux ou les pannes.

Diagnostic serveur spécifique à la zone : LoadView suit les tendances de performance pour des zones géographiques individuelles, facilitant l’isolement des problèmes d’infrastructure comme les surcharges de serveurs régionaux ou les pannes des CDN en périphérie.

Aucun paramétrage de serveur distant requis : Contrairement aux approches traditionnelles de test distribué, LoadView ne nécessite pas la configuration ou la maintenance d’agents JMeter distants ou de serveurs cloud. Toute la géo-distributionest géré de manière transparente via l’infrastructure cloud de LoadView.

Limitations de JMeter :

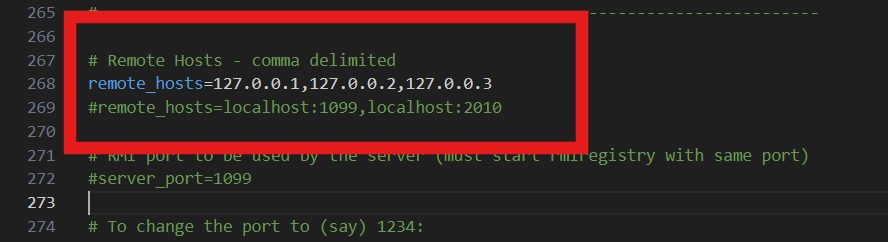

Configuration manuelle des tests distribués : Pour simuler des utilisateurs depuis différents endroits, les testeurs doivent configurer manuellement des agents JMeter distants et établir une communication maître-esclave, ce qui peut être fragile et complexe.

Problèmes de réseau/pare-feu : L’exécution distribuée dans JMeter rencontre souvent des problèmes avec les pare-feux d’entreprise, les configurations NAT et les exigences d’ouverture de ports qui ralentissent la configuration des tests et leur fiabilité.

Pas de visibilité régionale des erreurs : JMeter ne fournit pas nativement de données de performance segmentées par région. Les testeurs doivent implémenter un marquage IP personnalisé ou post-traiter les résultats pour découvrir des tendances géographiques.

- Tests en navigateur réel vs simulation de protocole : forces de LoadView :

Teste le comportement réel du navigateur : LoadView utilise de vrais navigateurs comme Chrome et Edge pour reproduire l’expérience utilisateur finale réelle. Cela inclut l’exécution de JavaScript, le rendu CSS, les pop-ups, les redirections et tous les comportements dynamiques du front-end.

Capture des métriques frontend du monde réel : Les métriques clés de performance telles que le Time to First Byte (TTFB), le First Contentful Paint (FCP), le Largest Contentful Paint (LCP), le Cumulative Layout Shift (CLS) et le Time to Interactive (TTI) sont mesurées directement depuis le contexte du navigateur. Elles sont essentielles pour comprendre la performance perçue par l’utilisateur.

Diagnostique les goulots d’étranglement du frontend : LoadView capture des captures d’écran, génère des graphiques et affiche les chronologies du navigateur pour que vous puissiez voir précisément quels éléments visuels ou dynamiques sont lents à charger, permettant aux équipes frontend d’optimiser la mise en page et l’interactivité.

Limitations de JMeter :

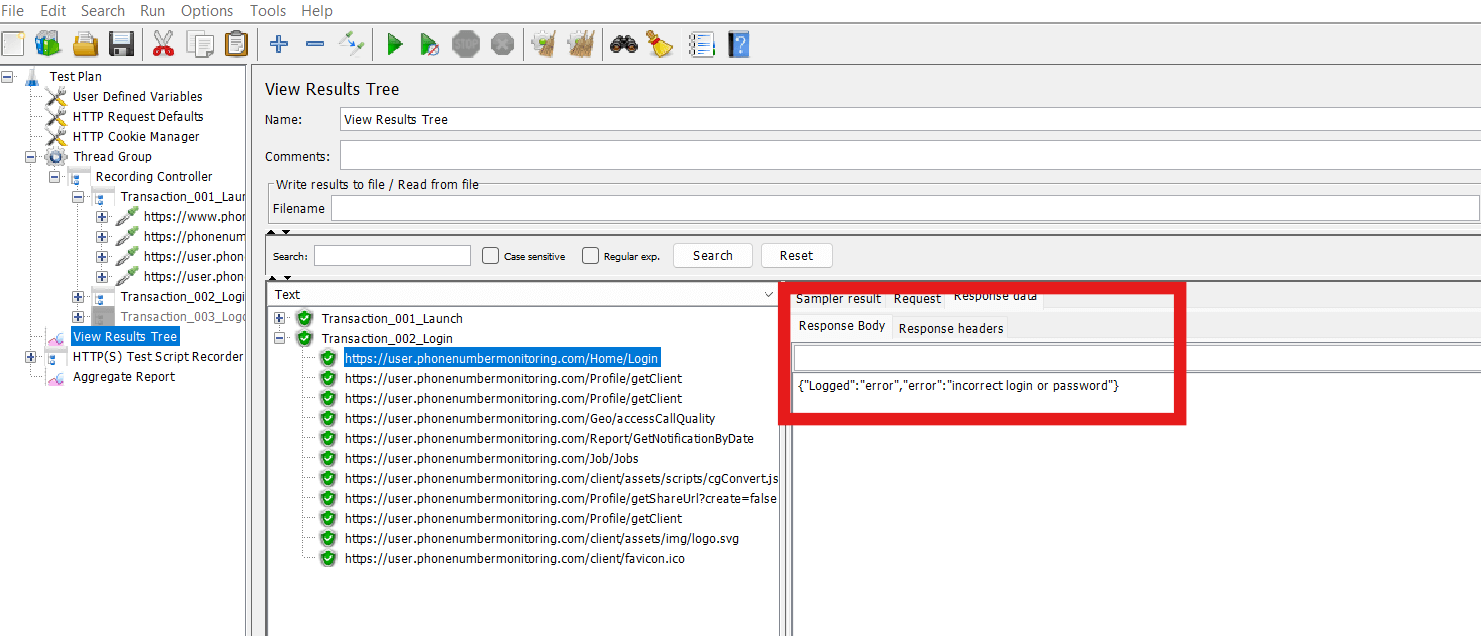

Simulation uniquement au niveau protocolaire : JMeter fonctionne uniquement au niveau du protocole réseau (HTTP/S), il ne rend donc pas la page ni n’exécute le code côté client.

Ne détecte pas les erreurs de rendu côté client : Tout problème survenant après le chargement initial de la page, comme les erreurs runtime JavaScript ou les composants UI lents, n’est pas capturé.

Il ne capture que les messages d’erreur obtenus dans la réponse mais retourne toujours un code de réponse 200, ce qui est trompeur.

Impossible de mesurer la vraie performance UX : Sans moteur de rendu de navigateur, JMeter ne peut pas évaluer les métriques centrées utilisateur comme les temps de peinture ou les décalages de mise en page, limitant son usage pour la validation des performances frontend.

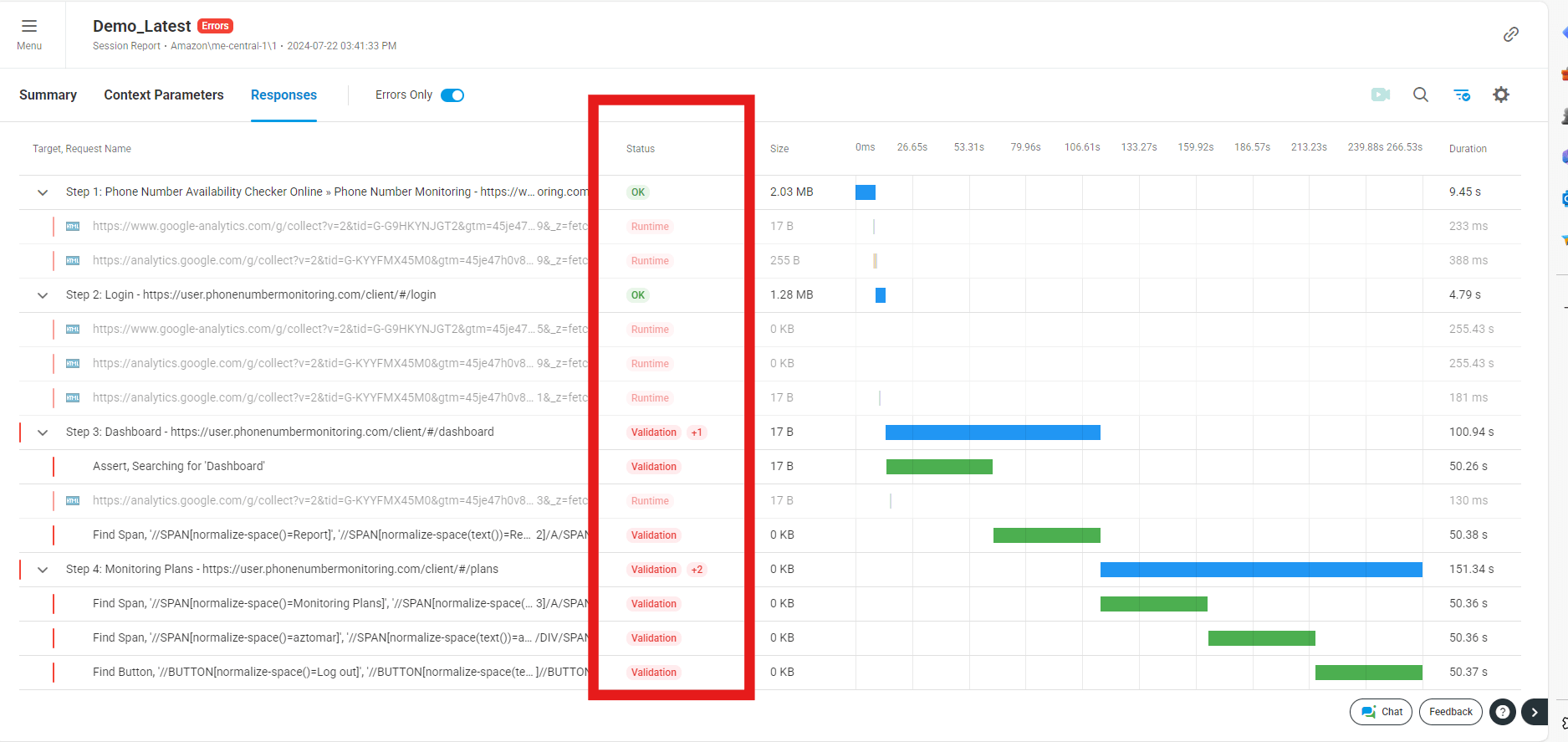

- Catégorisation des erreurs et débogage : forces de LoadView :

Classification automatique des erreurs : LoadView intelligently regroupe les erreurs en catégories prédéfinies — telles que les erreurs de validation (par exemple, texte manquant, élément non trouvé), erreurs côté client (timeouts, plantages de script), erreurs serveur (HTTP 500, 503) et défaillances tierces (indisponibilité d’un service externe ou d’une API). Cela aide les équipes à comprendre immédiatement la nature et la source de la défaillance.

Captures d’écran et vidéos de session : Pour chaque défaillance significative, LoadView capture une capture d’écran ou un enregistrement vidéo du navigateur de l’expérience de l’utilisateur virtuel au moment de l’erreur. Cela facilite l’inspection visuelle de ce qui a mal tourné sans avoir à reproduire manuellement le problème.

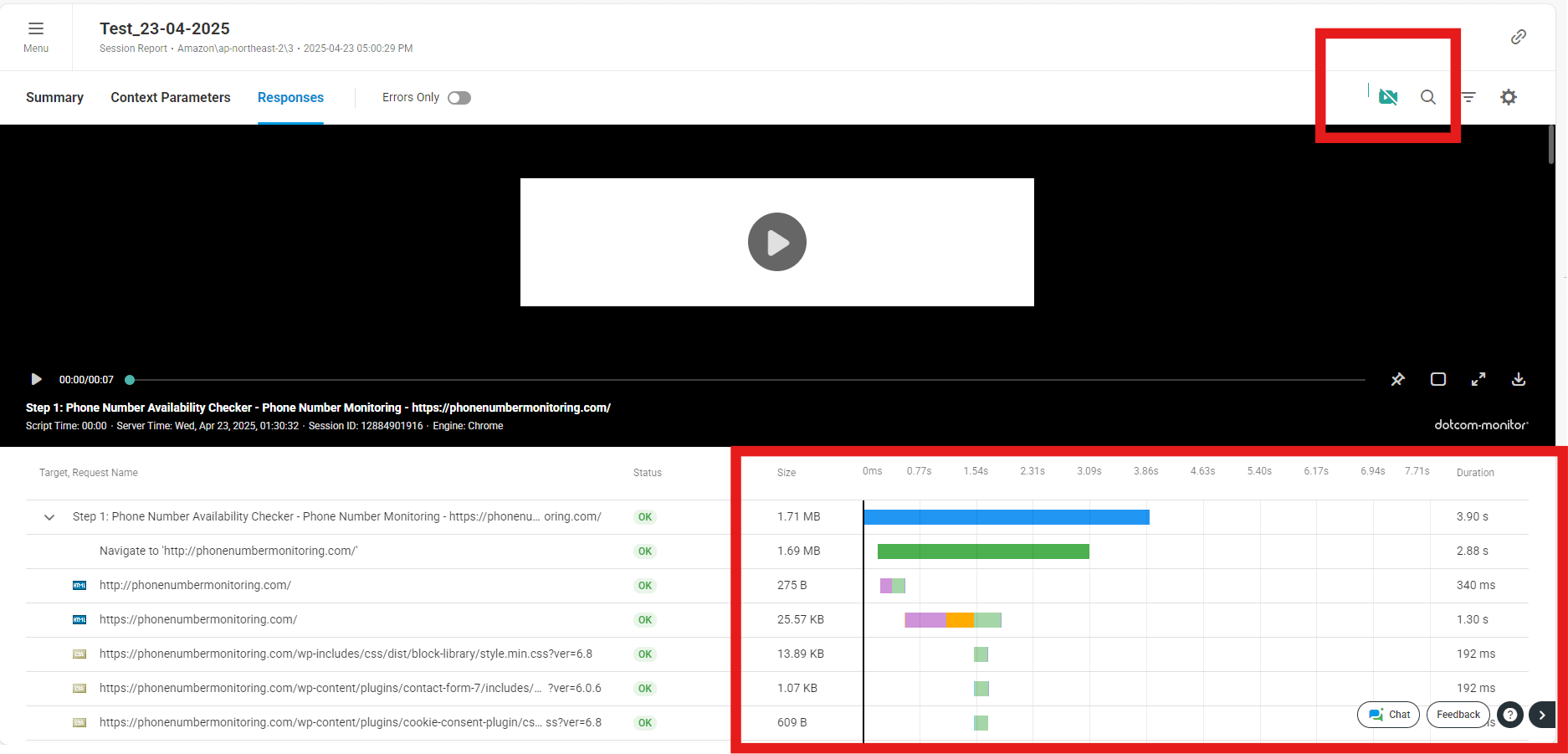

LoadView inclut une fonctionnalité intégrée de relecture de session où vous pouvez voir comment le test s’est réellement déroulé dans le navigateur. Comme illustré dans la capture d’écran, il affiche un rendu en temps réel de l’application testée, y compris l’interaction de l’utilisateur avec des éléments comme les boutons, menus ou invites de connexion. Cela aide les équipes à confirmer visuellement si une page s’est chargée correctement, quels éléments ont été retardés, et ce que l’utilisateur a vu lors d’une erreur.

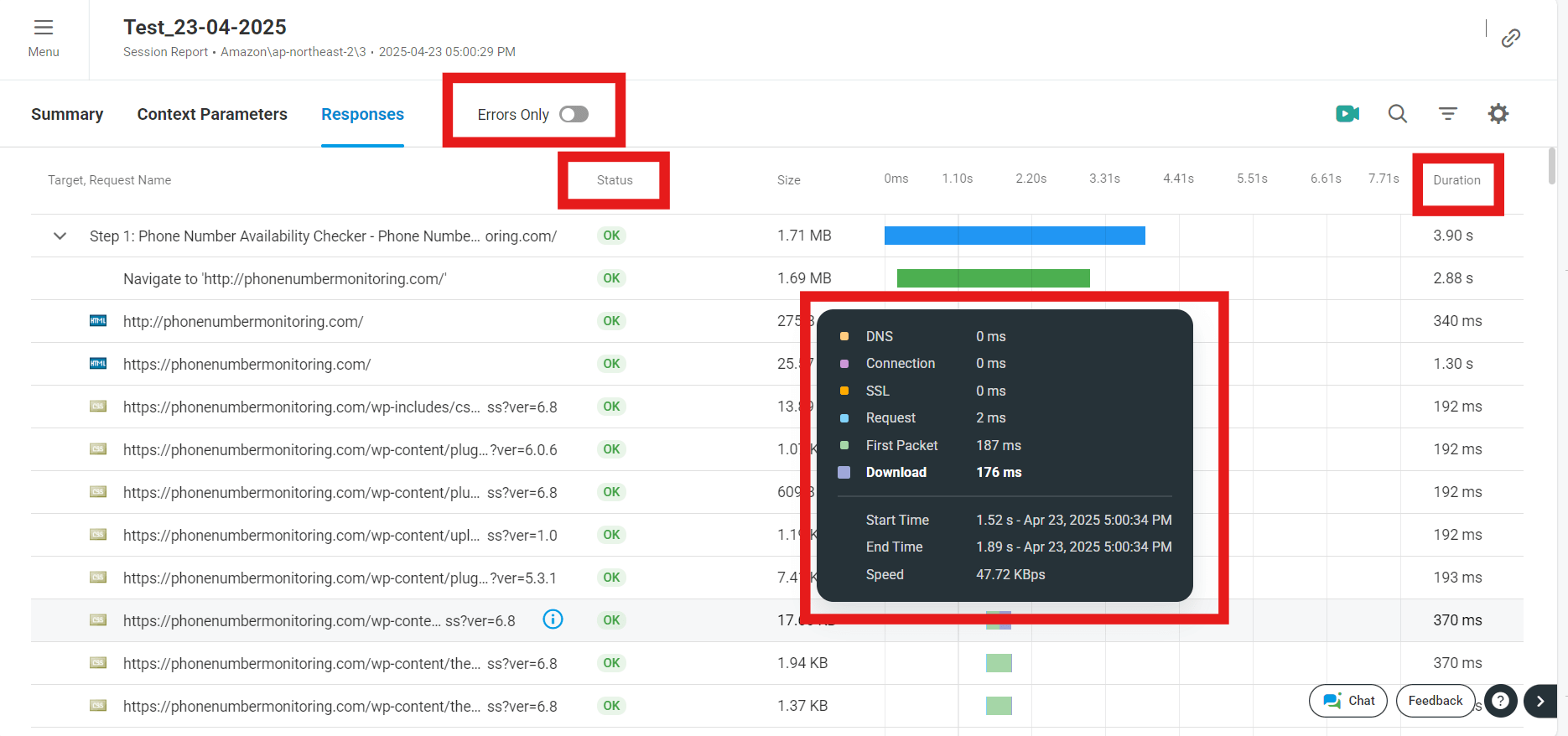

Chronologie Waterfall + Alignement des images vidéo

Sous le cadre de lecture, LoadView présente un graphique en cascade montrant la séquence et la durée des appels réseau effectués par le navigateur. Chaque ressource (HTML, JS, CSS, images, API) est suivie avec les temps de début et de fin. Cette combinaison de sortie visuelle et de métriques backend fait de LoadView un outil complet pour l’analyse des performances frontend.

Cas d’utilisation exemple : Vous pouvez identifier si un retard était dû à une feuille de style se chargeant lentement ou à une réponse API manquante tout en regardant visuellement le navigateur attendre — ce que les outils traditionnels comme JMeter ne peuvent pas offrir

Liens d’ID de session pour une reproduction facile : Chaque erreur est liée à un identifiant de session unique et à une étape de test, permettant aux testeurs de rejouer rapidement la session ou de retracer la séquence d’événements ayant conduit à la défaillance, améliorant considérablement le temps de débogage.

Limitations de JMeter :

Journaux d’erreurs bruts sans contexte visuel : JMeter fournit les informations d’erreur sous forme de codes d’état HTTP bruts ou de traces d’exceptions dans des fichiers .jtl, qui n’indiquent pas ce qui se passait sur l’interface utilisateur au moment de l’erreur.

Référencement manuel nécessaire : Le débogage d’une erreur JMeter implique généralement de corréler les horodatages et les ID de requête à travers plusieurs fichiers journaux, journaux d’application et sessions de navigateur — un processus long et sujet aux erreurs.

Pas de relecture de session ni de retour visuel : JMeter fonctionne au niveau du protocole et n’inclut pas de relecture dans le navigateur ni de capacités de capture vidéo. Les testeurs ne peuvent pas confirmer visuellement ce qui a été rendu ou ce que l’utilisateur final a vu pendant un test.Pas de diagramme en cascade ni de chronométrage des ressources rendu par le navigateur : JMeter ne dispose pas de visualisations en cascade intégrées montrant les temps de chargement des ressources frontend. Cela rend l’identification des temps de chargement lents du CSS, du JavaScript ou des images plus complexe et manuelle.

Pas de contexte navigateur pour le débogage : Sans exécution dans un navigateur, il n’y a pas d’inspection du DOM ni de visibilité sur les décalages de mise en page, les erreurs de rendu ou les anomalies visuelles — ce qui limite l’utilité de l’outil pour les tests de performance frontend et d’expérience utilisateur.

Meilleures utilisations de JMeter (tests au niveau protocole)

JMeter est un outil open source qui simule une charge HTTP (sans rendre un navigateur), ce qui en fait une option puissante pour les tests backend et les tests à grande échelle à faible coût. Idéal lorsque l’interaction avec le navigateur n’est pas requise.

| Cas d’utilisation

1. Tests de charge API |

Pourquoi JMeter fonctionne bien | Exemple |

| Prend en charge REST, SOAP et GraphQL API dès la sortie de la boîte. Facile d’ajouter des en-têtes, paramètres et valider JSON/XML. | Test de charge d’une API de passerelle de paiement ou de microservices internes | |

| 2. Tests de charge de base de données | Le sampler JDBC supporte l’interaction directe avec les bases de données ; utile pour les tests de résistance des requêtes. | Test de charge d’un moteur de rapport interrogeant MySQL ou PostgreSQL |

| 3. Intégration CI/CD | Facilement intégré à Jenkins, GitHub Actions, GitLab, etc. via ligne de commande ou plugins. | Exécuter un test JMeter automatiquement après chaque déploiement |

| 4. Tests de systèmes de messagerie | Supporte JMS, MQTT et plugins personnalisés pour Kafka et RabbitMQ. | Tests de charge d’un système événementiel utilisant des messages JMS |

| 5. Tests de téléchargement / téléversement de fichiers | Tester les services basés sur les fichiers via HTTP/SFTP/FTP. | Simuler plusieurs utilisateurs téléversant des documents |

| 6. Tests de charge à volume élevé et à faible coût | Exécution légère ; capable de simuler plus de 10 000 utilisateurs virtuels à partir d’une seule machine (si aucun rendu n’est nécessaire). | Test de performance d’un CMS interne |

| 7. Logique personnalisée avec Groovy/JS/Beanshell | Scripts faciles pour des flux personnalisés, des données dynamiques ou des comportements de session. | Simulation de la logique d’approbation de prêt avec plusieurs branches |

Qui devrait utiliser JMeter ?

Les ingénieurs DevOps, développeurs backend et testeurs se concentrant sur les API, la performance des bases de données ou les scénarios d’intégration sans besoin de rendu navigateur.

Meilleures utilisations de LoadView (tests basés sur un vrai navigateur)

LoadView utilise de vrais navigateurs (Chrome, Edge) pour simuler le comportement réel des utilisateurs,ce qui le rend idéal pour les applications web modernes et les équipes qui privilégient l’expérience utilisateur et la validation visuelle.

| Cas d’utilisation | Pourquoi LoadView est le meilleur choix | Exemple |

| 1. Test de charge basé sur le navigateur | Exécute de véritables parcours utilisateur avec JavaScript, cookies, mises à jour du DOM et rendu de page. | Test de charge d’un portail de réservation de voyages |

| 2. Test SPA (React, Angular, Vue) | Gère automatiquement le comportement asynchrone (AJAX, fetch, websockets) des frameworks JS. | Test d’un tableau de bord client en Angular |

| 3. Validation UX E-commerce | Mesure le temps de chargement, FCP, LCP, TTI — métriques réelles impactant le taux de conversion. | Test de charge d’un flux panier-à-checkout avant le Black Friday |

| 4. Test géo-distribué | Supporte les tests depuis plus de 40 emplacements pour imiter l’accès utilisateur depuis différentes régions. | Test de la vitesse du site depuis les États-Unis, l’Europe et l’Inde |

| 5. Test de charge sans script | Enregistre les flux comme un utilisateur (clics, défilements, filtres, navigation). Aucun script technique requis. | Les chefs de produit ou équipes QA testent les flux utilisateur sans intervention des développeurs |

| 6. Rapports prêts pour les parties prenantes | Les rapports incluent des replays de session, graphiques visuels, exports PDF — adaptés aux utilisateurs métier/non techniques. | Partager les résultats avec les VP, propriétaires de produit ou clients |

| 7. Validation du contenu dynamique | Capture chaque changement UI, rendu différé, fenêtres modales ou filtres basés sur AJAX. | Test d’un site de liste d’hôtels avec filtres et chargement paresseux |

Qui devrait utiliser LoadView ?

Les équipes QA, chefs de produit, développeurs frontend, designers UX et analystes métier validant la performance web moderne, particulièrement dans les SPA ou la validation de flux utilisateur réel.

- LoadView vs JMeter : comparaison des fonctionnalités de reporting

| Accès & timing des rapports | 🔵 LoadView | 🟠 JMeter |

| Rapports cloud en temps réel accessibles même pendant l’exécution des tests. | Uniquement post-test ; pas de visibilité temps réel intégrée. | |

| Granularité des données | Détail élevé avec possibilité d’approfondir par session individuelle et requêtes réseau. | Métriques globales (réponse moyenne, débit) ; détail limité des sessions. |

| Visualisation | Graphiques riches et interactifs (temps de réponse, types d’erreurs, activité utilisateur). | Graphiques basiques via Listeners (par ex., Rapport Résumé) ; visualisation native limitée. |

| Tableau de bord en direct | Tableau de bord intégré avec mises à jour continues en temps réel lors des tests. | Non inclus ; nécessite une intégration externe (par ex., Grafana). |

| Comparaison historique | Suivi automatique des tendances et comparaison visuelle entre plusieurs tests. | Nécessite une configuration manuelle avec des outils externes comme InfluxDB + Grafana. |

| Partage de rapports | Partage facile via PDFs hébergés dans le cloud et liens publics/privés du tableau de bord. | Génère des fichiers HTML/CSV locaux ; le partage se fait manuellement. |

| Analyse des erreurs | Auto-classification des erreurs : client, serveur, validation, tiers, etc. | Journaux bruts des erreurs (codes HTTP) ; classification et analyse manuelles requises. |

| Contexte de débogage | Captures d’écran, vidéos de session, replays de session et graphiques en cascade. | Pas de support visuel ; repose sur la corrélation des logs et l’investigation manuelle. |

| Suivi des sessions | Détail complet par session avec navigation pas à pas. | Pas de suivi natif des sessions ; nécessite l’analyse des logs bruts. |

| Insights géographiques | Détail des performances par région ; utile pour les tests de charge globaux. | Pas de support intégré ; nécessite l’implémentation de scripts ou outils personnalisés. |

| Métriques Frontend (UX) | Capture des métriques réelles du navigateur : FCP, LCP, TTI, et Temps d’Interaction. | Impossible de capturer les métriques UX/navigateur à cause du fonctionnement au niveau du protocole. |

| Formats de rapport | PDF, Excel, et liens interactifs dans le cloud | HTML et CSV ; personnalisation limitée. |

| Complexité d’installation | Installation minimale ; toutes les fonctionnalités de rapport disponibles immédiatement dans le cloud. | Nécessite la configuration des listeners et outils externes pour des rapports avancés. |

Résumé de l’article

LoadView offre une expérience de reporting avancée adaptée aux applications web modernes et dynamiques. Il permet :

Un accès en temps réel aux données en direct et graphiques pendant l’exécution des tests.

Des informations approfondies sur les parcours d’utilisateurs individuels avec des preuves visuelles telles que les relectures de session. Partage de rapports et collaboration sans effort.

Débogage facile avec des métriques intégrées du navigateur, des informations géographiques et une classification détaillée des erreurs.

JMeter, bien que puissant pour les tests de performances API au niveau protocolaire et backend, offre :

Des rapports post-exécution basiques avec une visualisation limitée.

Pas de support natif pour les métriques basées sur le navigateur ou les tableaux de bord en temps réel.

Des fonctionnalités avancées de reporting réalisables uniquement via des configurations complexes impliquant InfluxDB, Grafana ou des scripts personnalisés.