In unserem vorherigen Artikel, Web Load Testing: JMeter vs. LoadView – Real-World-Szenario, haben wir gezeigt, wie man mit Apache JMeter und LoadView eine typische Nutzerreise auf PhoneNumberMonitoring.com simuliert – die Webseite zu starten, sich anzumelden, Tabs zu navigieren und sich abzumelden. Wir haben dabei die grundlegenden Unterschiede im Skriptingaufwand, der Komplexität der Einrichtung und der Benutzerfreundlichkeit dieser beiden Tools hervorgehoben.

Aufbauend auf dieser Übung stellt dieser Artikel einen detaillierten Vergleich der von LoadView und JMeter erzeugten Performance-Berichte vor, nachdem ein Lasttest mit 10 Nutzern durchgeführt wurde. Wir konzentrieren uns auf kritische Aspekte wie Ausführungsgenauigkeit, Echtzeitberichterstattung, Umgang mit AJAX und dynamischen Inhalten, Sitzungsübersicht und Unternehmensskalierbarkeit.

Da moderne Anwendungen zunehmend auf dynamische JavaScript-Ausführung setzen, wird die Bewertung der Nutzererfahrung durch echten browserbasierten Test unerlässlich. Dieser Vergleich soll zeigen, wie jedes Tool diese Herausforderungen aus der Praxis widerspiegelt und welches tiefere, verwertbare Einblicke in die Frontend-Performance bietet.

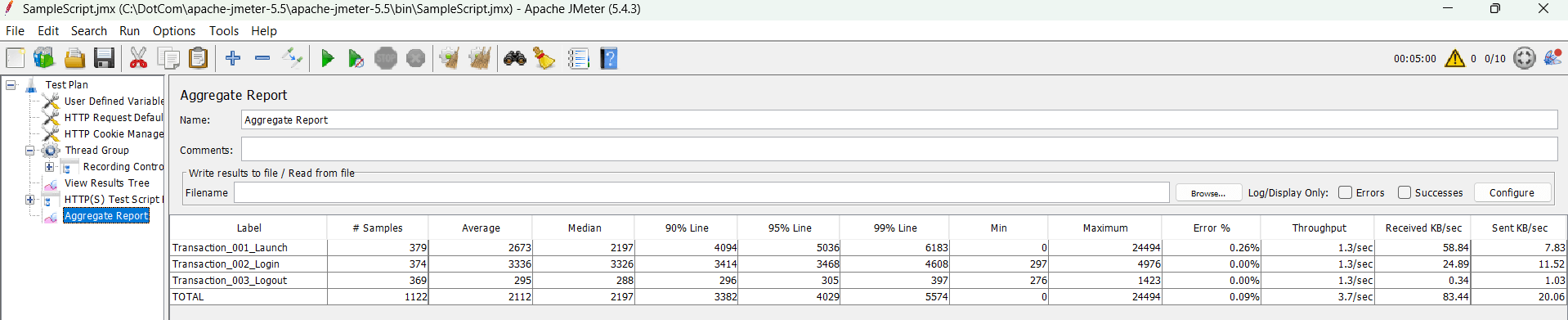

- Berichterstattungsfunktionen: Statische vs. dynamische Einblicke JMeter:

Bietet Kernleistungsstatistiken über Listener wie Aggregate Report und Summary Report: Die integrierten Listener von JMeter liefern Metriken wie durchschnittliche Antwortzeit, Durchsatz und Fehlerraten. Diese Ausgaben sind jedoch in der Granularität begrenzt und bieten keine Visualisierung komplexer Nutzerreisen.

Erfordert Benutzerskripte oder Plugins für historische Vergleiche: Um Trends über die Zeit zu analysieren, müssen Tester manuell Integrationen mit Datenbanken wie InfluxDB und Visualisierungstools wie Grafana konfigurieren, was die Komplexität erhöht.

Generiert lokale HTML- oder CSV-Dateien, die nicht cloudbasiert geteilt werden: Berichte werden lokal gespeichert, was manuelles Teilen und Koordination erfordert und häufig zu Versionsproblemen und Zugänglichkeitsproblemen führt.

Keine integrierte Drill-Down-Funktion zu einzelnen Nutzer-Sitzungen: Tester können Probleme nicht auf Sitzungsebene verfolgen; sie müssen manuell Zeitstempel in Protokollen abgleichen.

GUI-Modus:

Non-GUI-Modus:

LoadView:

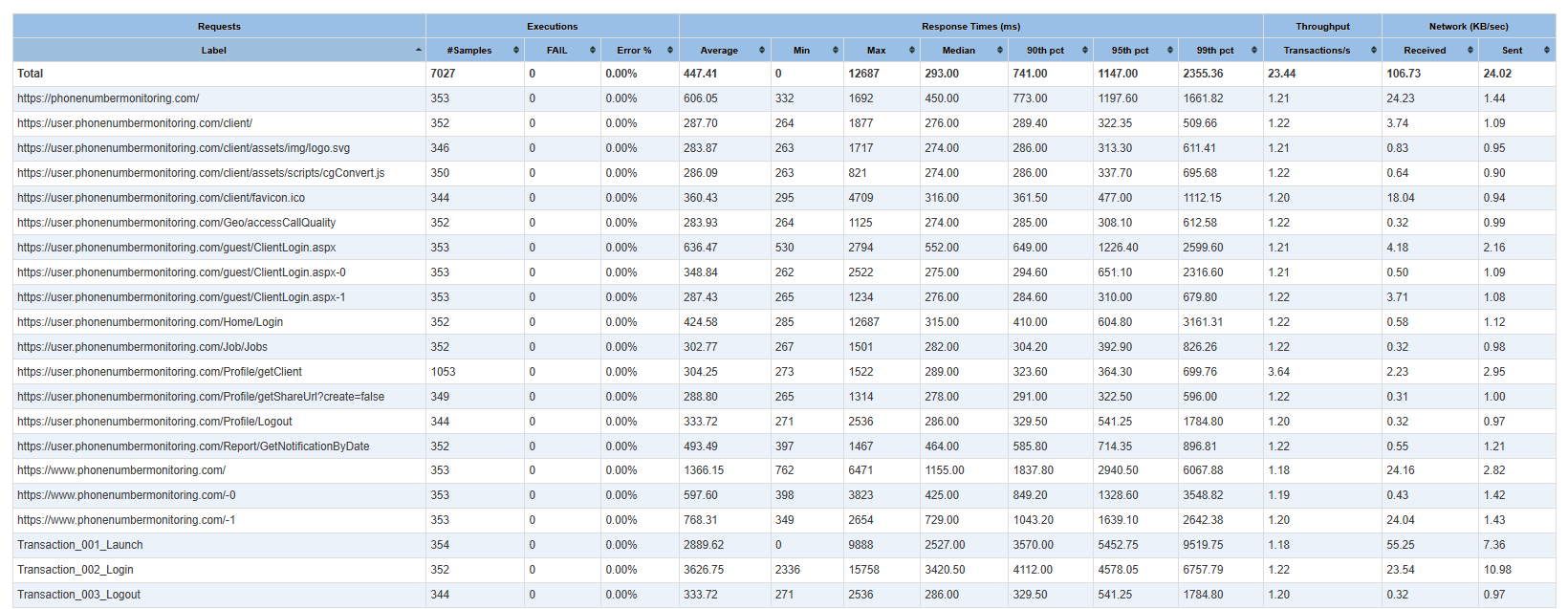

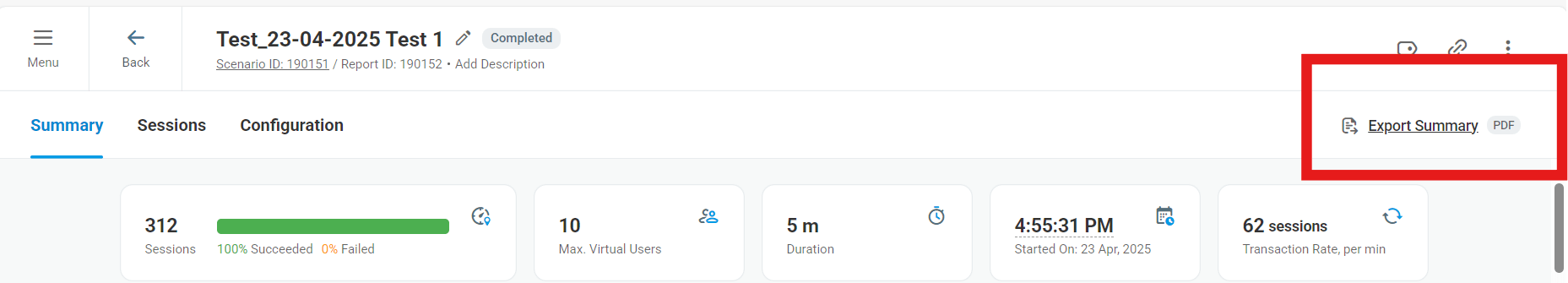

Reichhaltige, cloudgehostete Berichte, die in Echtzeit zugänglich sind: Live-Leistungsmetriken werden kontinuierlich während des Tests angezeigt.

Kontinuierliche Echtzeit-Aktualisierung von Performance-KPIs: Metriken wie durchschnittliche reAntwortzeit, 90. Perzentil, Minimum, Maximum und Ausfallsrate werden in Echtzeit aktualisiert.

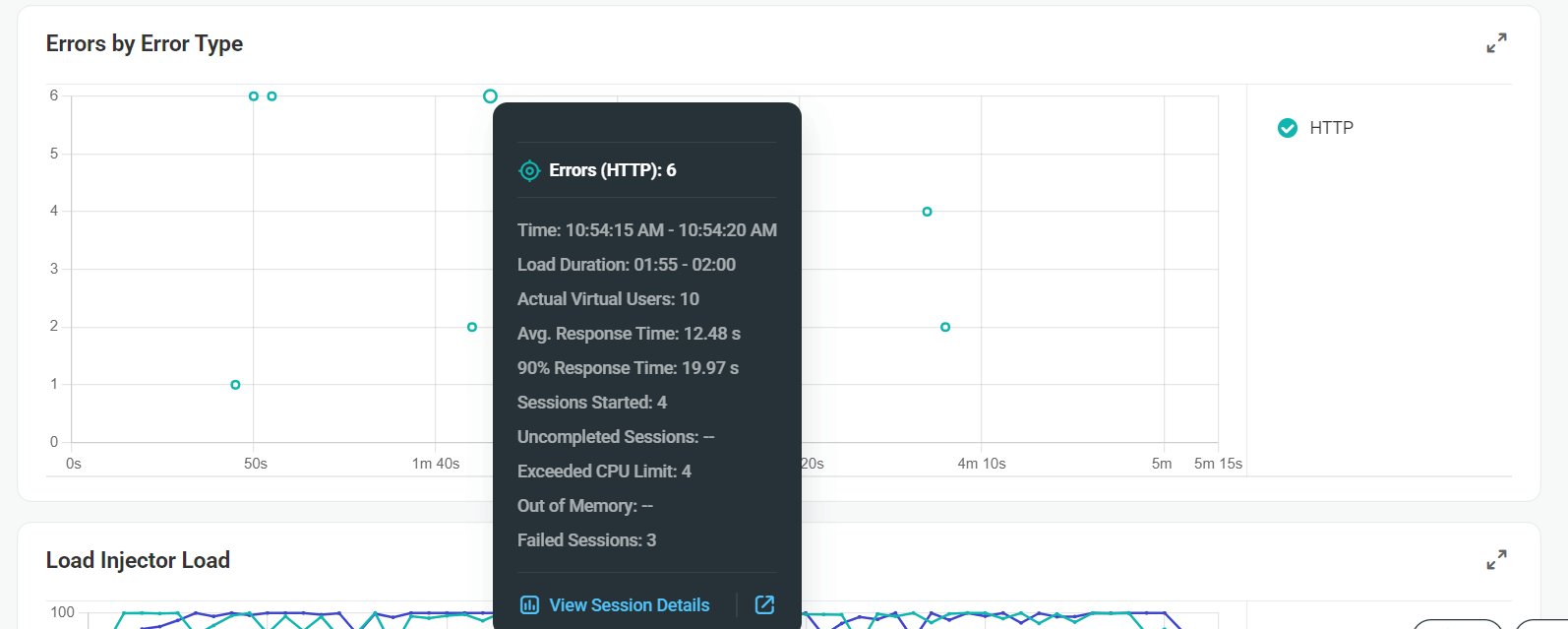

Fehlerklassifizierung für schnellere Ursachenanalyse: Fehler werden in Validierungs-, Client-, Server- und Drittanbieter-Kategorien gruppiert.

Cloud-basierte PDF- und teilbare Dashboard-Links: Einfaches Verteilen von Live-Dashboards oder Exportieren von Zusammenfassungen zum Teilen mit Teams.

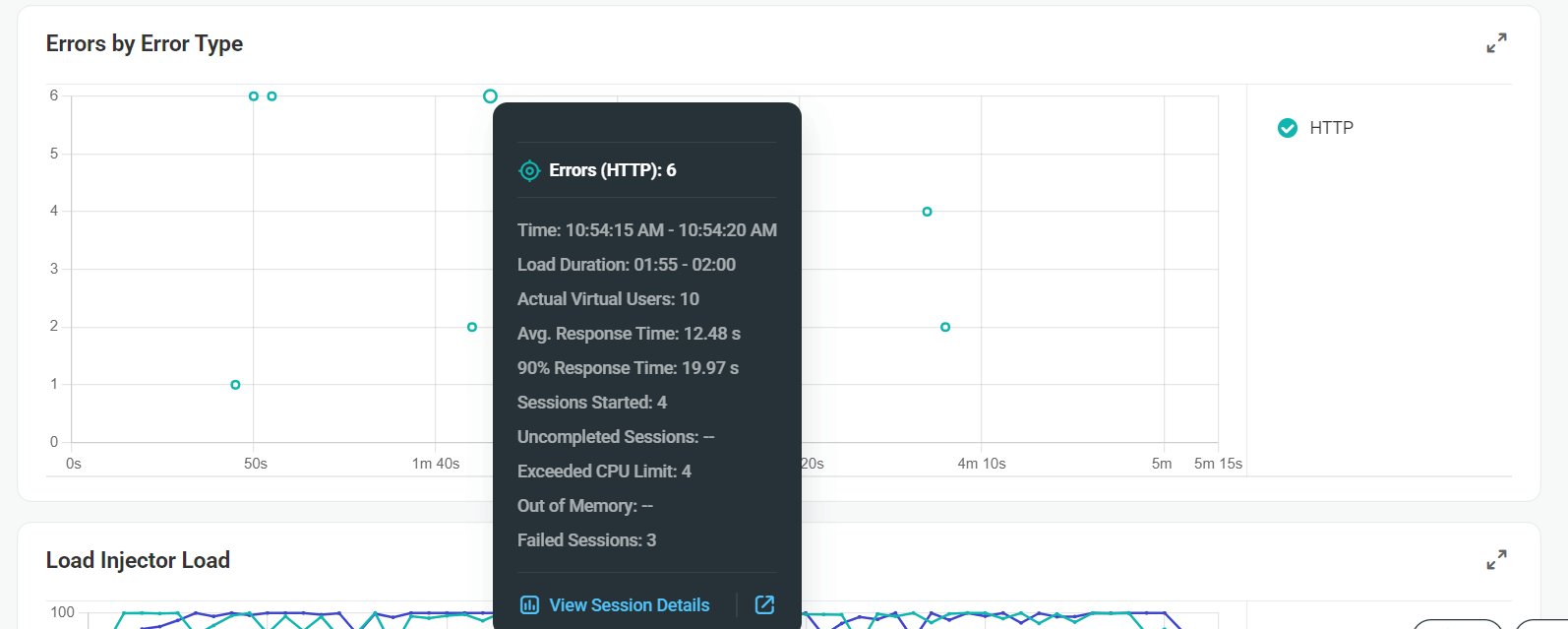

Interaktive Diagramme für Antwortzeiten, Fehlerverteilung und Aktivität virtueller Benutzer: Ermöglichen schnelle Identifizierung von Spitzen, Trends oder Ausfällen. Eine umfassende Zusammenfassungsansicht zur Überwachung des Testfortschritts in Echtzeit.

Die obere Hälfte zeigt einen plötzlichen Anstieg der durchschnittlichen Antwortzeit, der mit einem Rückgang erfolgreicher Sitzungen und einem Anstieg fehlgeschlagener Sitzungen (unteres Diagramm) korreliert (siehe rote Pfeile). Dies ist ein ideales Beispiel für LoadView’s Fähigkeit, Leistungsverschlechterungen visuell mit dem Verhalten der Benutzersitzungen zu korrelieren.

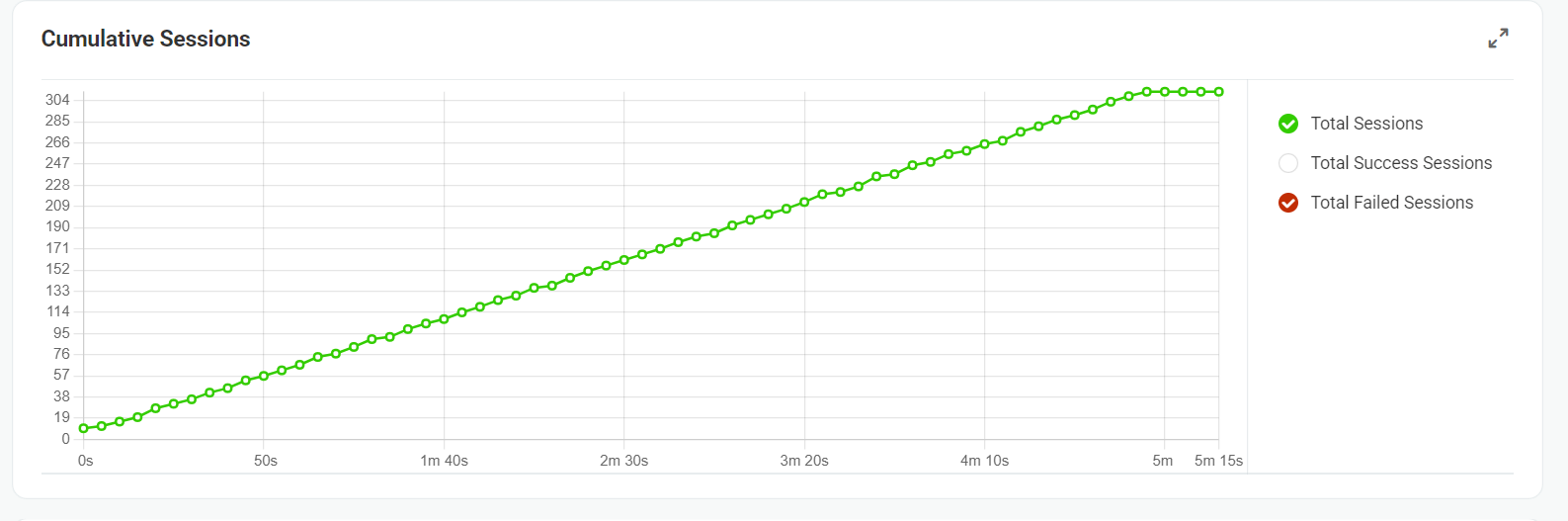

Kumulative Sitzungsverfolgung über Zeitfenster: Hilft bei der Beurteilung der Testkonsistenz und Stabilität während der Ausführungszeit.

Kurven zum Hochfahren virtueller Benutzer: Visuelle Darstellung der Lastzunahme in Übereinstimmung mit der Sitzungsleistung.

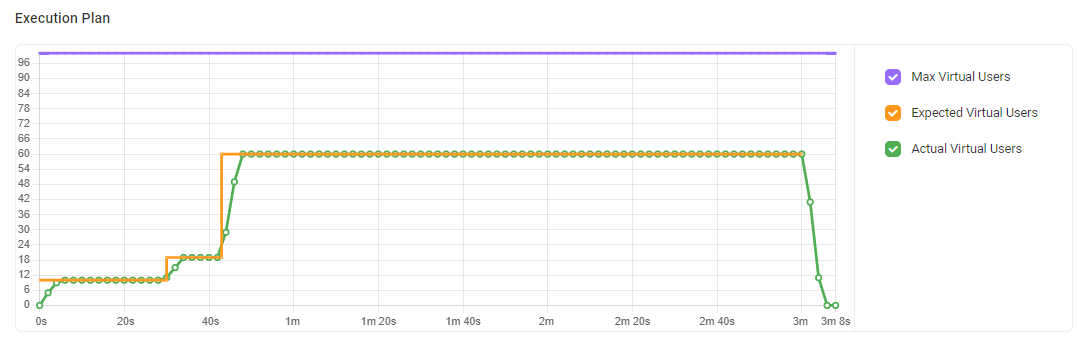

Dieses Diagramm zeigt, wie virtuelle Benutzer im Laufe der Zeit skaliert wurden. Die grüne Linie zeigt die tatsächliche Benutzeranzahl, die fast mit der orangen Linie (erwartete Benutzer) übereinstimmt und so ein stabiles Hoch- und Herunterfahren beweist. Die violette Linie markiert das maximale konfigurierte Limit für virtuelle Benutzer.

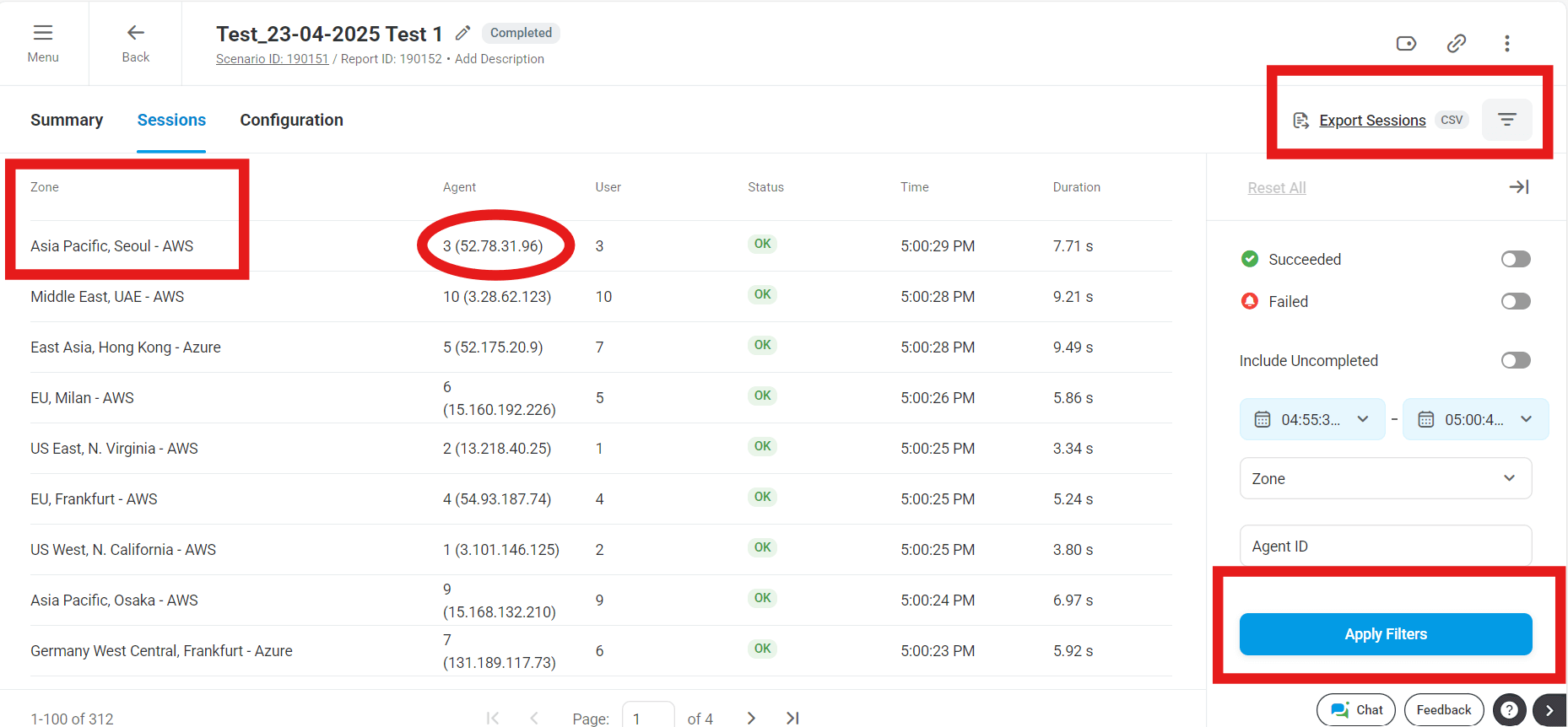

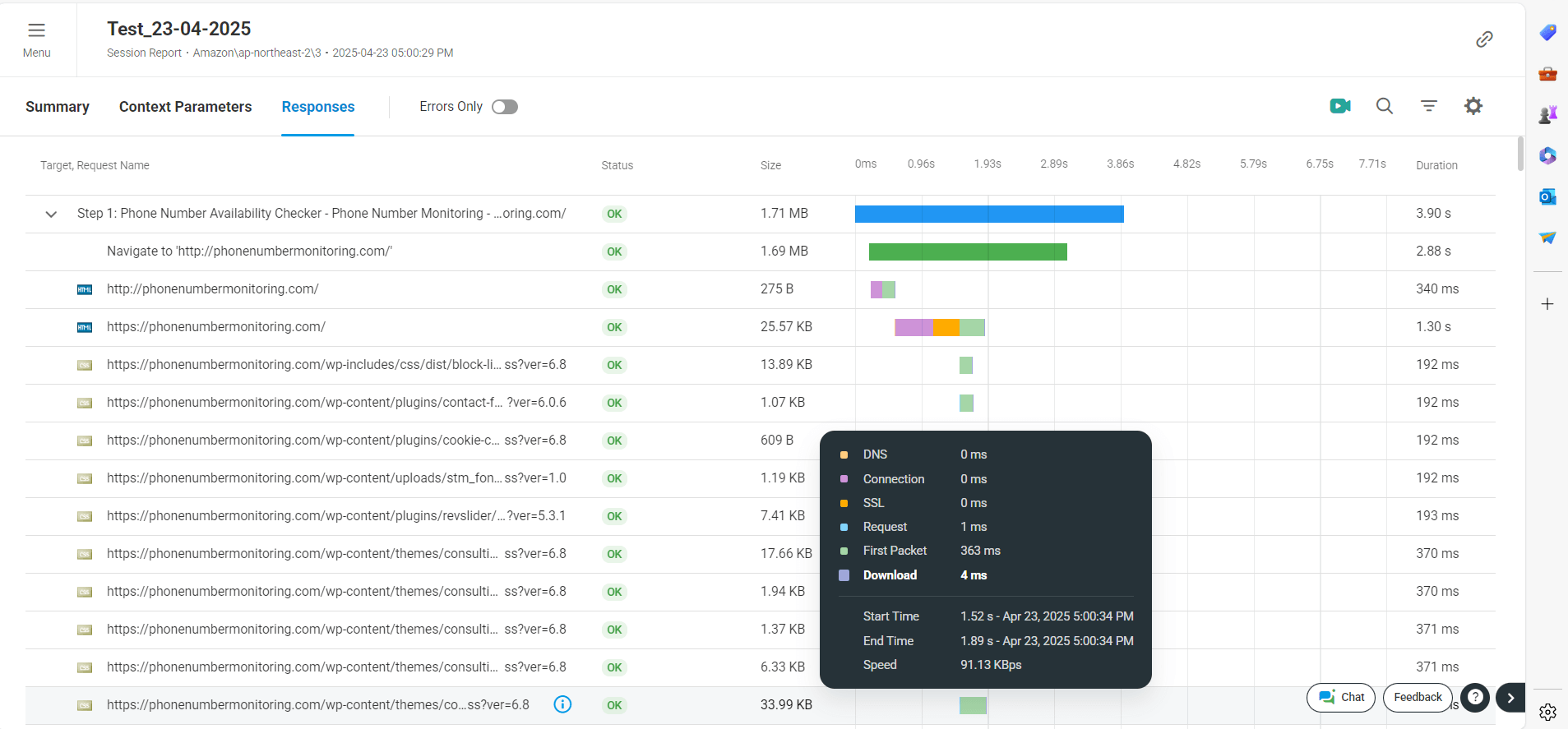

Serverstatistiken aus jeder Geo-Zone: Diagnose regionsspezifischer Probleme oder Latenz. Sitzungsbezogene Navigation, die einzelne Benutzerreisen zeigt: Verfolgen Sie den Pfad jedes virtuellen Benutzers und die zugehörigen Antwortdaten.

Detaillierte Betrachtung spezifischer Sitzungs-IDs: Prüfen Sie einzelne Testreisen und sehen Sie detaillierte Einblicke in die Netzwerkschicht pro Benutzer sowie eine schnelle Isolierung der Fehlerquelle für eine schnellere Lösung.

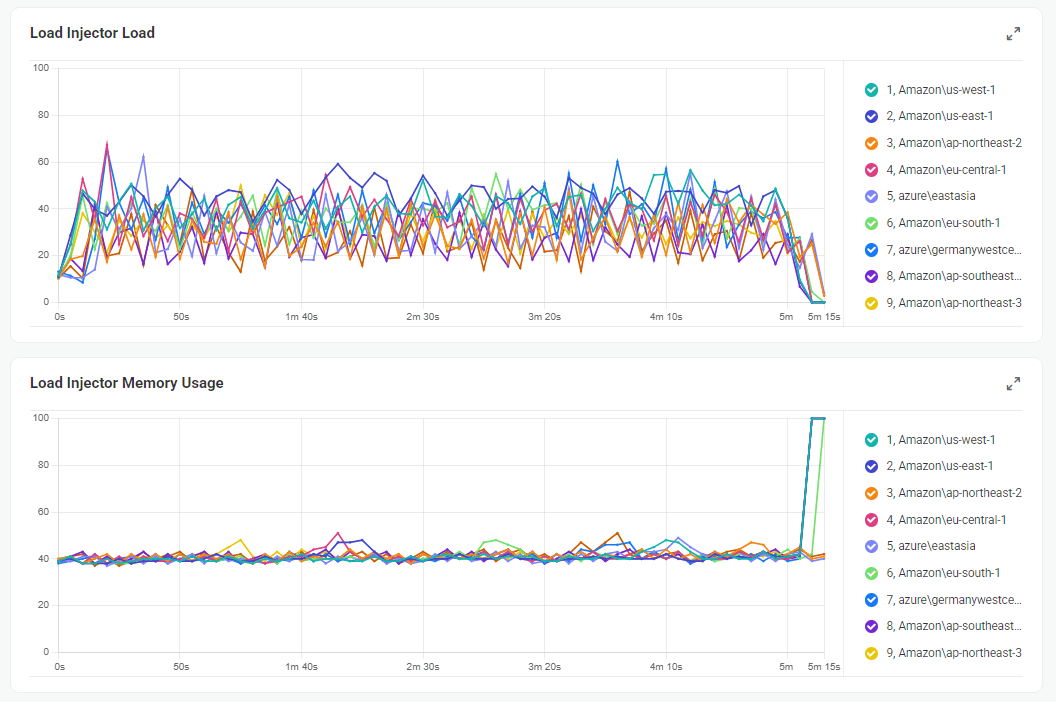

Dies zeigt, wie mehrere Cloud-Agenten (aus AWS-, Azure-Regionen) die Testlast geteilt haben. CPU und Speicher blieben größtenteils ausgeglichen, was die elastische Testverteilungsarchitektur von LoadView bestätigt.

- AJAX- und asynchrone Aufrufverarbeitung – JMeter-Einschränkungen:

Nur Protokollebene-Operation:

JMeter simuliert Anfragen auf der HTTP-ProtokollebeneEbene, was bedeutet, dass es clientseitiges JavaScript, das oft AJAX-Aufrufe auslöst, nicht ausführen oder interpretieren kann. Dies führt zu einer teilweisen Erfassung von Anfragen, insbesondere bei modernen Webanwendungen.

Verpasst Post-Load-Aktivitäten:

Asynchrone Operationen, die durch Benutzerinteraktionen wie Button-Klicks, Dropdowns oder dynamische Seitenaktualisierungen ausgelöst werden, werden nicht erkannt, es sei denn, die genaue Anfragereihenfolge wird manuell skriptiert, was komplex und unzuverlässig ist.

Schlechte SPA-Unterstützung (React, Angular, Vue):

In Single Page Applications (SPAs) wird Inhalt dynamisch geladen, ohne die Seite vollständig neu zu laden. Da JMeter das Verhalten auf Browser-Ebene nicht simuliert, kann es nach dem initialen Laden nicht mit DOM-Änderungen interagieren oder diese verfolgen. Eine genaue Testung dieser Abläufe erfordert fragile Workarounds.

Manueller Aufwand für AJAX-Simulation:

Ingenieure müssen die Browser-Dev-Tools manuell überprüfen, um asynchrone Endpunkte zu identifizieren, und dann das Verhalten mithilfe von Timern, Denkpausen oder benutzerdefinierter Logik in JMeter nachbilden. Dies erhöht den Wartungsaufwand der Tests und birgt das Risiko, kritische Benutzerpfade zu übersehen.

LoadView Vorteile:

Echte Browser-Ausführung erfasst AJAX nahtlos:

LoadView verwendet echte Browser (wie Chrome oder Edge), die JavaScript und AJAX-Aufrufe von Natur aus unterstützen und ausführen. Das bedeutet, dass jeder clientseitige Trigger, egal wie dynamisch oder verzögert, während der Testausführung genau erfasst wird.

Wahre End-to-End-Rendering-Simulation:

Da LoadView die Seite so sieht, wie ein tatsächlicher Benutzer, werden Ereignisse wie lazy-loaded Content, infinite scroll und Auto-Refresh-Widgets vollständig getestet – ohne benutzerdefinierten Code oder Verzögerungstimer.

Kein Skripten für asynchrone Logik erforderlich:

Tester können Skripte einfach durch Interaktion mit der Anwendung (Klicks, Hovers, Scrolls) aufzeichnen, und LoadView kartiert automatisch alle ausgelösten Netzwerkaktivitäten – einschließlich verketteter AJAX-Anfragen. Dies eliminiert Raten und reduziert die Skripterstellungszeit.

SPA-Kompatibilität direkt einsatzbereit:

LoadView kann Anwendungen, die mit modernen Frontend-Frameworks wie Angular, React und Vue erstellt wurden, ohne zusätzliche Konfiguration testen. Da Navigation und Datenupdates im Browser-View stattfinden, erfasst LoadView alles, genau wie eine echte Benutzererfahrung.

Genaue Antwortzeiten inklusive Async-Verzögerungen:

Da bei AJAX-lastigen Apps wichtige Inhalte oft erst nach dem Laden asynchroner Daten angezeigt werden, spiegeln LoadView-Metriken diese Verzögerungen genau wider – so dass Performance-SLAs auf tatsächlichen, vom Benutzer wahrgenommenen Ladezeiten basieren und nicht auf rohen Serverantwortzeiten.

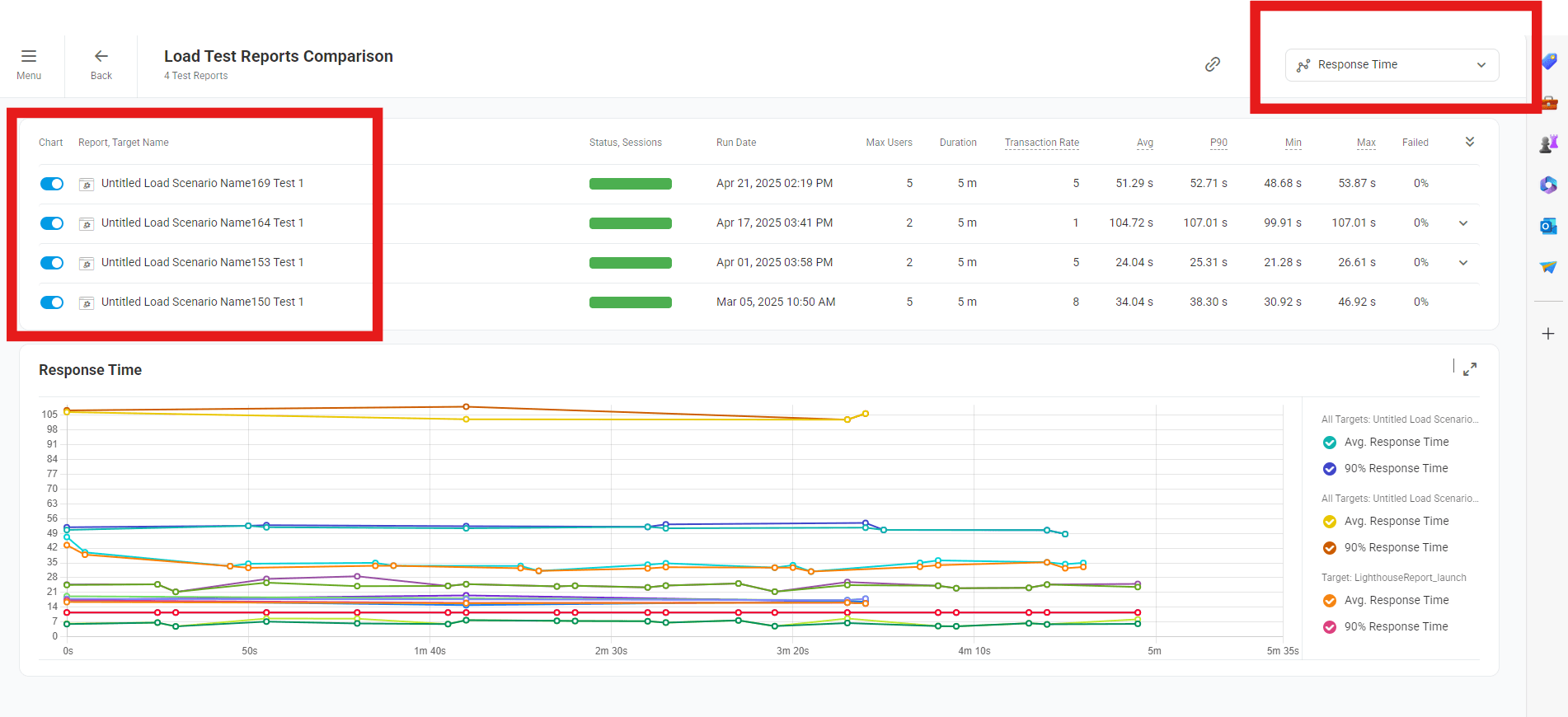

- Historischer Testlaufvergleich in LoadView – Ergebnisse über mehrere Testdurchläufe vergleichen

Während Echtzeit- und statische Berichte wertvoll sind, bietet LoadView außerdem standardmäßig die Nachverfolgung historischer Trends. Jeder Testlaufwird automatisch archiviert und kann mit vorherigen Ausführungen verglichen werden.

Vorher/Nachher Performance-Ansicht

Dies ermöglicht Teams, Änderungen am Anwendungscode, der Infrastruktur oder Drittanbieterdiensten zu bewerten, indem sie frühere Performance-Benchmarks direkt mit den neuesten Ergebnissen vergleichen – ohne komplexe Integration oder Konfiguration.

Keine Einrichtung erforderlich

Im Gegensatz zu JMeter, das für die historische Visualisierung die Integration mit InfluxDB und Grafana erfordert, macht LoadView den Trendvergleich mühelos mit einer einfachen Weboberfläche. Es sind keine externen Tools erforderlich.

Beispiel: Ein Entwicklungsteam kann einen Test von vor zwei Wochen (vor einer Datenbank-Optimierung) mit der neuesten Ausführung vergleichen und sofort Verbesserungen bei der Antwortzeit und Fehlerquote erkennen.

JMeter Einschränkungen:

Kein integriertes Live-Dashboard: JMeter bietet keine Echtzeit-Übersicht über laufende Tests. Sie müssen warten, bis der Test abgeschlossen ist, um Ergebnisse zu sehen.

Analyse erst nach dem Lauf: Fehler oder Probleme werden erst nach Abschluss des Tests erkannt, was die Ursachenforschung verzögert und Optimierungen während des Tests einschränkt.

Externe Tools für Live-Ansicht notwendig: Echtzeitmetriken erfordern die Konfiguration externer Datenbanken (z.B. InfluxDB) und Visualisierungsplattformen (z.B. Grafana), was Komplexität und betrieblichen Aufwand erhöht.

Manuelle Log-Korrelation: Die Fehleranalyse erfordert das manuelle Parsen von .jtl-Dateien und deren Zuordnung zu Logs oder Monitoring-Tools — ein mühsamer und zeitaufwändiger Prozess, insbesondere bei mehrstufigen Abläufen.

- IP-Level- und geografisch basierte Lastsimulation: Stärken von LoadView:

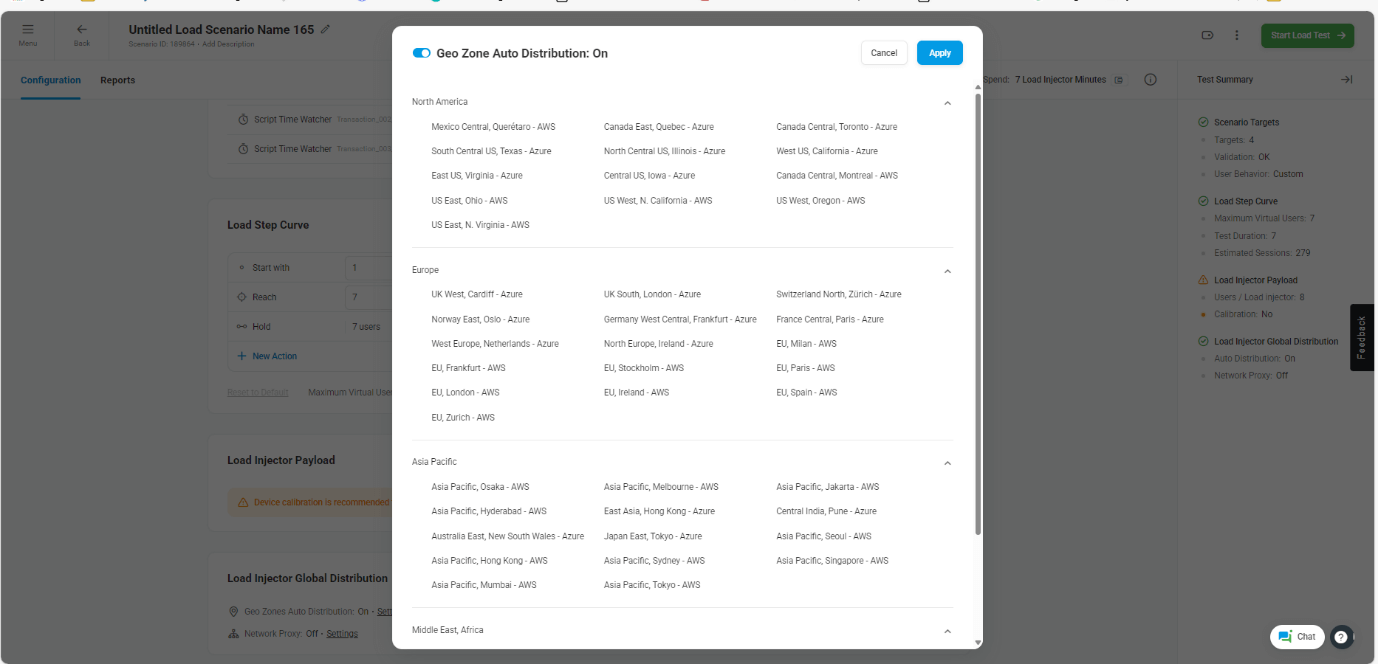

Wahre globale Verteilung: LoadView ermöglicht die Simulation von Traffic aus über 40 geografisch unterschiedlichen cloudbasierten Standorten weltweit. Dies stellt sicher, dass Anwendungen in verschiedenen Regionen eine konsistente Performance liefern. Zum Beispiel Wenn Sie wissen möchten, wie Ihre App aus Singapur, London und Sao Paulo performt, kann LoadView das mit einem Klick.

IP-Geolokalisierungsbasierte Einblicke: Jede Sitzung eines virtuellen Nutzers ist mit einer IP-Adresse und geografischen Position verknüpft. LoadView bricht Performance-Metriken wie Antwortzeit und Fehlerquote pro Standort auf, um regionale Verlangsamungen oder Ausfälle zu erkennen.

Zonenspezifische Serverdiagnose: LoadView verfolgt Performance-Trends für einzelne geografische Zonen, was die Isolierung von Infrastrukturproblemen wie regionalen Serverüberlastungen oder CDN-Edge-Ausfällen erleichtert.

Keine Einrichtung von entfernten Servern erforderlich: Im Gegensatz zu traditionellen verteilten Testansätzen benötigt LoadView keine Einrichtung oder Wartung von entfernten JMeter-Agenten oder Cloud-Servern. Alle Geo-Verteilungenwird nahtlos über die Cloud-Infrastruktur von LoadView abgewickelt.

JMeter-Einschränkungen:

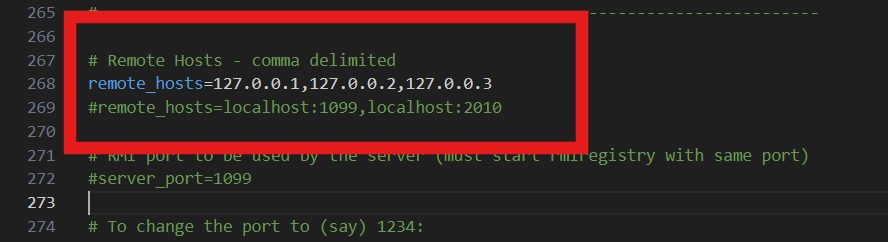

Manuelle Einrichtung der verteilten Tests: Um Benutzer aus verschiedenen Standorten zu simulieren, müssen Tester remote JMeter-Agenten manuell konfigurieren und die Master-Slave-Kommunikation einrichten, was anfällig und komplex sein kann.

Netzwerk-/Firewall-Probleme: Die verteilte Ausführung in JMeter stößt häufig auf Probleme mit Unternehmensfirewalls, NAT-Konfigurationen und erforderlichen offenen Ports, die den Testaufbau und die Zuverlässigkeit verlangsamen.

Keine regionale Fehlersichtbarkeit: JMeter liefert nativ keine leistungsbezogenen Daten segmentiert nach Region. Tester müssen eine eigene IP-Kennzeichnung implementieren oder die Ergebnisse nachbearbeiten, um geografische Muster zu erkennen.

- Real Browser Testing vs. Protokollsimulations-LoadView-Stärken:

Testet reales Browser-Verhalten: LoadView verwendet tatsächliche Browser wie Chrome und Edge, um das echte Endbenutzererlebnis nachzubilden. Dies beinhaltet JavaScript-Ausführung, CSS-Rendering, Pop-ups, Weiterleitungen und alle dynamischen Frontend-Verhalten.

Erfasst reale Frontend-Metriken: Wichtige Leistungskennzahlen wie Time to First Byte (TTFB), First Contentful Paint (FCP), Largest Contentful Paint (LCP), Cumulative Layout Shift (CLS) und Time to Interactive (TTI) werden direkt im Browser-Kontext gemessen. Diese sind entscheidend, um die echte vom Benutzer wahrgenommene Leistung zu verstehen.

Diagnostiziert Frontend-Engpässe: LoadView macht Screenshots, rendert Diagramme und zeigt Browserverläufe, sodass Sie genau sehen können, welche visuellen oder dynamischen Elemente langsam laden, was den Frontend-Teams ermöglicht, Layout und Interaktivität zu optimieren.

JMeter-Einschränkungen:

Nur Protokollebene-Simulation: JMeter arbeitet nur auf Netzwerkprotokollebene (HTTP/S) und rendert die Seite oder führt clientseitigen Code nicht aus.

Verpasst clientseitige Rendering-Fehler: Probleme, die nach dem initialen Seitenladen auftreten, wie JavaScript-Laufzeitfehler oder langsame UI-Komponenten, werden nicht erfasst.

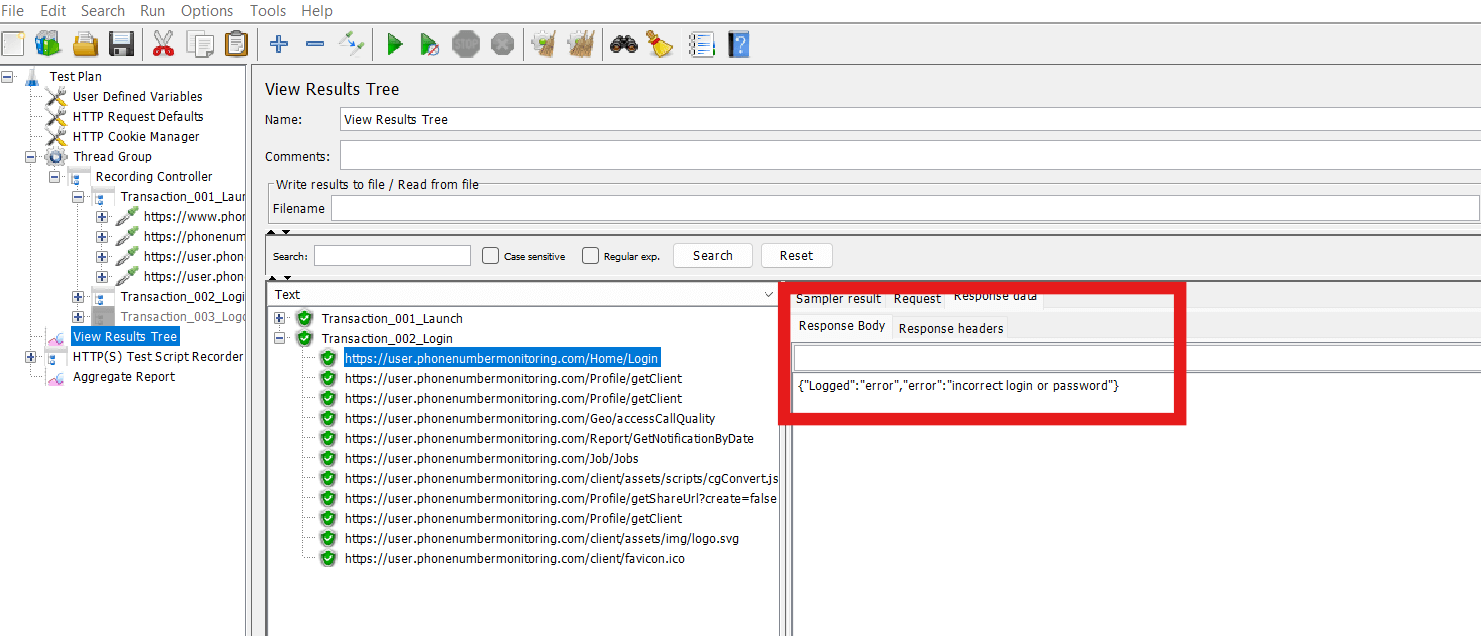

Es werden nur Fehlermeldungen erfasst, die im Antworttext erscheinen, während weiterhin 200 als Antwortcode zurückgegeben wird, was irreführend ist.

Kann reale UX-Leistung nicht messen: Ohne Browser-Rendering-Engine kann JMeter benutzerzentrierte Metriken wie Paint-Zeiten oder Layoutverschiebungen nicht bewerten, was seine Verwendung zur Validierung der Frontend-Leistung einschränkt.

- Fehlerkategorisierung und Debugging LoadView-Stärken:

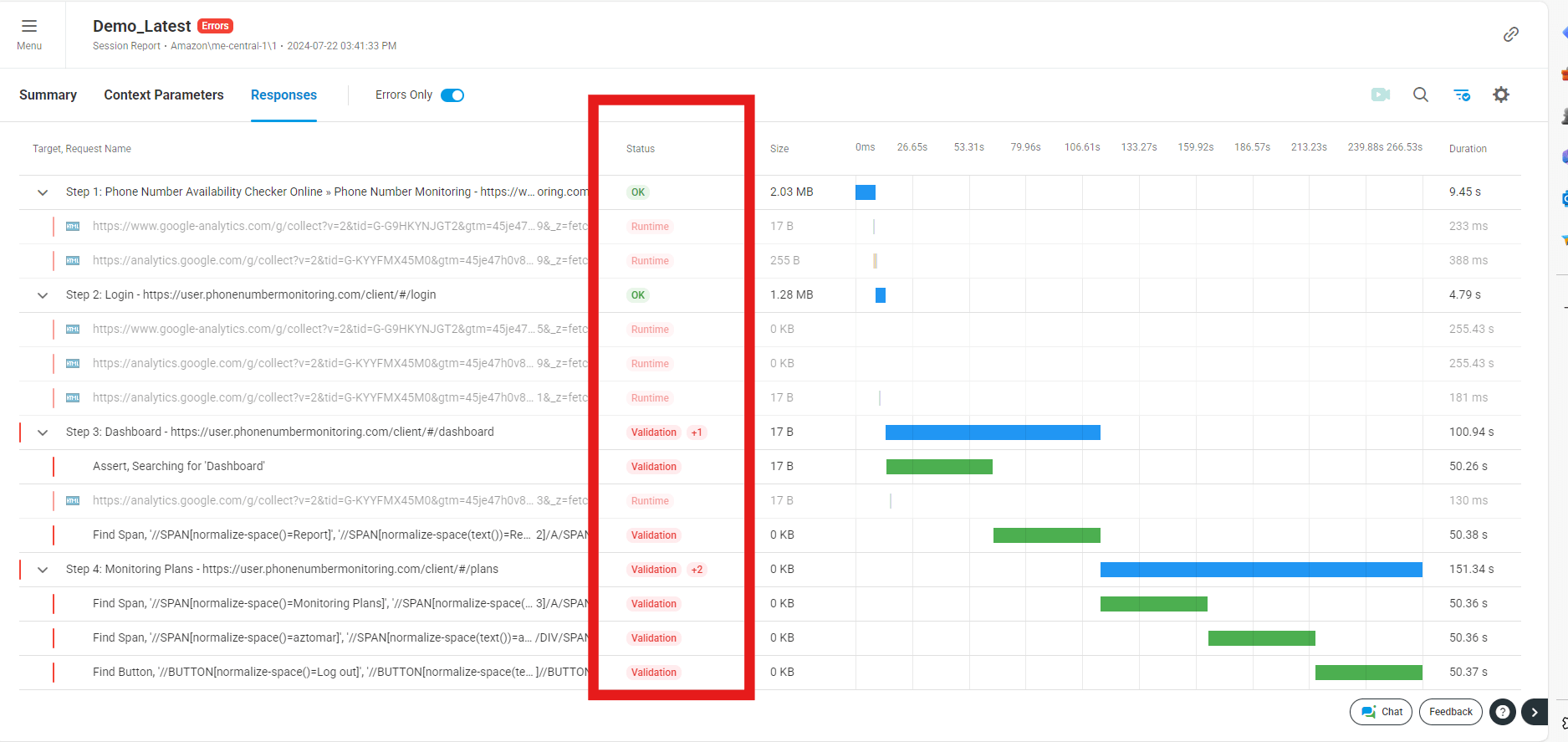

Automatische Fehlerklassifikation: LoadView intelligently gruppiert Fehler in vordefinierte Kategorien – wie Validierungsfehler (z. B. fehlender Text, Element nicht gefunden), Client-Seiten-Fehler (Timeouts, Skriptabstürze), Serverfehler (HTTP 500, 503) und Drittanbieter-Ausfälle (externe Dienst- oder API-Nichtverfügbarkeit). Dies hilft Teams sofort, die Art und Quelle des Fehlers zu verstehen.

Screenshots und Sitzungsaufnahmen: Für jeden signifikanten Fehler erfasst LoadView einen Screenshot oder eine Videoaufnahme der virtuellen Benutzererfahrung zum Zeitpunkt des Fehlers. Dies erleichtert die visuelle Überprüfung dessen, was schiefgelaufen ist, ohne das Problem manuell reproduzieren zu müssen.

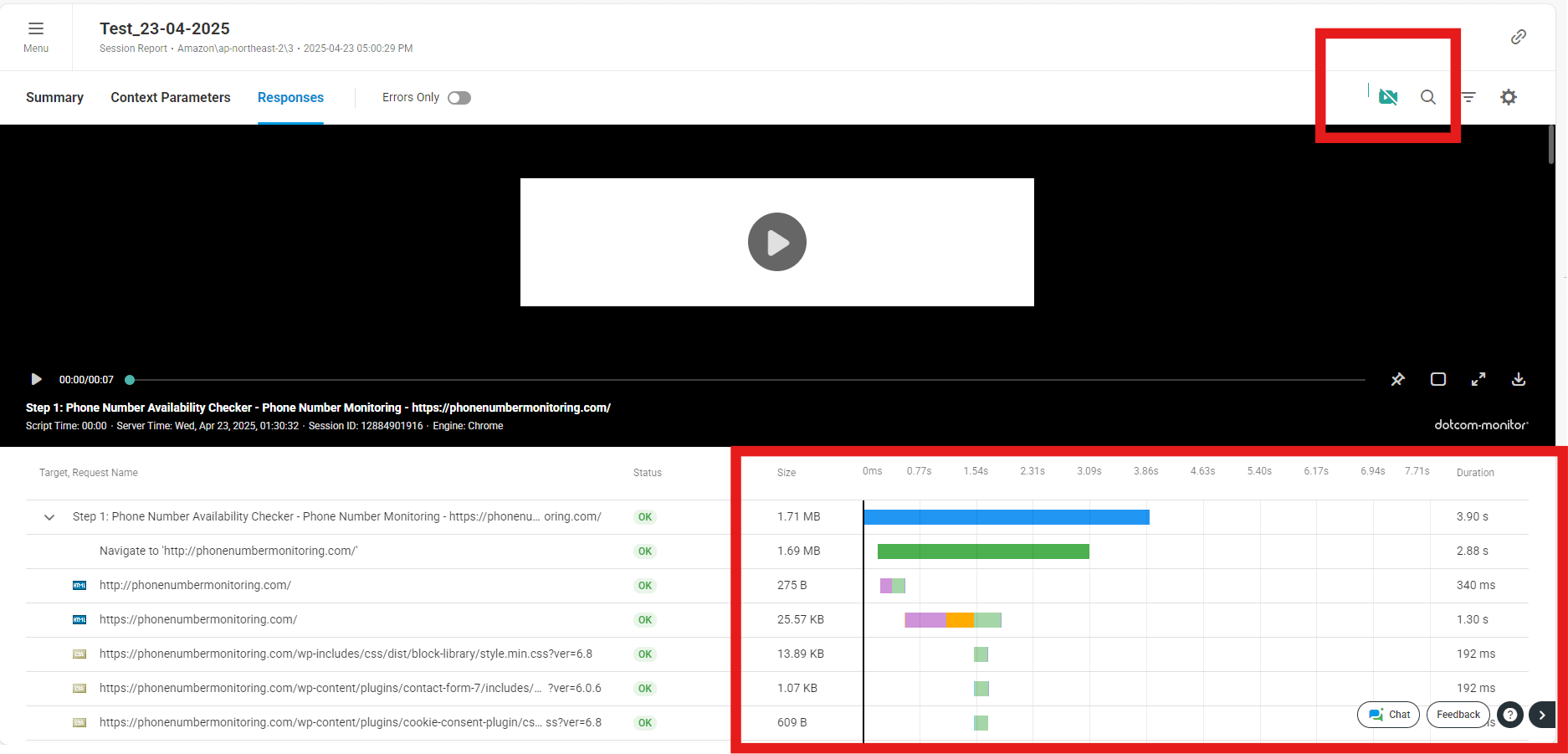

LoadView enthält eine integrierte Sitzungswiederholungsfunktion, mit der Sie sehen können, wie der Test tatsächlich im Browser ablief. Wie im Screenshot gezeigt, wird eine Echtzeit-Wiedergabe der getesteten Anwendung angezeigt, einschließlich der Benutzerinteraktion mit Elementen wie Schaltflächen, Menüs oder Login-Aufforderungen. Dies hilft Teams visuell zu bestätigen, ob eine Seite korrekt geladen wurde, welche Elemente verzögert waren und was der Benutzer sah, als ein Fehler auftrat.

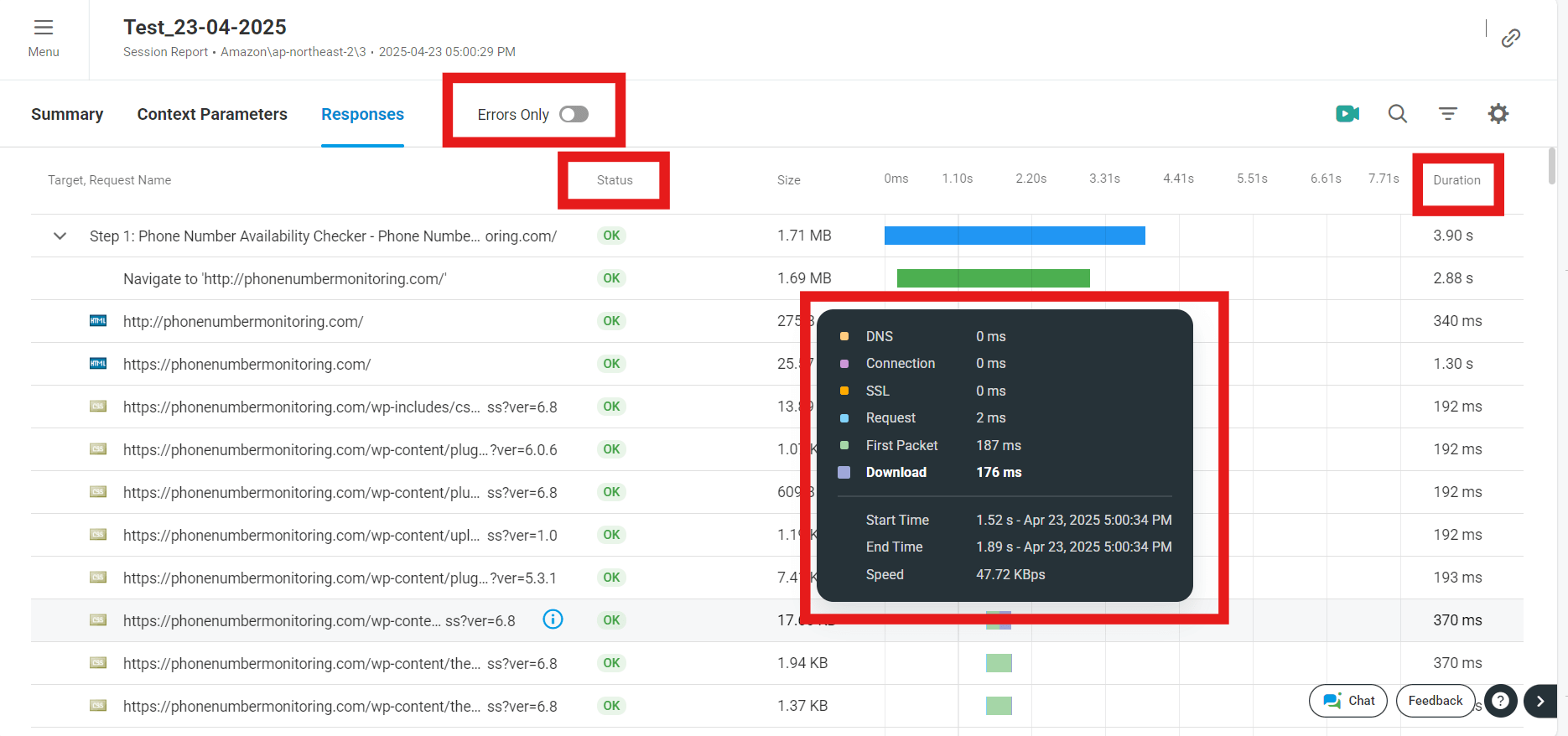

Waterfall-Timing + Video-Frame-Ausrichtung

Unter dem Wiedergabefenster zeigt LoadView ein Waterfall-Diagramm, das die Reihenfolge und Dauer der vom Browser durchgeführten Netzwerkaufrufe darstellt. Jedes Asset (HTML, JS, CSS, Bilder, APIs) wird mit Start- und Endzeit erfasst. Diese Kombination aus visueller Ausgabe und Backend-Metriken macht LoadView zu einem vollständigen Tool für Frontend-Leistungsanalysen.

Beispielanwendung: Sie können genau feststellen, ob eine Verzögerung durch ein langsam ladendes Stylesheet oder ein fehlendes API-Antwort verursacht wurde, während Sie beobachten, wie der Browser visuell wartet – etwas, das traditionelle Tools wie JMeter nicht bieten können.

Sitzungs-ID-Verknüpfung für einfache Reproduktion: Jeder Fehler ist mit einer einzigartigen Sitzungs-ID und einem Testschritt verknüpft, sodass Tester die Sitzung schnell abspielen oder die Ereignisfolge, die zum Fehler führte, nachverfolgen können, was die Debug-Zeit erheblich verkürzt.

JMeter-Einschränkungen:

Unverarbeitete Fehlerprotokolle ohne visuelle Kontextinformationen: JMeter stellt Fehlerinformationen als rohe HTTP-Statuscodes oder Ausnahme-Spuren innerhalb von .jtl-Dateien bereit, die nicht anzeigen, was zur Zeit des Fehlers in der Benutzeroberfläche geschah.

Manuelle Querverweise erforderlich: Das Debuggen eines JMeter-Fehlers umfasst typischerweise die Korrelation von Zeitstempeln und Anforderungs-IDs über mehrere Protokolldateien, Anwendungsprotokolle und Browser-Sitzungen hinweg – ein zeitaufwändiger und fehleranfälliger Prozess.

Keine Sitzungswiedergabe oder visuelles Feedback: JMeter arbeitet auf Protokollebene und umfasst keine browserbasierte Wiedergabe- oder Videoaufnahmefunktionen. Tester können nicht visuell bestätigen, was dargestellt oder was der Endbenutzer während eines Tests sah.Keine Wasserfalldiagramme oder browsergerenderte Asset-Zeiten: JMeter verfügt nicht über integrierte Wasserfallvisualisierungen, die die Ladezeiten von Frontend-Ressourcen anzeigen. Dies macht die Identifizierung langsamer CSS-, JavaScript- oder Bildladezeiten komplexer und manueller.

Kein Browser-Kontext für das Debugging: Ohne Browser-Ausführung gibt es keine DOM-Inspektion oder Sichtbarkeit von Layoutverschiebungen, Rendering-Fehlern oder visuellen Fehlern – was die Nützlichkeit des Tools für Frontend-Performance- und UX-Tests einschränkt.

Beste Anwendungsfälle für JMeter (Protokollebene-Tests)

JMeter ist ein Open-Source-Tool, das HTTP-Ebenenlast simuliert (ohne einen Browser zu rendern), was es zu einer leistungsstarken Option für Backend- und kostengünstige, hochskalige Tests macht. Ideal, wenn keine Browser-Interaktion erforderlich ist.

| Anwendungsfall

1. API-Lasttests |

Warum JMeter gut funktioniert | Beispiel |

| Unterstützt REST-, SOAP- und GraphQL-APIs von Haus aus. Einfaches Hinzufügen von Headern, Parametern und Validierung von JSON/XML. | Lasttest eines Zahlungsgateway-APIs oder interner Microservices | |

| 2. Datenbank-Lasttests | Der JDBC-Sampler unterstützt direkte Interaktion mit Datenbanken; nützlich für Stresstests von Abfragen. | Lasttest einer Reporting-Engine, die MySQL oder PostgreSQL abfragt |

| 3. CI/CD-Integration | Leicht in Jenkins, GitHub Actions, GitLab usw. via Kommandozeile oder Plugins integrierbar. | Automatisches Ausführen eines JMeter-Tests nach jeder Bereitstellung |

| 4. Messaging-System-Tests | Unterstützt JMS, MQTT und benutzerdefinierte Plugins für Kafka und RabbitMQ. | Lasttest eines ereignisbasierten Systems mit JMS-Nachrichten |

| 5. Datei-Upload / Download-Tests | Testen von dateibasierten Diensten über HTTP/SFTP/FTP. | Simulation mehrerer Benutzer, die Dokumente hochladen |

| 6. Hochvolumen-, kostengünstige Lasttests | Leichtgewichtige Ausführung; in der Lage, 10.000+ virtuelle Benutzer von einer einzigen Maschine aus zu simulieren (sofern kein Rendering erforderlich ist). | Performance-Test eines internen CMS |

| 7. Benutzerdefinierte Logik mit Groovy/JS/Beanshell | Ermöglicht einfaches Skripten von benutzerdefinierten Abläufen, dynamischen Daten oder Sitzungsverhalten. | Simulation einer Kreditgenehmigungslogik mit mehreren Verzweigungen |

Wer sollte JMeter verwenden?

DevOps-Ingenieure, Backend-Entwickler und Tester, die sich auf APIs, Datenbank-Performance oder Integrationsszenarien ohne Bedarf an Browser-Rendering konzentrieren.

Beste Anwendungsfälle für LoadView (Echte browserbasierte Tests)

LoadView verwendet echte Browser (Chrome, Edge), um das tatsächliche Benutzerverhalten zu simulieren,ideal für moderne Webanwendungen und Teams, die Benutzererfahrung und visuelle Validierung priorisieren.

| Anwendungsfall | Warum LoadView die beste Wahl ist | Beispiel |

| 1. Browser-basierte Lasttests | Führt echte Benutzerreisen mit JavaScript, Cookies, DOM-Updates und Seitenrendering aus. | Lasttest eines Reisebuchungsportals |

| 2. SPA-Tests (React, Angular, Vue) | Handhabt automatisch asynchrones Verhalten (AJAX, fetch, Websockets) von JS-Frameworks. | Test eines Kundendashboards in Angular |

| 3. E-Commerce UX-Validierung | Misst Ladezeit, FCP, LCP, TTI — tatsächliche Metriken, die die Konversionsrate beeinflussen. | Lasttest eines Warenkorb-zu-Checkout-Prozesses vor Black Friday |

| 4. Geo-verteilte Tests | Unterstützt Tests von über 40 Standorten, um Benutzerzugriffe aus verschiedenen Regionen zu simulieren. | Test der Seitengeschwindigkeit aus den USA, Europa und Indien |

| 5. Lasttests ohne Skripting | Zeichnet Abläufe wie ein Benutzer auf (Klicks, Scrollen, Filter, Navigation). Kein technisches Skripting erforderlich. | Produktmanager oder QA-Teams testen Benutzerflüsse ohne Dev-Eingriff |

| 6. Stakeholder-fertige Berichte | Berichte enthalten Sitzungswiederholungen, visuelle Charts, PDF-Exporte — geeignet für Geschäfts- und Nicht-Techniknutzer. | Teilen der Ergebnisse mit VPs, Produktverantwortlichen oder Kunden |

| 7. Validierung dynamischer Inhalte | Erfasst jede UI-Änderung, verzögertes Rendering, Modalfenster oder AJAX-basierte Filter. | Testen einer Hotelübersichtsseite mit Filtern und Lazy-Loading |

Wer sollte LoadView verwenden?

QA-Teams, Produktmanager, Frontend-Entwickler, UX-Designer und Business-Analysten, die moderne Web-Performance validieren, insbesondere in SPAs oder bei Validierung von realen Benutzerflüssen.

- LoadView vs. JMeter: Vergleich der Reporting-Funktionen

| Feature Berichtszugriff & Timing | 🔵 LoadView | 🟠 JMeter |

| Echtzeit, cloud-gehostete Berichte, die auch während der Testdurchführung zugänglich sind. | Nur nach dem Test; keine eingebaute Echtzeit-Übersicht. | |

| Datengranularität | Hohe Detailtiefe mit Drill-Down zu einzelnen Sitzungen und Netzwerkanfragen. | Übersichtliche Metriken (durchschnittliche Antwort, Durchsatz); begrenzte Sitzungsdetails. |

| Visualisierung | Reiche, interaktive Diagramme (Antwortzeiten, Fehlertypen, Benutzeraktivität). | Einfache Diagramme über Listener (z. B. Zusammenfassungsbericht); eingeschränkte native Visualisierung. |

| Live-Dashboard | Eingebautes Dashboard mit kontinuierlichen Live-Aktualisierungen während der Testläufe. | Nicht enthalten; erfordert externe Integration (z. B. Grafana). |

| Historischer Vergleich | Automatisches Trend-Tracking und visueller Vergleich über mehrere Testläufe. | Erfordert manuelle Einrichtung mit externen Tools wie InfluxDB + Grafana. |

| Bericht teilen | Einfache Freigabe über in der Cloud gehostete PDFs und öffentliche/private Dashboard-Links. | Erzeugt lokale HTML/CSV-Dateien; Teilen muss manuell erfolgen. |

| Fehleranalyse | Automatische Klassifizierung von Fehlern: Client, Server, Validierung, Drittanbieter usw. | Rohe Fehlerprotokolle (HTTP-Codes); manuelle Klassifizierung und Analyse erforderlich. |

| Debugging-Kontext | Screenshots, Sitzungs-Videos, Sitzungs-Wiedergaben und Wasserfalldiagramme. | Keine visuelle Unterstützung; beruht auf Protokollkorrelation und manueller Untersuchung. |

| Sitzungsverfolgung | Vollständige Sitzungsaufgliederung mit schrittweiser Navigation. | Keine native Sitzungsverfolgung; erfordert das Parsen roher Protokolle. |

| Geografische Einblicke | Leistungsaufgliederung nach Regionen; nützlich für globale Lasttests. | Keine eingebaute Unterstützung; benutzerdefinierte Skripte oder Tools müssen implementiert werden. |

| Frontend-Metriken (UX) | Erfasst echte Browser-Metriken: FCP, LCP, TTI und Time to Interactive. | Kann UX-/Browsermetriken aufgrund des Protokollebene-Betriebs nicht erfassen. |

| Berichtsformate | PDF, Excel und interaktive Cloud-Links | HTML und CSV; eingeschränkte Anpassungsmöglichkeiten. |

| Einrichtungsaufwand | Minimaler Aufwand; alle Berichtsfeatures sind in der Cloud sofort verfügbar. | Erfordert Konfiguration von Listenern und externen Tools für erweiterte Berichte. |

Zusammenfassung aus dem Artikel

LoadView bietet eine fortschrittliche Berichtserfahrung, die auf moderne, dynamische Webanwendungen zugeschnitten ist. Es ermöglicht:

Echtzeitzugriff auf Live-Daten undDiagramme während der Testausführung.

Tiefgehende Einblicke in individuelle Benutzerreisen mit visuellen Nachweisen wie Sitzungswiedergaben. Mühelose Berichtsteilung und Zusammenarbeit.

Einfache Fehlerbehebung mit integrierten Browser-Metriken, geografischen Erkenntnissen und detaillierter Fehlerklassifizierung.

JMeter, obwohl leistungsstark für Protokollebene-API- und Backend-Leistungstests, bietet:

Basisberichte nach der Ausführung mit begrenzter Visualisierung.

Keine native Unterstützung für browserbasierte Metriken oder Echtzeit-Dashboards.

Erweiterte Berichtsfunktionen nur durch komplexe Setups mit InfluxDB, Grafana oder benutzerdefiniertem Skripting erreichbar.