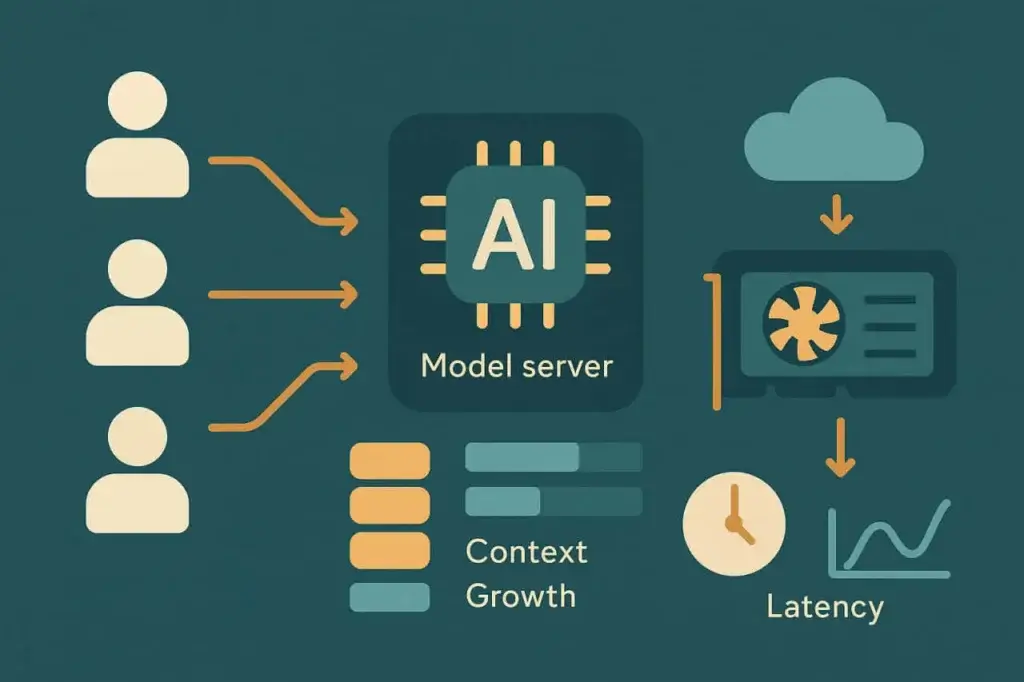

Agentes de IA estão mudando o que significa “carga”. O teste de carga tradicional foi criado para páginas web, APIs e transações—sistemas que se comportam de forma previsível sob estresse. Cargas de trabalho impulsionadas por IA não. Suas entradas variam em comprimento, complexidade e contexto. Seu processamento é probabilístico, não determinístico. Seu desempenho depende tanto do agendamento da GPU e geração de tokens quanto da latência de rede ou do throughput do backend.

Essa mudança quebra as suposições sobre as quais a maioria dos testes de carga foi construída. Você não pode tratar um agente de IA como outro endpoint de API. Cada requisição é uma conversa, não um clique. Cada resposta depende da anterior. E cada sessão fica mais pesada à medida que o contexto se acumula.

Para manter esses sistemas confiáveis, os engenheiros de desempenho precisam de um novo manual—um que entenda como simular raciocínio concorrente, não apenas tráfego concorrente. Este artigo descreve estratégias modernas, impulsionadas por IA, para testar agentes em larga escala e mantê-los performáticos conforme a complexidade aumenta.

Desafios de Desempenho no Teste de Carga de Agentes de IA

Cargas de trabalho de IA não se comportam como tráfego web ou móvel. Cada “usuário” em um sistema impulsionado por IA pode representar uma série de operações encadeadas: expansão de prompt, recuperação de contexto relevante, inferência do modelo e pós-processamento ou execução de ferramenta. A carga não é fixa—ela evolui a cada turno na interação.

À medida que essas camadas se acumulam, a degradação de desempenho torna-se não linear. Um aumento de 2x nos usuários concorrentes não significa 2x na latência—pode significar 5x, dependendo da carga do modelo, memória e alocação de GPU. Métricas tradicionais de teste de carga, como requisições por segundo ou tempo médio de resposta, não captam a dinâmica subjacente. O que importa aqui é a elasticidade da latência—como o desempenho se dobra conforme as sessões se multiplicam.

Existem vários fatores recorrentes de estresse nos sistemas de agentes de IA:

Acúmulo de Contexto

Cada consulta do usuário carrega contexto histórico—às vezes milhares de tokens de conversa anterior ou dados de documentos. À medida que o comprimento do contexto cresce, o tamanho do prompt infla e o tempo de inferência do modelo aumenta. Em escala, isso cria picos imprevisíveis de latência e pressão de enfileiramento nas GPUs.

Escala Limitada pelo Computo

Diferente dos servidores web, a inferência de modelos grandes nem sempre pode escalar horizontalmente. Pesos de modelos e janelas de contexto consomem memória fixa de GPU; exceder a capacidade significa enfileirar requisições ou recorrer a modelos menores. Isso torna os limites de concorrência muito mais rígidos do que em sistemas baseados em CPU.

Latência de Recuperação

Muitos agentes puxam dados externos—via bancos de dados vetoriais, APIs ou armazenamento de documentos—antes de gerar uma resposta. Essas dependências adicionam latência de I/O e se tornam o primeiro gargalo em tráfego de pico.

Persistência de Sessão

Testes de carga tradicionais repetem requisições sem estado. Sessões de IA são com estado. Cada uma carrega memória, embeddings e contexto em cache. Quanto mais longa a conversa, maior o footprint da sessão.

Esses fatores se combinam formando um novo tipo de perfil de estresse. O sistema pode parecer saudável com 100 usuários concorrentes, mas ceder aos 120, não por exaustão de banda, mas por saturação da fila da GPU ou estouro do cache de contexto. Testar carga em sistemas de IA significa revelar onde esses pontos de inflexão não lineares começam.

Entendendo o Comportamento da Carga de Trabalho de Agentes de IA

Antes de desenhar testes, é útil modelar como um agente de IA realmente se comporta por trás dos panos. A maioria dos agentes em produção segue um pipeline semelhante:

- Ingestão de entrada. O usuário envia uma consulta ou mensagem.

- Montagem do contexto. O agente coleta dados relevantes de turnos anteriores ou de uma fonte externa.

- Inferência do modelo. O prompt montado é enviado a um endpoint de modelo local ou remoto.

- Pós-processamento. A saída pode ser analisada, validada ou enriquecida antes de retornar.

- Entrega da resposta. O agente atualiza o estado da interface ou envia uma resposta API.

Cada etapa adiciona variabilidade. O tempo de inferência escala aproximadamente com o número de tokens de entrada e saída. A latência de recuperação depende da proximidade do banco de dados e das taxas de cache hit. O custo da montagem do contexto aumenta a cada turno na conversa.

Para entender o comportamento do desempenho, é preciso observar como essas dimensões interagem. Por exemplo, dobrar o comprimento do prompt pode aumentar a latência média de inferência em 60%, mas a concorrência além de um certo limite pode elevá-la em 300%. Essas curvas importam mais do que qualquer métrica isolada.

Testar carga em sistemas de IA é em parte estatístico. Você não está apenas medindo throughput—está construindo distribuições de resposta. As caudas dessas distribuições—latências nos percentis 95 e 99—indicam quando o modelo ou infraestrutura começam a saturar. É aí que a maioria das lentidões visíveis ao usuário se origina.

Na prática, mapear o comportamento da carga significa executar testes progressivos de rampa. Comece com algumas sessões concorrentes, capture a latência base e escale incrementalmente. Observe como o throughput de tokens, tempos de fila e utilização da GPU respondem. Cada agente tem sua própria assinatura de escala, e encontrá-la é o primeiro passo para operações confiáveis.

Métricas Principais para Medir em Testes de Carga de Agentes de IA

Métricas tradicionais—RPS, TTFB, taxa de erro—ainda se aplicam, mas não contam toda a história. O teste de carga para agentes de IA introduz novas métricas que refletem como a inteligência, não apenas a infraestrutura, escala.

Latência de inferência mede o tempo total desde o envio do prompt até a resposta completa do modelo. É o sinal de desempenho mais direto, mas deve ser monitorado junto com o tamanho da entrada e o tipo de modelo. Comparar médias brutas sem normalização pelo tamanho do contexto pode ser enganoso.

Escala do contexto quantifica como a latência cresce conforme a janela do prompt se expande. Engenheiros podem traçar o tempo de resposta contra a contagem de tokens para visualizar a curva de custo. Um sistema bem otimizado mostra escala linear ou sublinear, enquanto sistemas mal otimizados exibem picos exponenciais além de certos limites de contexto.

Throughput de tokens—tokens processados por segundo em sessões concorrentes—reflete desempenho e eficiência de custo. Como a maioria das APIs cobra por token, a queda no throughput se traduz diretamente em ineficiência econômica.

Latência de dependências captura atrasos de sistemas de suporte: índices de busca vetorial, bases de conhecimento ou APIs de plugins. Estes podem dominar o tempo total de resposta mesmo quando a inferência é rápida.

Estabilidade da concorrência mede como o sistema se comporta sob carga simultânea. A latência aumenta previsivelmente? As taxas de erro permanecem limitadas? Ou os tempos de resposta oscilam descontroladamente à medida que filas se formam?

Combinando essas métricas, as equipes podem construir um quadro holístico de desempenho. O objetivo não é apenas medir velocidade—é entender onde e por que a degradação começa.

Projetando Testes de Carga Eficazes para Sistemas de IA

Com as métricas definidas, a estratégia de teste passa a ser sobre fidelidade de simulação. Agentes de IA não servem requisições idênticas, então gravar uma única transação e repeti-la sob carga é inútil. Cada usuário sintético deve representar variação—diferentes prompts, comprimentos e comportamentos. O objetivo é realismo, não uniformidade.

1. Modele todo o pipeline de raciocínio, não apenas o endpoint

Usuários reais não acessam /generate isoladamente. Eles se autenticam, submetem contexto, invocam recuperação e então geram saída. Um teste de carga credível imita essa sequência. Pular uma camada e seus dados se tornam sem sentido.

2. Parametrize prompts para refletir diversidade real

Sistemas de IA desaceleram conforme o comprimento da entrada ou complexidade semântica aumenta. Use modelos variáveis de prompt que ajustem contagens de tokens, estruturas de frase ou profundidade do contexto embutido. Isso revela como a escala afeta a distribuição do tempo de resposta.

3. Escale a concorrência gradualmente

Backends de IA frequentemente enfileiram requisições na camada de inferência. Ao invés de pular instantaneamente para 1000 usuários, faça rampas graduais em estágios definidos—por exemplo, 10 → 50 → 100 → 200—mantendo cada etapa por alguns minutos. A curva resultante revela onde a saturação da GPU ou de threads começa.

4. Monitore custo junto com desempenho

Diferente dos servidores web, APIs de inferência cobram por token. Durante testes de carga, calcule o custo por requisição em cada nível de concorrência. O tuning de performance deve incluir eficiência econômica—modelos rápidos mas caros podem falhar financeiramente em escala mesmo que tecnicamente passem.

5. Inclua comportamento de tentativas e timeout

Endpoints de IA frequentemente limitam taxas ou degradam sob uso intenso. Simule lógica de retry do cliente para observar efeitos de carga composta. Um backoff exponencial ingênuo pode dobrar o tráfego efetivo quando falhas disparam.

Essas estratégias substituem o antigo modelo de “gravar e reproduzir” por uma mentalidade de simulação comportamental. Em vez de testar transações, você está testando cognição—como o sistema pensa e escala simultaneamente.

Teste de Carga Impulsionado por IA: Deixe os Modelos Ajudarem

Ironia, IA pode ajudar a resolver o problema que cria. Plataformas modernas de teste estão começando a integrar modelos de machine learning diretamente em seus ciclos de análise, produzindo o que frequentemente é chamado de teste de carga impulsionado por IA.

Aqui, a IA desempenha três papéis:

Geração de prompts

Ao invés de criar manualmente centenas de entradas de teste, um modelo generativo pode produzir variações de prompt que simulam a diversidade real do usuário. Pode ajustar tom, estrutura e contexto automaticamente, expondo o sistema a um leque mais amplo de padrões de estresse.

Detecção de anomalias

Modelos de IA podem detectar desvios estatísticos nos dados de desempenho mais rápido do que limites estáticos. Ao invés de alertar quando a latência ultrapassa um limite fixo, modelos de anomalia aprendem a variância normal e destacam outliers que indicam degradação genuína.

Análise preditiva de saturação

Ao analisar dados históricos de carga, a IA pode prever quando um sistema atingirá seu próximo limite de desempenho. Modelos de regressão ou preditores de séries temporais identificam padrões de escala não lineares antes que quebrem a produção.

O benefício não é uma automação mágica, mas aceleração. Engenheiros gastam menos tempo em manutenção repetitiva e mais em interpretar por que o desempenho muda. O teste de carga impulsionado por IA transforma a scriptagem manual em experimentação adaptativa.

Implementando Testes de Agentes de IA no LoadView

Agentes de IA podem ser de ponta, mas ainda se comunicam através de protocolos familiares—HTTP, WebSocket ou APIs REST. Isso significa que você pode testá-los com a mesma infraestrutura que o LoadView já oferece.

Teste baseado em API é a base. Cada requisição de agente, independentemente da complexidade, eventualmente se resolve em uma chamada API—geralmente JSON sobre HTTPS. O teste de API do LoadView permite que equipes simulem milhares de requisições concorrentes de inferência, cada uma parametrizada com payloads dinâmicos. Você pode variar o tamanho do prompt, injetar contexto e medir latência de ponta a ponta.

Scripting UserView estende essa simulação através da interface do usuário. Muitos agentes de IA vivem dentro de dashboards, portais de chat ou integrações SaaS. Com o LoadView, você pode registrar fluxos de trabalho completos—login, entrada de prompt, renderização de resposta—e reproduzi-los a partir de locais distribuídos em nuvem. Essa abordagem valida tanto o backend quanto o frontend sob condições reais de navegador.

Orquestração escalável conecta tudo. A rede em nuvem do LoadView distribui testes geograficamente, permitindo que equipes vejam como o tráfego global afeta endpoints de IA que dependem de clusters de GPU centralizados. Ao correlacionar tempos de resposta com distância geográfica, você pode separar a latência da rede da latência do modelo.

Análise e relatórios completam o ciclo de feedback. O LoadView rastreia todas as métricas padrão de desempenho, mas também pode ser customizado para capturar certos tipos de dados. Essa combinação transforma testes sintéticos em uma camada de observabilidade para desempenho de IA.

Em outras palavras, você não precisa de uma nova plataforma de teste para sistemas de IA—você precisa de um design de teste mais inteligente dentro de uma já existente. O LoadView já tem os primitivos, e essa nova classe de cargas simplesmente exige uma filosofia de teste diferente.

O Futuro do Teste de Carga para IA

Sistemas de IA não são serviços estáticos—são adaptativos, estocásticos e continuamente re-treinados. Isso significa que suas características de desempenho mudam mesmo quando a infraestrutura permanece a mesma. Uma atualização de modelo que melhora a precisão pode dobrar o tempo de inferência. Uma mudança no prompt que aumenta a coerência pode explodir o tamanho do contexto. O teste de carga deve evoluir para considerar esses alvos móveis.

Testes de desempenho futuros vão unir simulação, análise e ciclos de feedback autoaprendentes. Testes adaptarão em tempo real, expandindo ou reduzindo a carga com base na estabilidade observada do modelo. Ao invés de “executar teste, ler relatório”, engenheiros manterão linhas de base contínuas de desempenho que se atualizam conforme os modelos mudam.

O foco vai além do throughput. A pergunta chave não será “Ele aguenta 1000 usuários?” mas “Ele pensa consistentemente sob pressão?” Medir estabilidade cognitiva—como a qualidade do raciocínio degrada quando a demanda dispara—se tornará uma métrica padrão.

Para organizações que implantam copilotos de IA, assistentes de chat e agentes de decisão automatizados, essa evolução já está em curso. Os sistemas são novos, mas o princípio permanece eterno: você não pode melhorar o que não mede. O teste de carga sempre foi a disciplina de expor limites ocultos. A IA só adiciona um novo tipo de limite—a fronteira entre desempenho e inteligência.

Teste de Carga para Agentes de IA – Concluindo

Agentes de IA introduzem uma nova dimensão ao teste de desempenho. Combinam computação pesada, contexto dinâmico e escala imprevisível. Scripts tradicionais de teste de carga não conseguem acompanhar, mas abordagens impulsionadas por IA podem. Focando em latência de inferência, escala do contexto e estabilidade da concorrência—e usando ferramentas como o LoadView para simular fluxos completos de raciocínio—as equipes podem preservar a confiabilidade mesmo quando a inteligência se torna o núcleo dos seus sistemas.

A próxima era do teste de carga não medirá apenas quão rápido os sistemas respondem. Medirá o quão bem eles pensam quando todos perguntam ao mesmo tempo.