Les agents IA changent la signification de « charge ». Les tests de charge traditionnels ont été conçus pour les pages web, les API et les transactions — des systèmes qui se comportent de manière prévisible sous stress. Les charges de travail pilotées par l’IA ne le sont pas. Leurs entrées varient en longueur, complexité et contexte. Leur traitement est probabiliste, non déterministe. Leur performance dépend autant de la planification GPU et de la génération de tokens que de la latence réseau ou du débit du backend.

Ce changement remet en question les hypothèses sur lesquelles la plupart des tests de charge sont construits. Vous ne pouvez pas traiter un agent IA comme un autre point de terminaison API. Chaque requête est une conversation, pas un clic. Chaque réponse dépend de la précédente. Et chaque session s’alourdit avec l’accumulation du contexte.

Pour maintenir ces systèmes fiables, les ingénieurs en performance ont besoin d’un nouveau manuel — un qui comprend comment simuler un raisonnement concurrent, pas seulement un trafic concurrent. Cet article décrit des stratégies modernes, propulsées par l’IA, pour tester des agents à grande échelle et les garder performants à mesure que la complexité augmente.

Défis de performance dans le test de charge des agents IA

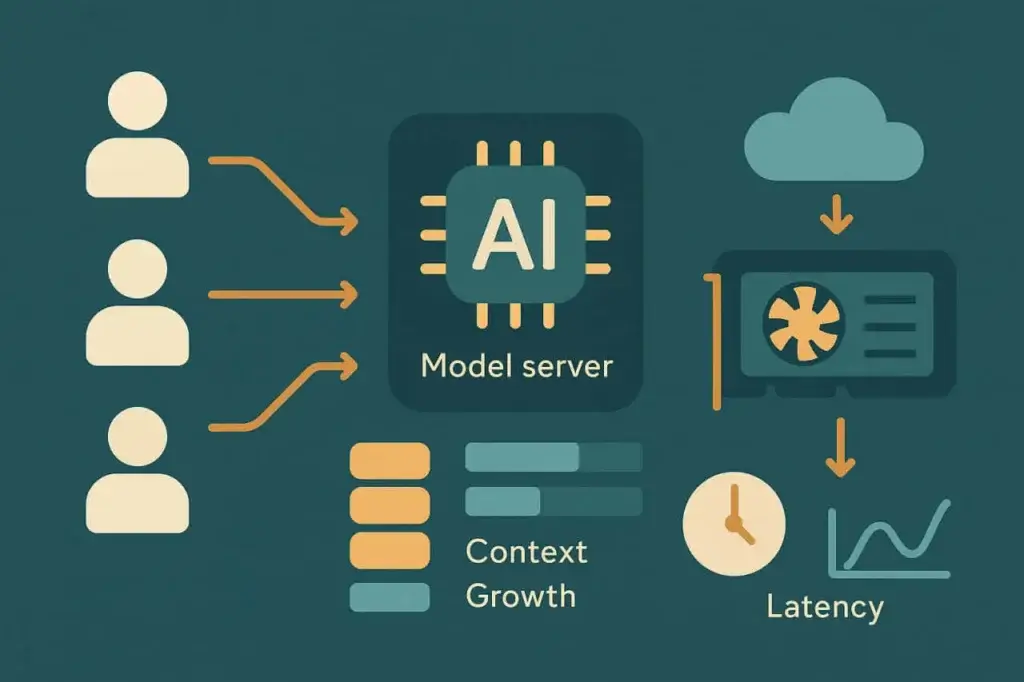

Les charges de travail IA ne se comportent pas comme le trafic web ou mobile. Chaque « utilisateur » dans un système piloté par IA peut représenter une série d’opérations en chaîne : une expansion de prompt, la récupération de contexte pertinent, l’inférence du modèle, et le post-traitement ou l’exécution d’outils. La charge n’est pas fixe — elle évolue à chaque tour de l’interaction.

À mesure que ces couches s’empilent, la dégradation des performances devient non linéaire. Un doublement du nombre d’utilisateurs concurrents ne signifie pas un doublement de la latence — cela peut signifier un facteur 5, selon la charge du modèle, la mémoire et l’allocation GPU. Les métriques traditionnelles du test de charge comme les requêtes par seconde ou le temps moyen de réponse ne captent pas ces dynamiques sous-jacentes. Ce qui importe ici est l’élasticité de la latence — comment la performance fléchit à mesure que les sessions se multiplient.

Plusieurs facteurs de stress récurrents existent dans les systèmes d’agents IA :

Accumulation de contexte

Chaque requête utilisateur transporte un contexte historique — parfois des milliers de tokens de conversation antérieure ou de données de documents. À mesure que la longueur du contexte augmente, la taille du prompt gonfle et le temps d’inférence du modèle s’allonge. À grande échelle, cela crée des pics de latence imprévisibles et une pression dans les files d’attente des GPU.

Passage à l’échelle limité par le calcul

Contrairement aux serveurs web, l’inférence sur de grands modèles ne peut pas toujours s’étendre horizontalement. Les poids du modèle et les fenêtres de contexte consomment une mémoire GPU fixe ; dépasser cette capacité signifie mettre les requêtes en file d’attente ou revenir à des modèles plus petits. Cela rend les limites de concurrence beaucoup plus strictes que dans les systèmes basés sur CPU.

Latence de récupération

Beaucoup d’agents extraient des données externes — via des bases de données vectorielles, des APIs ou des magasins de documents — avant de générer une réponse. Ces dépendances ajoutent de la latence entrée-sortie et deviennent le premier goulet d’étranglement sous un trafic en rafale.

Persistance de la session

Les tests de charge traditionnels rejouent des requêtes sans état. Les sessions IA ont un état. Chacune porte mémoire, embeddings et contexte mis en cache. Plus la conversation dure, plus l’empreinte de la session est lourde.

Ces facteurs se combinent en un nouveau profil de stress. Le système peut paraître sain à 100 utilisateurs simultanés mais flancher à 120, non pas à cause d’une saturation de bande passante mais à cause de la saturation de la file d’attente GPU ou du débordement du cache de contexte. Tester la charge des systèmes IA signifie révéler où commencent ces points d’inflexion non linéaires.

Comprendre le comportement des charges de travail des agents IA

Avant de concevoir des tests, il est utile de modéliser comment un agent IA se comporte réellement en interne. La plupart des agents en production suivent un pipeline similaire :

- Ingestion d’entrée. L’utilisateur envoie une requête ou un message.

- Assemblage du contexte. L’agent collecte des données pertinentes des tours précédents ou d’une source externe.

- Inférence du modèle. Le prompt assemblé est envoyé à un point d’accès modèle local ou distant.

- Post-traitement. La sortie peut être analysée, validée ou enrichie avant retour.

- Livraison de la réponse. L’agent met à jour l’état de l’interface utilisateur ou envoie une réponse API.

Chaque étape ajoute de la variabilité. Le temps d’inférence évolue grossièrement avec le nombre de tokens en entrée et en sortie. La latence de récupération dépend de la proximité de la base de données et des taux de cache. Le coût d’assemblage du contexte augmente à chaque tour de conversation.

Pour comprendre le comportement des performances, il faut observer comment ces dimensions interagissent. Par exemple, doubler la longueur du prompt peut augmenter la latence moyenne d’inférence de 60%, mais une concurrence au-delà d’un certain seuil peut la faire tripler. Ces courbes importent plus que n’importe quelle métrique isolée.

Le test de charge des systèmes IA est en partie statistique. Vous ne mesurez pas seulement le débit — vous construisez des distributions de réponses. Les extrémités de ces distributions — les latences au 95e et 99e percentile — vous indiquent quand le modèle ou l’infrastructure commence à saturer. C’est là que se produisent la plupart des ralentissements visibles par l’utilisateur.

En pratique, cartographier le comportement de charge signifie exécuter des tests progressifs. Commencez avec quelques sessions simultanées, capturez la latence de base, puis montez en charge progressivement. Observez comment le débit de tokens, les temps d’attente et l’utilisation GPU réagissent. Chaque agent a sa propre signature d’échelle, et la trouver est la première étape vers des opérations fiables.

Métriques clés à mesurer dans les tests de charge des agents IA

Les métriques traditionnelles — RPS, TTFB, taux d’erreur — restent valides, mais elles ne racontent pas toute l’histoire. Le test de charge des agents IA introduit de nouvelles métriques qui reflètent comment l’intelligence, pas seulement l’infrastructure, s’échelle.

Latence d’inférence mesure le temps total de la soumission du prompt à la réponse complète du modèle. C’est le signal de performance le plus direct mais doit être suivi conjointement avec la taille de l’entrée et le type de modèle. Comparer de simples moyennes sans normalisation de la taille du contexte peut induire en erreur.

Mise à l’échelle du contexte quantifie comment la latence croît à mesure que la fenêtre de prompt s’élargit. Les ingénieurs peuvent tracer le temps de réponse en fonction du nombre de tokens pour visualiser la courbe de coût. Un système bien optimisé montre une mise à l’échelle linéaire ou sous-linéaire, tandis que les systèmes mal optimisés présentent des pics exponentiels après certains seuils de contexte.

Débit de tokens — tokens traités par seconde sur les sessions simultanées — reflète à la fois la performance et l’efficacité des coûts. Comme la plupart des APIs facturent au token, une baisse de débit se traduit directement par une inefficacité économique.

Latence des dépendances capture les délais des systèmes auxiliaires : index de recherche vectorielle, bases de connaissances, ou APIs de plugins. Ceux-ci peuvent dominer le temps de réponse total même lorsque l’inférence est rapide.

Stabilité de la concurrence mesure le comportement du système sous charge simultanée. La latence croît-elle de façon prévisible ? Les taux d’erreur restent-ils limités ? Ou les temps de réponse oscillent-ils fortement à mesure que les files d’attente se forment ?

En combinant ces métriques, les équipes peuvent construire une image holistique de la performance. Le but n’est pas seulement de mesurer la vitesse — c’est de comprendre où et pourquoi la dégradation commence.

Concevoir des tests de charge efficaces pour les systèmes IA

Avec les métriques définies, la stratégie de test devient une question de fidélité de simulation. Les agents IA ne servent pas des requêtes identiques, donc enregistrer une seule transaction et la rejouer à charge est inutile. Chaque utilisateur synthétique doit représenter une variété — prompts différents, longueurs variées, comportements divers. L’objectif n’est pas l’uniformité mais le réalisme.

1. Modéliser le pipeline complet du raisonnement, pas seulement le point d’accès

Les vrais utilisateurs ne se contentent pas d’appeler /generate isolément. Ils s’authentifient, soumettent du contexte, invoquent la récupération, puis génèrent la sortie. Un test de charge crédible imite cette séquence. Sauter une couche rend vos données sans sens.

2. Paramétrer les prompts pour refléter la vraie diversité

Les systèmes IA ralentissent quand la longueur d’entrée ou la complexité sémantique augmente. Utilisez des modèles de prompt variables qui ajustent les comptes de tokens, les structures de phrases ou la profondeur du contexte intégré. Cela révèle comment l’échelle affecte la distribution des temps de réponse.

3. Monter la concurrence progressivement

Les backends IA mettent souvent les requêtes en file à l’étape d’inférence. Plutôt que de monter brutalement à 1000 utilisateurs, montez progressivement en paliers définis — par exemple, 10 → 50 → 100 → 200 — en tenant chaque palier plusieurs minutes. La courbe résultante révèle où la saturation GPU ou des threads commence.

4. Suivre les coûts en parallèle des performances

Contrairement aux serveurs web, les APIs d’inférence facturent par token. Pendant les tests de charge, calculez le coût par requête à chaque niveau de concurrence. L’optimisation des performances doit inclure l’efficacité économique — des modèles rapides mais coûteux peuvent échouer financièrement à grande échelle même s’ils passent techniquement.

5. Inclure le comportement de retry et de timeout

Les points d’accès IA limitent souvent le débit ou dégradent les performances sous forte utilisation. Simulez la logique de retries client pour observer les effets de charge composés. Un backoff exponentiel naïf peut doubler le trafic effectif quand les échecs augmentent.

Ces stratégies remplacent l’ancien modèle « enregistrer et rejouer » par une approche de simulation comportementale. Au lieu de tester des transactions, vous testez la cognition — comment le système pense et s’échelonne simultanément.

Tests de charge propulsés par l’IA : laissez les modèles aider

Ironiquement, l’IA peut aider à résoudre le problème qu’elle crée. Les plateformes modernes de test commencent à intégrer directement des modèles d’apprentissage machine dans leurs boucles d’analyse, produisant ce que l’on appelle souvent test de charge propulsé par l’IA.

Ici, l’IA joue trois rôles :

Génération de prompt

Plutôt que de créer manuellement des centaines d’entrées de test, un modèle génératif peut produire des variations de prompt simulant la diversité réelle des utilisateurs. Il peut ajuster le ton, la structure et le contexte automatiquement, exposant le système à un plus large éventail de schémas de stress.

Détection d’anomalies

Les modèles IA peuvent détecter les dérives statistiques dans les données de performance plus rapidement que des seuils statiques. Plutôt que d’alerter quand la latence dépasse une limite fixe, les modèles d’anomalie apprennent la variance normale et font remonter des exceptions indiquant une dégradation réelle.

Analyse prédictive de saturation

En analysant les données historiques de charge, l’IA peut prévoir quand un système atteindra son prochain seuil critique de performance. Les modèles de régression ou les prédicteurs de séries temporelles identifient les schémas de mise à l’échelle non linéaires avant qu’ils ne cassent la production.

L’avantage n’est pas une automatisation magique, c’est une accélération. Les ingénieurs passent moins de temps à la maintenance répétitive et plus à interpréter pourquoi les performances changent. Le test de charge propulsé par l’IA transforme le script manuel en expérimentation adaptative.

Implémentation des tests d’agents IA dans LoadView

Les agents IA peuvent être à la pointe, mais ils communiquent encore via des protocoles familiers — HTTP, WebSocket ou REST APIs. Cela signifie que vous pouvez les tester avec la même infrastructure que LoadView fournit déjà.

Le test basé API est la base. Chaque requête agent, quelle que soit sa complexité, se résout finalement à un appel API — souvent du JSON sur HTTPS. Les tests API de LoadView permettent aux équipes de simuler des milliers de requêtes d’inférence simultanées, chacune paramétrée avec des charges dynamiques. Vous pouvez varier la taille du prompt, injecter du contexte et mesurer la latence du début à la fin.

Le scripting UserView étend cette simulation à l’interface utilisateur. Beaucoup d’agents IA vivent dans des tableaux de bord, des portails de chat ou des intégrations SaaS. Avec LoadView, vous pouvez enregistrer des flux complets — connexion, saisie de prompt, rendu de la réponse — et les rejouer depuis des emplacements cloud distribués. Cette approche valide à la fois le backend et le frontend sous de vraies conditions de navigateur.

L’orchestration scalable relie tout cela. Le réseau cloud de LoadView répartit les tests sur différentes géographies, permettant aux équipes de voir comment le trafic global affecte des points d’accès IA qui dépendent de clusters GPU centralisés. En corrélant les temps de réponse avec la distance géographique, vous pouvez distinguer la latence réseau de la latence du modèle.

Les analyses et rapports complètent la boucle de rétroaction. LoadView suit toutes les métriques classiques de performance mais peut aussi être personnalisé pour capturer certains types de données. Cette combinaison transforme le test synthétique en une couche d’observabilité pour la performance IA.

En d’autres termes, vous n’avez pas besoin d’une nouvelle plateforme de test pour les systèmes IA — vous avez besoin d’un design de test plus intelligent dans une plateforme existante. LoadView possède déjà les primitives, et cette nouvelle classe de charges de travail exige simplement une philosophie de test différente.

L’avenir du test de charge IA

Les systèmes IA ne sont pas des services statiques — ils sont adaptatifs, stochastiques et continuellement réentraînés. Cela signifie que leurs caractéristiques de performance évoluent même lorsque l’infrastructure reste la même. Une mise à jour de modèle qui améliore la précision peut doubler le temps d’inférence. Un changement de prompt qui améliore la cohérence peut exploser la taille du contexte. Le test de charge doit évoluer pour tenir compte de ces cibles mouvantes.

Les futurs tests de performance mêleront simulation, analyses et boucles de rétroaction auto-apprenantes. Les tests s’adapteront en temps réel, élargissant ou resserrant la charge selon la stabilité observée du modèle. Au lieu de « lancer un test, lire un rapport », les ingénieurs maintiendront des bases de référence de performance continues qui se mettent à jour avec la dérive des modèles.

L’attention se déplacera au-delà du débit. La question clé ne sera plus « Peut-il gérer 1000 utilisateurs ? » mais « Peut-il penser de façon cohérente sous pression ? » Mesurer la stabilité cognitive — comment la qualité du raisonnement décroît quand la demande explose — deviendra une métrique standard.

Pour les organisations déployant copilotes IA, assistants de chat et agents décisionnels automatisés, cette évolution est déjà en marche. Les systèmes sont nouveaux, mais le principe reste intemporel : on ne peut pas améliorer ce que l’on ne mesure pas. Le test de charge a toujours été la discipline d’exposition des limites cachées. L’IA ajoute juste un nouveau type de limite — la frontière entre performance et intelligence.

Test de charge pour agents IA – En résumé

Les agents IA introduisent une nouvelle dimension dans les tests de performance. Ils combinent calcul intensif, contexte dynamique et mise à l’échelle imprévisible. Les scripts de test de charge traditionnels ne suivent pas le rythme, mais les approches propulsées par l’IA le peuvent. En se concentrant sur la latence d’inférence, la mise à l’échelle du contexte et la stabilité de la concurrence — et en utilisant des outils comme LoadView pour simuler les workflows complets de raisonnement — les équipes peuvent préserver la fiabilité même à mesure que l’intelligence devient le cœur de leurs systèmes.

La prochaine ère du test de charge ne mesurera pas seulement la rapidité des réponses. Elle mesurera la capacité à penser efficacement quand tout le monde demande en même temps.