Un bref aperçu des tests de performance

Les tests de performance sont une méthode essentielle pour évaluer et garantir cette promesse. C’est un terme large englobant divers types de tests, chacun conçu pour mesurer des aspects spécifiques des performances d’un système. Du test de charge qui simule le trafic utilisateur attendu au test de stress qui pousse le système au-delà de ses limites, les tests de performance sont une évaluation complète de la manière dont une application ou un système se comporte dans différents scénarios. Ces tests plongent profondément dans les comportements du système, révélant les points de congestion potentiels, les ralentissements et les plantages qui pourraient affecter la disponibilité et la fonctionnalité du système.

L’importance des tests de performance

L’importance des tests de performance ne peut être surestimée. À une époque où les utilisateurs attendent une réponse instantanée et des expériences fluides, même de petits problèmes de performance peuvent entraîner une insatisfaction significative des utilisateurs, une réputation de marque ternie et, en fin de compte, une perte d’affaires. Les tests de performance fournissent les informations nécessaires pour optimiser les performances du système, garantissant que ces systèmes cruciaux restent stables et disponibles même sous une utilisation rigoureuse.

De plus, des tests de performance rigoureux sont encore plus cruciaux pour des systèmes tels que les applications financières, les plateformes de jeux en ligne ou les applications de commerce électronique qui doivent gérer un trafic ou des charges de données importants. Ils garantissent que ces systèmes sont robustes, évolutifs et capables de fournir des performances élevées de manière constante, même dans des circonstances extrêmes.

En essence, les tests de performance sont une partie essentielle du cycle de vie du développement logiciel, fournissant une voie proactive pour que les organisations améliorent leurs systèmes et applications, assurant ainsi la satisfaction des utilisateurs et la continuité des activités.

Les types de tests de performance les plus populaires

1) Test de charge

Le test de charge est un type de test de performance qui évalue les performances d’une application ou d’un système sous une charge utilisateur typique et attendue. L’objectif principal du test de charge est de comprendre comment le système traite le trafic utilisateur et les transactions, en s’assurant qu’il reste stable et accessible dans ces conditions. C’est une étape cruciale pour garantir la fiabilité et l’évolutivité des applications ou des systèmes, en particulier ceux ayant un trafic utilisateur élevé ou qui traitent des processus métier critiques.

Le processus de test de charge implique la simulation d’une charge de travail qui imite expecté le trafic utilisateur et les transactions. Les testeurs peuvent réaliser cette simulation en utilisant des outils de test automatisés ou en saisissant manuellement des données et en exécutant des transactions. En appliquant cette charge simulée, les organisations peuvent identifier et résoudre les problèmes de performance avant qu’ils n’affectent les utilisateurs finaux.

Il existe divers outils disponibles pour le test de charge, chacun avec ses fonctionnalités et capacités uniques. Parmi les plus couramment utilisés, on trouve Apache JMeter, Gatling et LoadRunner. Ces outils permettent de créer des scénarios de charge réalistes, des rapports détaillés et une analyse des performances du système sous charge.

Le test de charge peut présenter plusieurs défis. Il nécessite une compréhension approfondie de l’architecture du système et du comportement attendu des utilisateurs. Le choix d’un outil de test de charge approprié capable de simuler des scénarios de charge réalistes est également crucial. L’interprétation des résultats des tests de charge requiert une expertise, car elle implique l’analyse de diverses métriques et la compréhension de leur impact sur les performances du système.

Trouver les charges maximales

Identifier les charges maximales est un aspect critique du test de charge. La charge maximale fait référence à la capacité opérationnelle maximale qu’une application ou un système peut gérer avant que ses performances ne se dégradent ou ne cessent de fonctionner. Il est essentiel de comprendre la charge maximale pour garantir que l’application ou le système peut supporter le trafic utilisateur le plus élevé attendu.

Trouver la charge maximale consiste à augmenter progressivement la charge sur le système jusqu’au point où ses performances commencent à se dégrader, c’est-à-dire où les temps de réponse augmentent, les taux d’erreur augmentent ou les ressources sont entièrement utilisées. La charge maximale peut varier selon les applications et dépend de facteurs tels que l’architecture du système, les ressources et la nature des requêtes des utilisateurs.

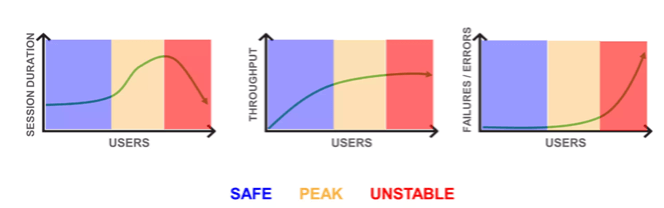

Comprendre les courbes de charge

Une courbe de charge est une représentation graphique des performances d’un système en fonction de différents niveaux de charge. Elle trace des métriques telles que le temps de réponse, le débit ou l’utilisation des ressources par rapport au nombre d’utilisateurs ou de requêtes au fil du temps. Cette courbe aide à visualiser comment le système se comporte sous différentes conditions de charge.

Figure 1 : Trouver la charge maximale du système

Courbes de charge

Une courbe de charge idéale devrait être relativement plate, indiquant que la performance du système reste stable à mesure que la charge augmente. Cependant, lorsque la charge dépasse la capacité du système (charge maximale), la courbe commence à monter en flèche, montrant une dégradation des performances.

Comprendre la courbe de charge est crucial pour interpréter les résultats d’un test de charge. Cela aide à identifier les goulets d’étranglement du système, à comprendre son comportement sous différents niveaux de charge, et à déterminer ses besoins en évolutivité et en planification de capacité. La courbe de charge peut également guider les optimisations et améliorations du système pour gérer efficacement la charge accrue.

2) Test de Stress

Le test de stress est une méthodologie critique de test de performance qui se concentre sur la détermination de la performance d’une application ou d’un système sous des conditions de charge extrêmes, souvent au-delà de sa capacité maximale. Le but fondamental du test de stress est double. Premièrement, il détermine la limite absolue du système ou son point de rupture, après lequel il ne peut plus fonctionner comme prévu. Deuxièmement, le test de stress vise à comprendre comment le système se remet de ces situations de stress intense, souvent appelé sa résilience ou robustesse.

De plus, le test de stress est primordial pour identifier les problèmes de performance potentiels qui peuvent survenir dans des circonstances extraordinaires, y compris les goulets d’étranglement du système, les ralentissements ou les pannes. Il est essentiel pour assurer la stabilité et la disponibilité des systèmes ou applications critiques qui doivent gérer un trafic ou des charges de données importantes, comme les applications financières, les plateformes de jeux en ligne ou les applications e-commerce. En réalisant des tests de stress, les organisations peuvent maintenir la satisfaction client et prévenir les pertes de profits en garantissant que ces systèmes restent robustes même dans des conditions extrêmes.

La réalisation des tests de stress implique de simuler un volume extrêmement élevé de trafic ou de données, souvent dépassant la capacité maximale du système, afin d’identifier comment le système se comporte dans de telles conditions. Des outils de test automatisés peuvent effectuer cette simulation en générant un grand nombre d’utilisateurs, ou des personnes peuvent manuellement saisir des données et exécuter des transactions. La méthodologie suit une approche progressive où la charge augmente graduellement jusqu’à ce que le système atteigne son point de rupture. Les observateurs surveillent de près la performance du système au-delà de ce point, examinant comment il se remet et gère la charge extrême, obtenant ainsi des informations précieuses sur sa robustesse.

Malgré son importance benefits, les tests de résistance présentent leurs défis. L’un des principaux défis est de déterminer la quantité ‘juste’ de stress ou de charge pour tester les limites du système sans causer de dommages irréparables. Cela nécessite une compréhension approfondie de l’architecture du système et de ses composants. Un autre défi est l’interprétation des résultats du test de résistance, qui peut être complexe. Contrairement à d’autres formes de test où des critères clairs de réussite/échec existent, les résultats des tests de résistance sont plus nuancés. Bien que les analystes s’attendent à ce que le système échoue, ils doivent analyser attentivement à quel moment il échoue et comment il se rétablit.

De plus, les tests de résistance peuvent être longs et gourmands en ressources, surtout pour les grands systèmes avec de nombreux composants. Également, reproduire un environnement similaire à la production capable d’émuler des conditions extrêmes peut être techniquement difficile et coûteux. Malgré ces défis, les informations obtenues grâce aux tests de résistance sont inestimables pour améliorer la performance et la robustesse du système, ce qui en fait une partie essentielle du régime de tests de performance.

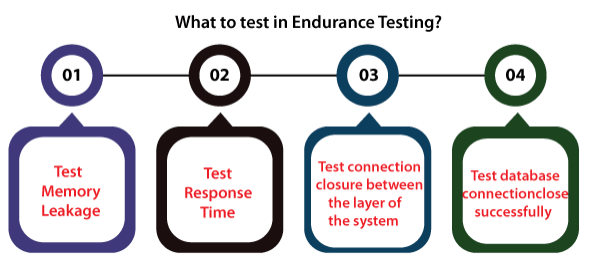

3) Test d’endurance

La méthodologie du test d’endurance consiste à simuler une charge sur une période prolongée, qui peut aller de plusieurs heures à des jours voire des semaines, afin d’observer comment le système se comporte sous une utilisation soutenue. Cela nécessite de créer des scénarios utilisateur réalistes et de maintenir une charge d’application ou de système constante.

Des outils de test automatisés sont généralement utilisés pour ce processus, bien que l’entrée manuelle de données et l’exécution de transactions puissent également faire partie de la méthodologie. Les méthodes pour les tests d’endurance impliquent de simuler une charge typique de production puis de maintenir cette charge pendant une période prolongée, souvent plusieurs heures à plusieurs jours, selon le système testé. Le test est conçu pour révéler des problèmes qui ne deviennent visibles qu’au fil du temps, tels que la dégradation progressive des temps de réponse, les fuites de mémoire ou l’épuisement des ressources.

Le test d’endurance présente ses propres défis uniques. Premièrement, il est chronophage en raison de la nécessité de tests prolongés pour simuler efficacement une utilisation soutenue. Cela peut souvent entraîner des retards dans le cycle de développement si ce n’est pas planifié et géré correctement.

Deuxièmement, il peut être gourmand en ressources, nécessitant un environnement de test qui reflète le plus fidèlement possible l’environnement de production. De plus, en raison de la durée prolongéeion du test, toute perturbation ou incohérence dans l’environnement de test peut affecter la validité des résultats du test.

Enfin, détecter et diagnostiquer les problèmes peut être plus complexe lors des tests d’endurance. Des problèmes tels que les fuites de mémoire ou l’épuisement des ressources peuvent être subtils et nécessiter une surveillance et une analyse attentives pour être détectés et diagnostiqués. Malgré ces défis, les tests d’endurance constituent un élément crucial des tests de performance, fournissant des informations et des garanties que les méthodes de test à court terme ne peuvent pas offrir.

4) Test de pic

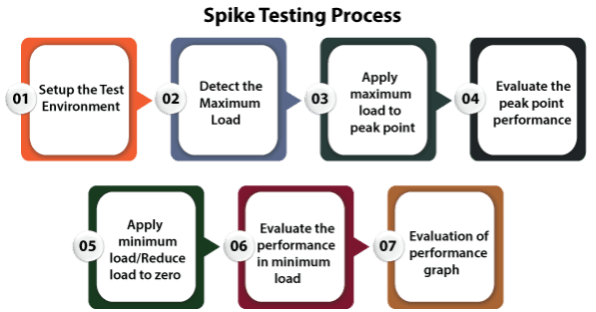

Le test de pic est une forme spécialisée de test de performance qui examine la résilience et l’adaptabilité d’une application ou d’un système face à des augmentations soudaines et extrêmes de la charge, appelées « pics ». Ces pics reproduisent souvent des scénarios réels, tels qu’une augmentation du trafic utilisateur pendant les heures de pointe ou des événements inattendus. Le test de pic est essentiel pour garantir la robustesse d’une application ou d’un système.

L’objectif principal du test de pic est de déterminer si l’application ou le système peut gérer efficacement des pics de charge inattendus sans subir de dégradation des performances ou de défaillance. En d’autres termes, il teste l’élasticité du système, en s’assurant qu’il peut s’adapter à la hausse pour répondre à la demande, puis redescendre lorsque le pic diminue.

La méthodologie du test de pic consiste à injecter intentionnellement des charges soudaines et extrêmes sur le système et à observer sa réaction. Les outils de test automatisés réalisent souvent cela en simulant une augmentation brusque du trafic ou en permettant aux testeurs de recréer le pic.

Les testeurs soumettent d’abord le système à une charge standard dans un scénario typique de test de pic. Un pic est ensuite introduit, augmentant temporairement la charge de manière significative. Après le pic, la charge revient à des niveaux normaux. Généralement, les testeurs répètent ce cycle plusieurs fois pour évaluer la capacité du système à gérer plusieurs pics de charge.

L’un des principaux défis du test de pic est l’imprévisibilité des résultats. Étant donné que le test de pic implique de tester la réponse du système à des augmentations soudaines et extrêmes de charge, les résultats peuvent varier considérablement en fonction de facteurs tels que l’architecture du système, les ressources disponibles et la charge de travail.

Un autre défi est de définir ce qui constitue un « pic ». Dans les scénarios réels, les pics peuvent varier considérablemently en durée, intensité et fréquence. Par conséquent, définir un pic approprié pour les tests peut être difficile et peut nécessiter une compréhension approfondie des schémas d’utilisation du système et des scénarios de charge potentiels.

Enfin, simuler avec précision un pic peut être techniquement complexe. Cela nécessite des outils de test sophistiqués capables de générer et de contrôler des niveaux de charge extrêmes. De plus, interpréter les résultats des tests de pic et identifier les goulots d’étranglement ou les problèmes de performance requiert un haut degré d’expertise technique.

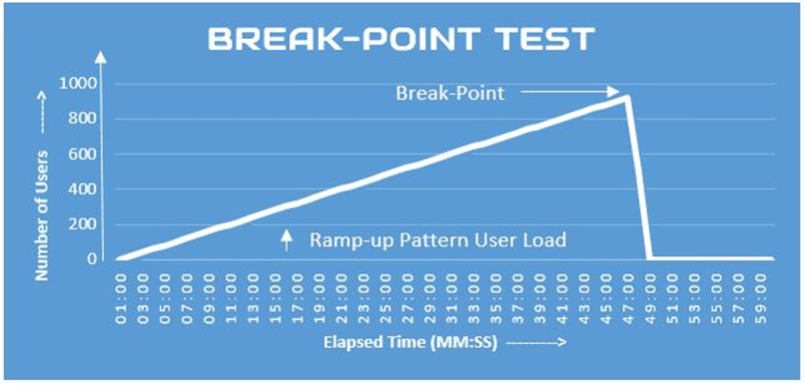

5) Test de point d’arrêt

Le test de point d’arrêt est un outil essentiel dans l’arsenal du développeur, utilisé pendant le développement logiciel pour identifier et corriger les défauts dans le code. En essence, un point d’arrêt est un marqueur placé sur une ligne spécifique du code où un développeur soupçonne la présence d’un défaut. Lorsque le programme s’exécute, l’exécution s’arrête au point d’arrêt, permettant au développeur d’inspecter en profondeur l’état et le comportement du programme à ce moment précis.

Le but du test de point d’arrêt est double. D’abord, il aide à détecter les défauts dans le code pendant la phase de développement. Cette approche préventive garantit que le logiciel fonctionne correctement et est exempt de bugs avant sa diffusion aux utilisateurs finaux. Ensuite, il offre aux développeurs un moyen de comprendre et de naviguer dans le flux d’exécution du programme, améliorant ainsi leur capacité à créer un code de haute qualité et efficace.

La méthodologie du test de point d’arrêt est simple et intuitive. Un développeur commence par définir un point d’arrêt sur une ligne spécifique du code où un défaut potentiel est suspecté. Les développeurs réalisent cela en utilisant un outil de débogage ou un environnement de développement intégré (IDE), comme Visual Studio ou Eclipse, qui prennent en charge la définition des points d’arrêt. Le programme s’arrête à chaque point d’arrêt lorsqu’il est exécuté. Cela permet au développeur d’examiner l’état du programme à cette ligne exacte de code, y compris les valeurs des variables, l’état de la mémoire et la pile d’appels. Si le développeur découvre un problème, il peut modifier le code pour le corriger, vérifier la correction en poursuivant l’exécution, et définir de nouveaux points d’arrêt selon les besoins pour un diagnostic et un débogage supplémentaires du programme.

Malgré ses nombreux avantages, le test de point d’arrêt présente ses défis. D’une part, il peut être chronophage, surtout pour les programmes plus grands et complexes avec de multiples potential fault points. De plus, définir trop de points d’arrêt peut perturber le flux d’exécution et rendre le processus de débogage plus confus.

En outre, il peut être difficile de localiser précisément l’emplacement d’un point d’arrêt dans des bases de code complexes. De plus, le problème des Heisenbugs, des bogues qui modifient leur comportement lorsqu’ils sont observés (comme lorsqu’un point d’arrêt est défini), peut rendre les défauts insaisissables et plus difficiles à diagnostiquer et à corriger. Malgré ces défis, les tests par points d’arrêt restent une stratégie inestimable dans le développement logiciel, aidant à garantir la création d’applications logicielles fiables et performantes.

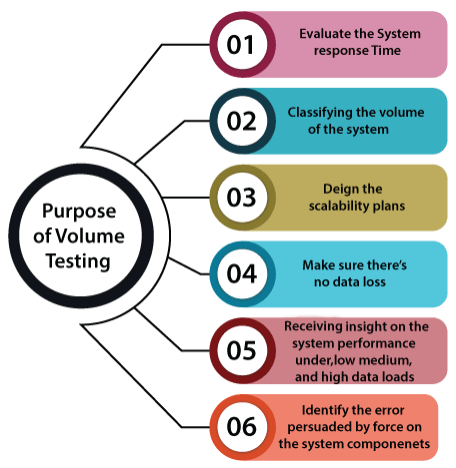

6) Test de volume

Le test de volume est une forme spécialisée de test de performance conçue pour évaluer la performance d’une application ou d’un système sous un volume important de données ou de transactions. Ce type de test est crucial pour les systèmes censés gérer des quantités importantes de données ou effectuer un grand nombre de transactions. Le principal objectif du test de volume est de déterminer la quantité maximale de données ou de transactions que le système peut gérer tout en maintenant des niveaux de performance optimaux. En identifiant les problèmes de performance tôt, les organisations peuvent atténuer de manière proactive les problèmes potentiels de performance, garantissant que le système peut gérer la croissance future et les exigences de scalabilité.

Pour identifier toute limitation ou goulot d’étranglement dans le système, le test de volume consiste à simuler un volume élevé de données ou de transactions, souvent supérieur à l’utilisation maximale prévue. Cette simulation peut être réalisée à l’aide d’outils automatisés qui génèrent un grand volume de données ou de transactions ou par saisie manuelle de données et exécution de transactions. Le processus de test commence par la définition des conditions de test et la conception et la création de cas de test qui génèrent le volume de données souhaité. Les testeurs surveillent ensuite le système pour détecter toute dégradation des performances, panne du système ou autres problèmes liés à la gestion des données.

Le test de volume présente plusieurs défis. Un défi majeur est la mise en place d’un environnement de test qui reflète avec précision l’environnement de production, en particulier en ce qui concerne le volume de données. Les testeurs peuvent également rencontrer des difficultés à créer des données de test réalistes couvrant tous les scénarios possibles. De plus, l’analyse des résultats du test de volume peut être complexe en raison du grand volume de données impliqué. Malgré ces défis, le test de volume reste crucial pour les systèmes censés gérer de grands volumes de données, garantissant qu’ils peuvent répondre aux exigences futures de croissance et de scalabilité.

7) Test de compatibilité

Le test de compatibilité est essentiel à l’assurance qualité des logiciels, garantissant qu’une application ou un système fonctionne dans divers environnements. Son objectif principal est de valider la compatibilité du logiciel avec différentes configurations matérielles, systèmes d’exploitation, environnements réseau, navigateurs et appareils. Le test de compatibilité assure que l’expérience utilisateur finale reste cohérente et satisfaisante, quel que soit le nombre de technologies qu’ils pourraient utiliser pour interagir avec le logiciel.

L’importance du test de compatibilité a augmenté avec la croissance exponentielle de la diversité technologique. La multitude de types d’appareils, systèmes d’exploitation, versions de navigateurs et configurations réseau qu’une application moderne doit supporter peut être impressionnante. Assurer la compatibilité entre toutes ces configurations est vital pour offrir une expérience utilisateur positive et maintenir une base d’utilisateurs large.

Le test de compatibilité peut impliquer des approches de test manuelles et automatisées. Le test manuel peut consister à configurer physiquement différentes configurations matérielles ou à utiliser différents appareils pour tester l’application. D’un autre côté, le test automatisé peut utiliser la technologie de virtualisation ou des logiciels d’émulation d’appareils pour simuler différents environnements, rendant le processus plus rapide et plus efficace.

Le défi le plus significatif dans le test de compatibilité est le nombre de configurations potentielles. Avec de nombreuses combinaisons de matériel, systèmes d’exploitation, navigateurs et environnements réseau, il est impossible de toutes les tester de manière exhaustive. Par conséquent, les testeurs doivent prioriser en fonction des données utilisateur et de la part de marché. Un autre défi est l’évolution constante de la technologie. Les sorties continues de nouveaux appareils, mises à jour des systèmes d’exploitation et versions de navigateurs nécessitent une mise à jour continue de la matrice de tests.

De plus, qu’elle soit physique ou virtuelle, la maintenance de l’infrastructure pour les tests de compatibilité peut être coûteuse et complexe. Malgré ces défis, le test de compatibilité est essentiel dans le paysage technologique diversifié d’aujourd’hui pour assurer qu’une application ou un système offre une expérience utilisateur cohérente et satisfaisante sur toutes les configurations prises en charge.

8) Test de latence

>

Les tests de latence sont comme vérifier la rapidité avec laquelle quelqu’un répond à un message texte. Il s’agit de mesurer combien de temps il faut à un système ou une application pour réagir à nos actions. Dans le monde rapide d’aujourd’hui, personne ne veut attendre que les choses se passent. Les tests de latence nous aident à garantir que nos applications et systèmes sont très réactifs et offrent une expérience utilisateur fluide. Pour cela, nous simulons les actions des utilisateurs et voyons combien de temps le système met à répondre. Nous mesurons attentivement ces temps de réponse pour identifier les retards ou les goulets d’étranglement. Cela nous permet d’identifier les domaines où nous pouvons accélérer et rendre les choses plus efficaces. Bien sûr, il y a quelques défis. Créer un environnement de test qui reflète réellement l’utilisation du système dans le monde réel peut être délicat. Et parfois, il peut être difficile de comprendre exactement ce que les résultats des tests nous disent. Mais en comprenant la latence de nos systèmes, nous pouvons les rendre plus rapides, plus réactifs et, en fin de compte, plus agréables pour les utilisateurs.

9) Test des clients simultanés

Imaginez un jeu en ligne populaire avec des milliers de joueurs essayant tous de se connecter et de jouer en même temps. Le jeu va-t-il planter ? Tout le monde va-t-il subir des lags ? Le test des clients simultanés nous aide à répondre à ces questions. C’est comme un test de résistance pour notre système, conçu pour voir comment il fonctionne lorsque de nombreux utilisateurs essaient d’y accéder en même temps. Nous simulons un grand nombre d’utilisateurs interagissant simultanément avec le système pour voir s’il reste stable, réactif et sans erreurs. Cela est crucial pour des applications telles que les jeux en ligne, les plateformes de streaming et les sites de commerce électronique, en particulier pendant les heures de pointe. Nous surveillons attentivement des indicateurs clés tels que le temps de réponse du système, la quantité de données qu’il peut gérer, le nombre d’erreurs survenant et l’utilisation des ressources système. Bien que simuler de nombreux utilisateurs et interpréter les résultats puisse être délicat, le test des clients simultanés est essentiel pour garantir une expérience fluide et agréable pour tous les utilisateurs.

10) Test du débit

Le test du débit nous aide à comprendre combien de travail notre logiciel ou système peut gérer en un temps donné. Imaginez un restaurant très fréquenté essayant de savoir combien de commandes la cuisine peut gérer sans que cela ne devienne chaotique. C’est essentiellement ce que fait le test du débit ! Nous simulons un grand nombre de requêtes pour voir à quelle vitesse le système peut les traiter, combien de données il peut transférer et combien d’utilisateurs il peut gérer simultanément. Cela est crucial pour les systèmes qui doivent gérer un trafic important, tels que les sites Web avec de nombreux visiteurs ou les systèmes traitant de grandes quantités de données. Nous utilisons des outils spéciaux pour générer ces requêtes et surveiller la réponse du système. Bien que précieux, le test du débit peut être difficile. Générer une charge de travail réaliste et interpréter les résultats nécessitent une attention particolare.l considération. Cependant, en comprenant les limites de notre système, nous pouvons nous assurer qu’il peut gérer les exigences de nos utilisateurs et maintenir un fonctionnement fluide.

Bonus : Test de benchmark

Le test de benchmark est une méthode de test de performance qui mesure l’efficacité d’une application en la comparant à des normes établies ou à la performance d’autres systèmes similaires. C’est un processus clé pour les applications censées fonctionner à certains niveaux de l’industrie, comme les systèmes de transactions financières, les serveurs de bases de données, ou les applications cloud.

Lors du test de benchmark, des indicateurs de performance spécifiques tels que la vitesse de transaction, le débit du système, la latence, et l’utilisation des ressources sont scrutés. Ces indicateurs aident à comprendre la performance d’une application comparée à celle des concurrents ou à un ensemble de critères prédéfinis.

L’exécution des tests de benchmark peut impliquer des complexités, telles que la simulation de conditions d’exploitation réalistes et l’analyse des données comparatives. Il est crucial d’interpréter avec précision les résultats pour une optimisation efficace des performances. Traiter les domaines où une application est déficiente peut être gourmand en ressources, mais c’est essentiel pour garantir que l’application peut offrir une expérience utilisateur optimale et maintenir un avantage compétitif sur le marché.

Ce passage contient également 122 mots et offre un aperçu concis mais complet du test de benchmark, similaire en détail et en complexité à l’exemple fourni sur le test de clients concurrents.

Prendre la mesure des options de test

Le test de performance est un aspect critique du développement logiciel qui assure que les applications et systèmes sont prêts à fournir des performances optimales dans des scénarios réels. Chaque type de test de performance joue un rôle unique et vital dans ce processus.

- Le test de charge aide les organisations à comprendre comment leur application ou système performera sous la charge utilisateur attendue, garantissant stabilité et disponibilité même en cas de pic d’utilisation.

- Le test de stress permet aux équipes d’identifier les points de rupture ou les limites d’utilisation sûres d’une application ou d’un système, ce qui conduit à une meilleure résilience et robustesse.

- Les tests de scalabilité garantissent que l’application peut gérer la croissance en termes d’utilisateurs, de volume de données et de volume de transactions, ce qui les rend indispensables pour un développement tourné vers l’avenir.

- Les tests de compatibilité garantissent que l’application ou le système fonctionne correctement sur divers environnements, y compris le matériel, les systèmes d’exploitation, les environnements réseau et d’autres logiciels, assurant une expérience utilisateur fluide.

- Les tests de latence évaluent la réactivité d’une application, ce qui est crucial pour les applications nécessitant une interaction en temps réel, améliorant ainsi la satisfaction des utilisateurs.

- Les tests d’utilisateurs concurrents et les tests de débit mesurent les performances du système lorsque plusieurs utilisateurs accèdent à l’application simultanément et la quantité de travail que le système peut traiter dans un temps donné. Ces tests sont essentiels pour les systèmes s’attendant à une forte interaction utilisateur, assurant un fonctionnement sans faille.

Les bonnes pratiques exigent que les organisations de développement et d’assurance qualité intègrent les tests de performance dès les premières étapes du cycle de développement et les réalisent régulièrement tout au long de ce cycle. L’importance d’intégrer une modalité de test dès le début du processus de développement ne saurait être surestimée. Cette approche aide à identifier et résoudre les problèmes plus tôt, réduisant ainsi le coût et la complexité des corrections. L’automatisation du processus de test autant que possible devrait également être une haute priorité car elle améliorera l’efficacité et la cohérence.

En regardant vers l’avenir, à mesure que les systèmes logiciels deviennent de plus en plus complexes et que les attentes des utilisateurs en matière de performance continuent d’augmenter, les tests de performance deviendront encore plus essentiels. Avec les avancées en IA et apprentissage automatique, nous pouvons nous attendre à des outils de test de performance plus intelligents capables de prédire et diagnostiquer les problèm issues encore plus efficacement.

Si vous souhaitez commencer à effectuer des tests de charge, assurez-vous de vous inscrire dès aujourd’hui pour un essai gratuit de LoadView !