KI-Agenten verändern, was „Last“ bedeutet. Traditionelles Lasttesting wurde für Webseiten, APIs und Transaktionen entwickelt – Systeme, die sich unter Belastung vorhersehbar verhalten. KI-gesteuerte Workloads tun das nicht. Ihre Eingaben variieren in Länge, Komplexität und Kontext. Ihre Verarbeitung ist probabilistisch, nicht deterministisch. Ihre Leistung hängt ebenso stark von GPU-Planung und Token-Generierung ab wie von Netzwerk-Latenz oder Backend-Durchsatz.

Dieser Wandel bricht die Annahmen, auf denen die meisten Lasttests basieren. Man kann einen KI-Agenten nicht wie einen anderen API-Endpunkt behandeln. Jede Anfrage ist ein Gespräch, kein Klick. Jede Antwort hängt von der vorherigen ab. Und jede Sitzung wird schwerer, wenn sich Kontext ansammelt.

Um diese Systeme zuverlässig zu halten, brauchen Performance-Ingenieure ein neues Handbuch – eines, das versteht, wie man gleichzeitiges Denken simuliert, nicht nur gleichzeitigen Traffic. Dieser Artikel skizziert moderne, KI-gestützte Strategien zum Testen von Agenten in großem Maßstab und zum Erhalt ihrer Leistung bei steigender Komplexität.

Leistungsherausforderungen beim Lasttest von KI-Agenten

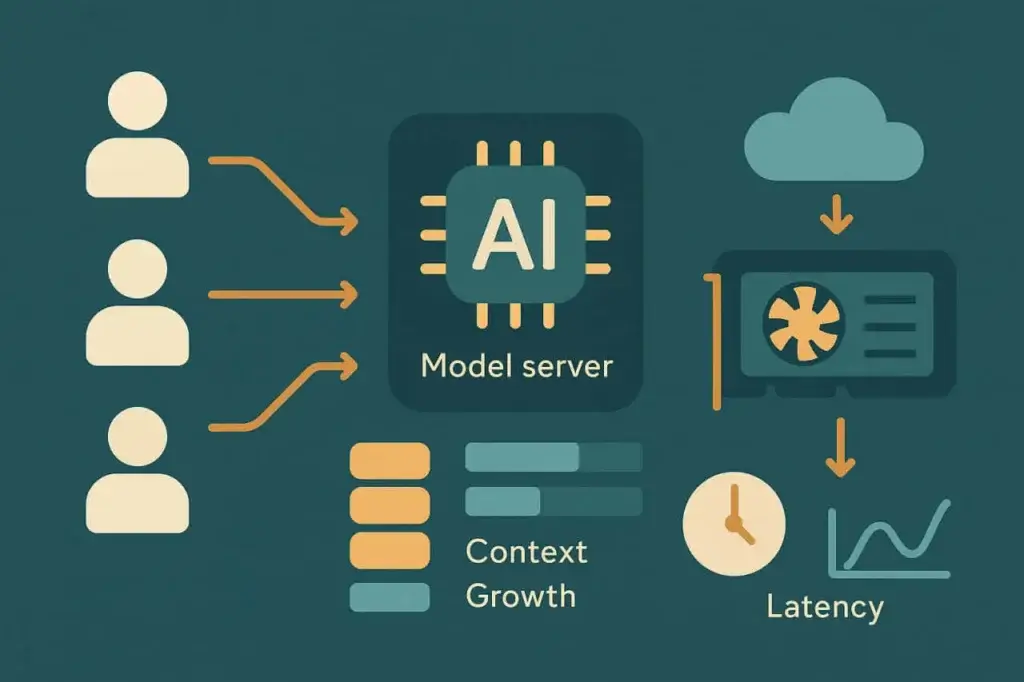

KI-Workloads verhalten sich nicht wie Web- oder Mobilt traffic. Jeder „Benutzer“ in einem KI-gesteuerten System kann eine Reihe verketteter Operationen darstellen: eine Prompt-Erweiterung, Abruf relevanter Kontexte, Modellausführung und Nachbearbeitung oder Werkzeugausführung. Die Last ist nicht fest – sie entwickelt sich mit jeder Interaktionsrunde weiter.

Wenn sich diese Schichten aufbauen, wird die Leistungsverzögerung nichtlinear. Eine Verdopplung der gleichzeitigen Benutzer bedeutet nicht zwangsläufig eine Verdopplung der Latenz – es könnten 5-fache Werte sein, je nach Modellbelastung, Speicher und GPU-Zuweisung. Traditionelle Lasttest-Metriken wie Anfragen pro Sekunde oder durchschnittliche Antwortzeit erfassen die zugrundeliegenden Dynamiken nicht. Entscheidend ist hier Latenzelastizität – wie die Leistung sich verbiegt, wenn Sitzungen sich vervielfachen.

Es gibt mehrere wiederkehrende Belastungsfaktoren in KI-Agent-Systemen:

Kontextansammlung

Jede Benutzeranfrage trägt historischen Kontext – manchmal tausende Token vorheriger Gespräche oder Dokumentdaten. Wenn die Kontextlänge wächst, bläht sich die Prompt-Größe auf und die Modellausführungszeit steigt. Im großen Maßstab erzeugt das unvorhersehbare Latenzspitzen und Warteschlangendruck auf GPUs.

Compute-Bound Skalierung

Im Gegensatz zu Webservern lässt sich die Modellausführung großer Modelle nicht immer horizontal skalieren. Modellgewichte und Kontextfenster verbrauchen festen GPU-Speicher, Kapazitätsüberschreitungen führen zu wartenden Anfragen oder Rückfall auf kleinere Modelle. Das macht die Konkurrenzgrenzen deutlich strenger als bei CPU-basierten Systemen.

Abfrage-Latenz

Viele Agenten ziehen externe Daten – über Vektor-Datenbanken, APIs oder Dokumentenspeicher – ab, bevor sie eine Antwort generieren. Diese Abhängigkeiten fügen I/O-Latenz hinzu und werden zum ersten Engpass bei Verkehrsanstieg.

Sitzungspersistenz

Traditionelle Lasttests spielen zustandslose Anfragen neu ab. KI-Sitzungen sind zustandsbehaftet. Jede enthält Speicher, Einbettungen und zwischengespeicherten Kontext. Je länger das Gespräch, desto größer der Sitzungs-Fußabdruck.

Diese Faktoren vereinen sich zu einem neuen Stressprofil. Das System erscheint bei 100 gleichzeitigen Benutzern gesund, kann aber bei 120 einknicken – nicht wegen Bandbreitenerschöpfung, sondern durch GPU-Warteschlangen-Sättigung oder Kontextcache-Überlauf. Lasttests für KI-Systeme bedeuten, diese nichtlinearen Kipppunkte zu erkennen.

Verständnis des Verhaltens von KI-Agent-Workloads

Vor der Testgestaltung hilft es, zu modellieren, wie ein KI-Agent tatsächlich „unter der Haube“ funktioniert. Die meisten produktiven Agenten folgen einer ähnlichen Pipeline:

- Eingabeaufnahme. Der Benutzer sendet eine Anfrage oder Nachricht.

- Kontextzusammenstellung. Der Agent sammelt relevante Daten aus vorherigen Interaktionen oder einem externen Speicher.

- Modellausführung. Die zusammengesetzte Prompt wird an einen lokalen oder entfernten Modellendpunkt gesendet.

- Nachbearbeitung. Die Ausgabe wird möglicherweise geparst, validiert oder angereichert, bevor sie zurückgegeben wird.

- Antwortlieferung. Der Agent aktualisiert den UI-Status oder sendet eine API-Antwort.

Jede Stufe bringt Variabilität mit sich. Die Ausführungszeit skaliert ungefähr mit der Eingabe- und Ausgabetokenanzahl. Die Abfragelatenz hängt von Datenbanknähe und Cache-Trefferraten ab. Die Kosten der Kontextzusammenstellung steigen mit jeder Gesprächsrunde.

Um das Leistungsdynamik zu verstehen, muss man beobachten, wie diese Dimensionen zusammenwirken. Eine Verdopplung der Promptlänge kann die durchschnittliche Ausführungszeit um 60 % erhöhen, aber eine Überlastung der gleichzeitigen Sessions kann sie um 300 % steigern. Diese Kurven sind wichtiger als einzelne Kennzahlen.

Lasttests von KI-Systemen sind teilweise statistisch. Es geht nicht nur um Durchsatz – man baut Antwortverteilungen auf. Die Spitzenwerte dieser Verteilungen – die 95. und 99. Perzentile der Latenzen – zeigen, wann Modell oder Infrastruktur zu sättigen beginnen. Dort entstehen die meisten nutzerseitigen Verzögerungen.

Im praktischen Einsatz bedeutet das, progressive Rampentests durchzuführen. Beginnen Sie mit einigen wenigen gleichzeitigen Sitzungen, erfassen Sie die Baseline-Latenz und skalieren Sie dann schrittweise hoch. Beobachten Sie, wie Token-Durchsatz, Warteschlangenzeit und GPU-Auslastung reagieren. Jeder Agent hat seine eigene Skalierungskurve, und diese zu finden ist der erste Schritt zu zuverlässigem Betrieb.

Kernmetriken für KI-Agent-Lasttests

Traditionelle Metriken – RPS, TTFB, Fehlerquote – sind weiterhin relevant, erzählen jedoch nicht die ganze Geschichte. Das Lasttesten von KI-Agenten führt neue Metriken ein, die widerspiegeln, wie Intelligenz und nicht nur Infrastruktur skaliert.

Ausführungslatenz misst die Gesamtzeit von der Prompt-Einreichung bis zur fertigen Modellantwort. Es ist das direkteste Leistungssignal, muss aber zusammen mit Eingabegröße und Modelltyp betrachtet werden. Rohe Durchschnitte ohne Kontextgrößen-Normalisierung können irreführend sein.

Kontextskalierung quantifiziert, wie die Latenz mit wachsendem Promptfenster zunimmt. Ingenieure können Antwortzeit gegen Tokenanzahl auftragen, um die Kostenkurve zu visualisieren. Ein gut optimiertes System zeigt lineare oder sublineare Skalierung, schlecht optimierte Systeme exponentielle Spitzen jenseits bestimmter Kontextgrenzen.

Token-Durchsatz – verarbeitete Tokens pro Sekunde über gleichzeitige Sessions – spiegelt sowohl Performance als auch Kosteneffizienz wider. Da die meisten APIs pro Token abgerechnet werden, bedeutet Durchsatzrückgang direkte Kosteneffizienz-Einbußen.

Abhängigkeitslatenz erfasst Verzögerungen durch unterstützende Systeme: Vektorsuchindizes, Wissensdatenbanken oder Plugin-APIs. Diese können die Gesamtantwortzeit dominieren, selbst wenn die Ausführung schnell ist.

Gleichzeitigkeitsstabilität misst, wie sich das System unter gleichzeitiger Last verhält. Wächst die Latenz vorhersehbar? Bleiben Fehlerquoten begrenzt? Oder schwanken die Antwortzeiten stark, wenn Warteschlangen entstehen?

Durch Kombination dieser Metriken können Teams ein ganzheitliches Leistungsbild erzeugen. Ziel ist es nicht nur Geschwindigkeit zu messen – sondern zu verstehen, wo und warum Leistungsverlust beginnt.

Entwurf effektiver Lasttests für KI-Systeme

Mit definierten Metriken wird die Teststrategie zu einer Frage der Simulationsgenauigkeit. KI-Agenten bedienen keine identischen Anfragen, daher ist das Aufzeichnen und Wiedergeben einer einzigen Transaktion unter Last nutzlos. Jeder synthetische Benutzer muss Variationen darstellen – verschiedene Prompts, Längen und Verhaltensweisen. Ziel ist nicht Uniformität, sondern Realismus.

1. Modellieren Sie die gesamte Denk-Pipeline, nicht nur den Endpunkt

Echte Benutzer rufen /generate nicht isoliert auf. Sie authentifizieren sich, übergeben Kontext, rufen Abruf auf und generieren dann Ausgabe. Ein glaubwürdiger Lasttest ahmt diese Sequenz nach. Überspringen Sie eine Ebene, wird Ihre Datenbedeutung sinnlos.

2. Parametrisieren Sie Prompts, um echte Vielfalt widerzuspiegeln

KI-Systeme werden langsamer, wenn Eingabelänge oder semantische Komplexität steigen. Nutzen Sie variable Promptvorlagen, die Tokenanzahl, Satzstruktur oder eingebettete Kontexttiefe anpassen. So wird sichtbar, wie Skalierung die Antwortzeitverteilung beeinflusst.

3. Steigern Sie die Gleichzeitigkeit stufenweise

KI-Backends bilden häufig Warteschlangen auf der Ebene der Ausführung. Statt sofort auf 1000 Benutzer zu springen, steigern Sie schrittweise in definierten Phasen – z.B. 10 → 50 → 100 → 200 – und halten jede Stufe mehrere Minuten. Die entstehende Kurve zeigt, wo GPU- oder Thread-Sättigung beginnt.

4. Verfolgen Sie Kosten parallel zur Leistung

Anders als Webserver verursachen Inferenz-APIs Kosten pro Token. Berechnen Sie während Lasttests die Kosten pro Anfrage auf jeder Gleichzeitigkeitsstufe. Leistungstuning sollte wirtschaftliche Effizienz einschließen – schnelle, aber teure Modelle können unter Skalierung finanziell scheitern, auch wenn sie technisch bestehen.

5. Berücksichtigen Sie Wiederholungs- und Timeout-Verhalten

KI-Endpunkte limitieren oft Zugriffe oder verschlechtern sich bei hoher Nutzung. Simulieren Sie Client-Wiederholungslogik, um kumulative Lastwirkungen zu beobachten. Ein naiver exponentieller Backoff kann bei Ausfällen den effektiven Traffic verdoppeln.

Diese Strategien ersetzen das alte „Aufzeichnen und Wiedergeben“-Modell durch eine Verhaltenssimulations-Denkweise. Sie testen nicht nur Transaktionen, sondern Kognition – wie das System gleichzeitig denkt und skaliert.

KI-gestütztes Lasttesting: Lassen Sie die Modelle helfen

Ironischerweise kann KI helfen, das Problem zu lösen, das sie selbst erzeugt. Moderne Testplattformen beginnen, Machine Learning-Modelle direkt in ihre Analysezyklen einzubinden und erzeugen so das, was oft als KI-gestütztes Lasttesting bezeichnet wird.

Hier spielt KI drei Rollen:

Prompt-Generierung

Statt manuell hunderte Testeingaben zu erstellen, kann ein generatives Modell Prompt-Variationen erzeugen, die reale Benutzervielfalt simulieren. Es passt Ton, Struktur und Kontext automatisch an und exponiert das System einer breiteren Palette von Belastungsmustern.

Anomalieerkennung

KI-Modelle erkennen statistische Drift in Leistungsdaten schneller als statische Schwellenwerte. Statt bei Überschreitung einer fixen Latenz zu warnen, lernen Anomalie-Modelle normale Varianz und zeigen Ausreißer an, die echte Verschlechterungen signalisieren.

Prädiktive Sättigungsanalyse

Durch Analyse historischer Lastdaten kann KI vorhersagen, wann ein System die nächste Leistungsklippe erreicht. Regressionsmodelle oder Zeitreihen-Prognosen identifizieren nichtlineare Skalierungsmuster, bevor sie Produktionssysteme beeinträchtigen.

Der Vorteil ist keine magische Automatisierung, sondern Beschleunigung. Ingenieure verbringen weniger Zeit mit repetitiver Wartung und mehr mit dem Verstehen von Leistungssprüngen. KI-gestütztes Lasttesting verwandelt manuelles Skripten in adaptive Experimente.

Implementierung von KI-Agent-Tests in LoadView

KI-Agenten sind zwar hochmodern, kommunizieren aber weiterhin über bekannte Protokolle – HTTP, WebSocket oder REST-APIs. Das heißt, Sie können sie mit der gleichen Infrastruktur testen, die LoadView bereits bereitstellt.

API-basierte Tests bilden die Grundlage. Jede Agenten-Anfrage, unabhängig von der Komplexität, läuft letztlich auf einen API-Aufruf hinaus – meist JSON über HTTPS. LoadViews API-Tests erlauben Teams, Tausende gleichzeitiger Inferenzanfragen zu simulieren, jede mit dynamischen Payloads parametrisiert. Sie können Promptgrößen variieren, Kontext hinzufügen und die Latenz End-to-End messen.

UserView-Skripting erweitert diese Simulation auf die Benutzeroberfläche. Viele KI-Agenten leben in Dashboards, Chat-Portalen oder SaaS-Integrationen. Mit LoadView können Sie vollständige Workflows aufzeichnen – Login, Prompt-Eingabe, Antwortdarstellung – und von verteilten Cloud-Standorten abspielen. Dieser Ansatz validiert Backend- und Frontend-Verhalten unter realen Browserbedingungen.

Skalierbare Orchestrierung verbindet alles. LoadViews Cloud-Netzwerk verteilt Tests über geografische Regionen, so dass Teams sehen, wie globaler Traffic KI-Endpunkte beeinflusst, die von zentralisierten GPU-Clustern abhängen. Durch Korrelation der Antwortzeiten mit geografischer Entfernung können Sie Netzwerk-Latenz von Modell-Latenz trennen.

Analytik und Reporting schließen den Feedback-Kreislauf. LoadView verfolgt alle Standardleistungsmetriken, kann aber auch angepasst werden, bestimmte Datentypen zu erfassen. Diese Kombination verwandelt synthetisches Testen in eine Beobachtungsebene für KI-Leistung.

Mit anderen Worten, Sie brauchen keine neue Testplattform für KI-Systeme – Sie brauchen ein intelligenteres Testdesign innerhalb einer bestehenden. LoadView hat bereits die Grundfunktionen, und diese neue Klasse von Workloads verlangt einfach eine andere Testphilosophie.

Die Zukunft des KI-Lasttestings

KI-Systeme sind keine statischen Dienste – sie sind adaptiv, stochastisch und werden ständig neu trainiert. Das bedeutet, dass sich ihre Leistungsmerkmale verschieben, selbst wenn die Infrastruktur gleich bleibt. Ein Modell-Update, das die Genauigkeit erhöht, kann die Ausführungszeit verdoppeln. Eine Prompt-Änderung, die die Kohärenz verbessert, kann die Kontextgröße sprengen. Lasttests müssen sich weiterentwickeln, um diese beweglichen Ziele zu erfassen.

Zukünftiges Leistungstesting wird Simulation, Analytik und selbstlernende Feedback-Schleifen kombinieren. Tests passen sich in Echtzeit an, erweitern oder reduzieren Last basierend auf beobachteter Modellstabilität. Statt „Test ausführen, Bericht lesen“ werden Ingenieure kontinuierliche Leistungslinien pflegen, die sich mit Modelländerungen automatisch anpassen.

Der Fokus wird sich über Durchsatz hinaus bewegen. Die entscheidende Frage wird nicht sein „Kann es 1000 Nutzer bewältigen?“, sondern „Kann es unter Druck konsistent denken?“ Das Messen von kognitiver Stabilität – wie die Denkqualität bei Lastspitzen nachlässt – wird zur Standardmetrik.

Für Organisationen, die KI-CoPiloten, Chat-Assistenten und automatisierte Entscheidungsagenten einsetzen, ist diese Entwicklung bereits im Gange. Die Systeme sind neu, aber das Prinzip bleibt zeitlos: Man kann nicht verbessern, was man nicht misst. Lasttesting war schon immer die Disziplin, verborgene Grenzen aufzudecken. KI fügt nur eine neue Art Grenze hinzu – die zwischen Leistung und Intelligenz.

Lasttesting für KI-Agenten – Zusammenfassung

KI-Agenten führen eine neue Dimension in das Leistungstesting ein. Sie kombinieren intensive Berechnung, dynamischen Kontext und unvorhersehbare Skalierung. Traditionelle Lasttestscripte können da nicht mithalten, aber KI-gestützte Ansätze schon. Indem man sich auf Ausführungslatenz, Kontextskalierung und Gleichzeitigkeitsstabilität konzentriert – und Tools wie LoadView nutzt, um vollständige Denk-Workflows zu simulieren – können Teams Zuverlässigkeit erhalten, selbst wenn Intelligenz zum Kern ihrer Systeme wird.

Die nächste Ära des Lasttestings wird nicht nur messen, wie schnell Systeme reagieren. Sie wird messen, wie gut sie denken, wenn alle gleichzeitig fragen.